Illustration Absmeier foto freepik

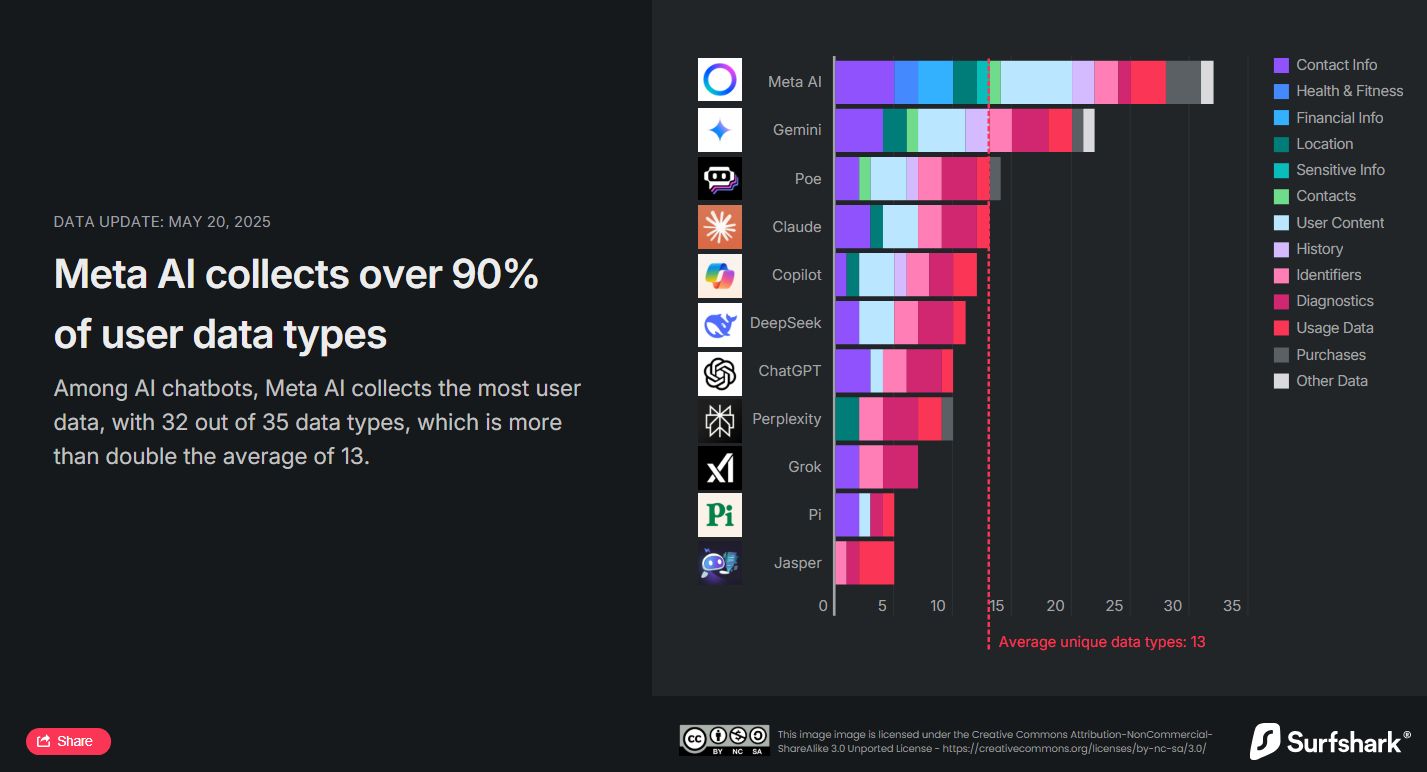

Google Gemini hat abgedankt. Meta hat kürzlich seine Chatbot-App Meta AI vorgestellt, die als neuer Datenkönig gilt. Laut einer Studie des Cybersicherheitsunternehmens Surfshark sammelt Meta AI Nutzerdaten wie niemand zuvor [1]. Dieser Chatbot übertrifft alle anderen analysierten Chatbots, da er 32 von 35 Datentypen erfasst, was mehr als doppelt so viel ist wie der Durchschnitt.

Meta AI sammelt die meisten Nutzerdaten unter den analysierten Apps und erfasst 32 von 35 möglichen Datentypen – über 90 % der Gesamtmenge. Außerdem ist sie die einzige Chatbot-App, die Daten aus verschiedenen Kategorien sammelt, darunter Finanzinformationen, Gesundheit und Fitness sowie sensible Informationen wie Angaben zu ethnischer Zugehörigkeit, sexueller Orientierung, Schwangerschaft oder Geburt, Behinderung, religiösen oder philosophischen Überzeugungen, Gewerkschaftsmitgliedschaft, politischer Meinung, genetischen Informationen oder biometrischen Daten.

Darüber hinaus sammeln nur Meta AI und Copilot Daten, die mit der Identität der Nutzer verknüpft sind, um beispielsweise Werbung von Drittanbietern in der App anzuzeigen oder Daten an Dritte weiterzugeben, die Werbung von Drittanbietern anzeigen. Während Copilot zwei Datenarten für diesen Zweck aufführt, nämlich Geräte-ID und Werbedaten, kann Meta AI bis zu 24 verschiedene Datenarten verwenden.

»Meta ist ein Ökosystem, das Nutzerdaten über Plattformen wie Facebook, Instagram und Audience Network sammelt, um Werbung von Drittanbietern anzuzeigen. Dies geschieht nun auch über Meta AI. Dieser Chatbot lernt aus öffentlichen Beiträgen, Fotos und Texten sowie aus neuen Daten, die von Nutzern geteilt werden, was ein Beispiel für grobes Fehlverhalten und Missbrauch von Nutzerdaten ist. Generative KI sollte nicht mit Nutzerdaten trainiert werden, und dies unterstreicht, warum Vorschriften für KI dringend erforderlich sind«, sagt Karolis Kaciulis, leitender Systemingenieur bei Surfshark.

Die Chatbots erheben eine Vielzahl von Daten, die zum Lernen verwendet werden. Diese Daten können jedoch fehlerhaft sein.

Die durchschnittliche Anzahl der gesammelten Datentypen beträgt 13 von 35 möglichen bei den analysierten KI-Chatbot-Apps. 45 % der Apps erfassen den Standort der Nutzer. Darüber hinaus verfolgen fast 30 % dieser Apps Nutzerdaten. Unter Tracking versteht man die Verknüpfung von Nutzer- oder Gerätedaten, die über die App erfasst werden, mit Daten von Drittanbietern für gezielte Werbung oder Werbemessungen oder die Weitergabe dieser Daten an Datenbroker.

KI-Chatbots lernen aus verschiedenen Informationsquellen, wobei Meta AI zusätzlich von Facebook- und Instagram-Beiträgen und -Bildern lernt. Bei der Erfassung großer Datenmengen, einschließlich öffentlicher Beiträge und von Nutzern bereitgestellter Inhalte, können die Ergebnisse variieren und aufgrund von Ungenauigkeiten in den Trainingsdaten häufig fehlerhaft sein. Ein aktuelles Beispiel dafür: Grok von X reagierte auf nicht zusammenhängende Eingaben und diskutierte mit X-Nutzern über nationalistische Themen. Dieser Vorfall zeigt deutlich, vor welchen Herausforderungen wir mit den aktuellen Standards für generative KI stehen.

»Die Nutzer sollten sich bewusst sein, dass diese Chatbots zwar schnelle Antworten liefern können, die Ergebnisse jedoch nur mittelmäßig sind. Warum ist das so? KI-Chatbots werden mit allen möglichen Informationen gefüttert, die in den meisten Fällen fehlerhaft sein können. Jeder Mensch ist für die Ergebnisse seiner Arbeit verantwortlich, generative KI jedoch nicht. Sie ist nicht rechenschaftspflichtig und unterliegt nicht denselben rechtlichen Kontrollen wie Menschen«, kommentiert K. Kaciulis.

Seien Sie vorsichtig, wenn Sie Informationen an Chatbots weitergeben

Google Gemini sammelt 22 einzigartige Datentypen. Dazu gehören genaue Standortdaten, die nur Gemini, Meta AI, Copilot und Perplexity sammeln. Gemini erfasst außerdem eine erhebliche Menge an Daten in verschiedenen anderen Kategorien, darunter Kontaktdaten (Name, E-Mail-Adresse, Telefonnummer usw.), Nutzerinhalte, Kontakte (zum Beispiel eine Liste der Kontakte im Telefon des Nutzers), Suchverlauf, Browserverlauf und verschiedene andere Arten von Daten.

ChatGPT sammelt zehn Arten von Daten, darunter Kontaktinformationen, Nutzerinhalte, Identifikatoren, Nutzungsdaten und Diagnosedaten, wobei die Erfassung von Tracking-Daten oder die Verwendung von Werbung Dritter innerhalb der App vermieden wird. Während ChatGPT den Chatverlauf speichert, können temporäre Chats verwendet werden, bei denen alle Daten nach 30 Tagen automatisch gelöscht werden, oder die Entfernung personenbezogener Daten aus Trainingsdatensätzen beantragt werden.

Copilot, Poe und Jasper sind die drei Apps, die Daten sammeln, die zu Ihrer Nachverfolgung verwendet werden. Diese Daten könnten an Datenbroker verkauft oder zur Anzeige gezielter Werbung in Ihrer App verwendet werden. Während Copilot und Poe lediglich Geräte-IDs erfassen, sammelt Jasper Geräte-IDs, Produktinteraktionsdaten, Werbedaten und andere Nutzungsdaten, die sich auf »alle anderen Daten über die Aktivitäten des Nutzers in der App« beziehen.

Nach Ansicht von K. Kaciulis zahlen Nutzer bei der Verwendung von Chatbots nicht nur mit Geld für Abonnements, sondern auch mit ihren persönlichen Daten. »Insbesondere in Europa, wo die DSGVO die Rechte der Nutzer schützt, gehören personenbezogene Daten Ihnen und nicht Unternehmen oder KI-Systemen. Wenn Sie diese Daten mit generativer KI teilen, können sie gespeichert, analysiert und ohne Ihre vollständige Kontrolle verwendet werden, was das Risiko gezielter Manipulation, Identitätsdiebstahl oder Missbrauch birgt. Außerdem ist es wichtig zu wissen, dass die Informationen, die KI aus Ihren persönlichen Daten lernt, nicht wieder vergessen werden können. In einer Zeit, in der personenbezogene Daten zunehmend als Ware behandelt werden, ist es von entscheidender Bedeutung, Ihre Privatsphäre und Ihre Online-Integrität zu schützen.«

[1] Wir haben die zehn beliebtesten KI-Chatbots ermittelt. Dabei wurde Meta AI am 20. Mai 2025 als zusätzliche App hinzugefügt. Anschließend haben wir die Datenschutzdetails im Apple App Store analysiert. Der Vergleich wurde anhand der folgenden Kriterien durchgeführt: Anzahl der von jeder App erfassten Datentypen, Erfassung personenbezogener Daten und Einbindung von Drittanbietern. Wir haben auch die Datenschutzrichtlinien von DeepSeek und ChatGPT überprüft, um besser zu verstehen, welche Art von Daten auf Servern gespeichert werden und wie lange diese gespeichert bleiben.

Hinweis zu den Daten, die zur Nachverfolgung des Benutzers verwendet werden: »Tracking bezieht sich auf die Verknüpfung von Nutzer- oder Gerätedaten, die von Ihrer App gesammelt wurden, mit Nutzer- oder Gerätedaten, die von Apps, Websites oder Offline-Eigentum anderer Unternehmen gesammelt wurden, um gezielte Werbung oder Werbemessung zu betreiben. Tracking bezieht sich auch auf die Weitergabe von Nutzer- oder Gerätedaten an Datenbroker.«

https://surfshark.com/research/chart/ai-chatbots-privacy