Illustration Absmeier foto freepik

Mit ihrem KI-Gesetz will die Europäische Union sicherstellen, dass in der EU eingesetzte KI-Systeme sicher, fair, transparent und nachvollziehbar arbeiten. Doch was bedeutet das für Unternehmen konkret, und wie können sie sich auf die neuen Spielregeln vorbereiten?

Der Einsatz von künstlicher Intelligenz soll in der EU künftig durch ein KI-Gesetz geregelt werden. Dieses stuft KI-Systeme in Risikokategorien ein, für die unterschiedliche Vorschriften gelten. Systeme, die für Menschen eine Gefahr sind, weil sie zum Beispiel deren Verhalten manipulieren, Menschen auf Basis ihrer sozialen Merkmale klassifizieren und benachteiligen oder aus der Ferne in Echtzeit biometrisch identifizieren, werden komplett verboten. Systeme, die ein hohes Risiko für die Gesundheit und Sicherheit oder für die Grundrechte von Menschen darstellen, unterliegen hingegen strengen Auflagen. Diese Kategorie umfasst unter anderem KI-Systeme, die in Produkten zum Einsatz kommen, für die die Produktsicherheitsvorschriften der EU gelten oder die in einen von acht definierten Bereichen fallen und deshalb in einer EU-weiten Datenbank registriert werden müssen. Dazu zählen unter anderem Systeme für den Betrieb kritischer Infrastrukturen oder in der Personalverwaltung. Für Systeme, die generative KI einsetzen, müssen zusätzlich besondere Transparenzauflagen erfüllt werden und muss beispielsweise offengelegt werden, dass Inhalte von einer KI erzeugt wurden.

Durch den extraterritorialen Anwendungsbereich des KI-Gesetzes sind nicht nur europäische Unternehmen betroffen, sondern alle, deren KI-Systeme Auswirkungen innerhalb der EU haben. Sie müssen sicherstellen, dass ihre KI-Werkzeuge und Anwendungen mit KI-Unterstützung den Regelungen entsprechen und sicher, fair, transparent sowie nachvollziehbar arbeiten. Noch ist das KI-Gesetz zwar nicht verabschiedet, dennoch sollten sich Unternehmen schon heute darauf vorbereiten, da an den grundlegenden Regeln keine entscheidenden Änderungen mehr zu erwarten sind. Pegasystems, Anbieter einer Low-Code-Plattform, die die Agilität weltweit führender Unternehmen steigert, nennt die wichtigsten Maßnahmen:

- Aufbau eines Frameworks für KI-Governance: Um den Verpflichtungen aus dem KI-Gesetz nachkommen zu können, benötigen Unternehmen ein Framework mit Richtlinien und Vorschriften für die Entwicklung, Bereitstellung und Nutzung von KI. Zu diesem muss unbedingt auch ein Risikomanagementsystem gehören. Dieses hilft, KI-Systeme nicht nur einmalig, sondern über ihren gesamten Lebenszyklus hinweg hinsichtlich möglicher Risiken zu überwachen und zu bewerten.

- Anpassung von Organisationsstrukturen: Mit den Regelungen für KI-Systeme gehen neue Rollen und Verantwortlichkeiten einher. Unternehmen müssen deshalb neue Stellen und Organisationseinheiten in den Bereichen Risikomanagement und Compliance schaffen. Zudem ist es notwendig, das aktuelle Betriebsmodell anzupassen, damit die neuen Stellen und Einheiten reibungslos mit den bestehenden zusammenarbeiten und Werte für das Unternehmen generieren können.

- Überprüfung von Werkzeugen und Technologien: Alle aktuell und künftig eingesetzten Tools bedürfen einer Überprüfung, ob sie KI nutzen und in welche Kategorie diese KI fällt. Eine gute technische Dokumentation der Tools erleichtert die Prüfungen und eine Sammlung von Protokolleinträgen die Kontrolle der Prüfaktivitäten und -ergebnisse. Transparente Hinweise klären Anwender über den KI-Einsatz in den von ihnen genutzten Tools auf.

- Sicherstellen der KI-Modell-Governance: Unternehmen müssen sicherstellen, dass die in ihrem Governance-Framework festgelegten Praktiken, Richtlinien und Rahmenbedingungen zur Verwaltung und Überwachung der KI-Entwicklung, -Bereitstellung und -Wartung den Anforderungen des KI-Gesetzes entsprechen. Sie müssen aber auch dafür Sorge tragen, dass die für das Training, die Validierung und den Test von KI-Systemen verwendeten Datensätze zuverlässig sind, sprich: relevant, repräsentativ, fehlerfrei und vollständig. Das geht nur mit menschlicher Aufsicht – dementsprechend werden erfahrene Mitarbeiter gebraucht, die die KI-Systeme überwachen und gegebenenfalls intervenieren, wenn sie Verstöße gegen die KI-Governance feststellen.

- Sicherstellen der Daten-Governance: Neben dem KI-Modell selbst unterliegen auch die Trainingsdaten verschiedenen Gesetzen und Richtlinien, etwa der DSGVO. Für Unternehmen geht es also nicht nur darum, ihre KI-Systeme mit korrekten und unvoreingenommen Daten zu füttern, sondern auch darum, diese Daten mit ordnungsgemäßer Zustimmung der Betroffenen zu erheben und konform zu allen relevanten Vorschriften zu speichern und zu verarbeiten.

»Mit dem KI-Gesetz steckt die EU die Leitplanken für den Einsatz von KI-Systemen sehr eng«, sagt Florian Lauck-Wunderlich, Senior Project Delivery Leader bei Pegasystems. »Auf Unternehmen kommen damit neue Pflichten zu, mit denen sie sich möglichst jetzt befassen sollten. Die benötigten Strukturen für KI-Governance können sie bereits aufbauen und nutzen, um zu verhindern, dass sie KI-Systeme entwickeln oder einsetzen, die künftig nicht mehr zugelassen sind oder mit hohen Kosten angepasst werden müssen.«

Künstliche Intelligenz: Es droht IT-Wildwuchs und erhöhte Compliance-Kosten

Illustration Absmeier foto freepik

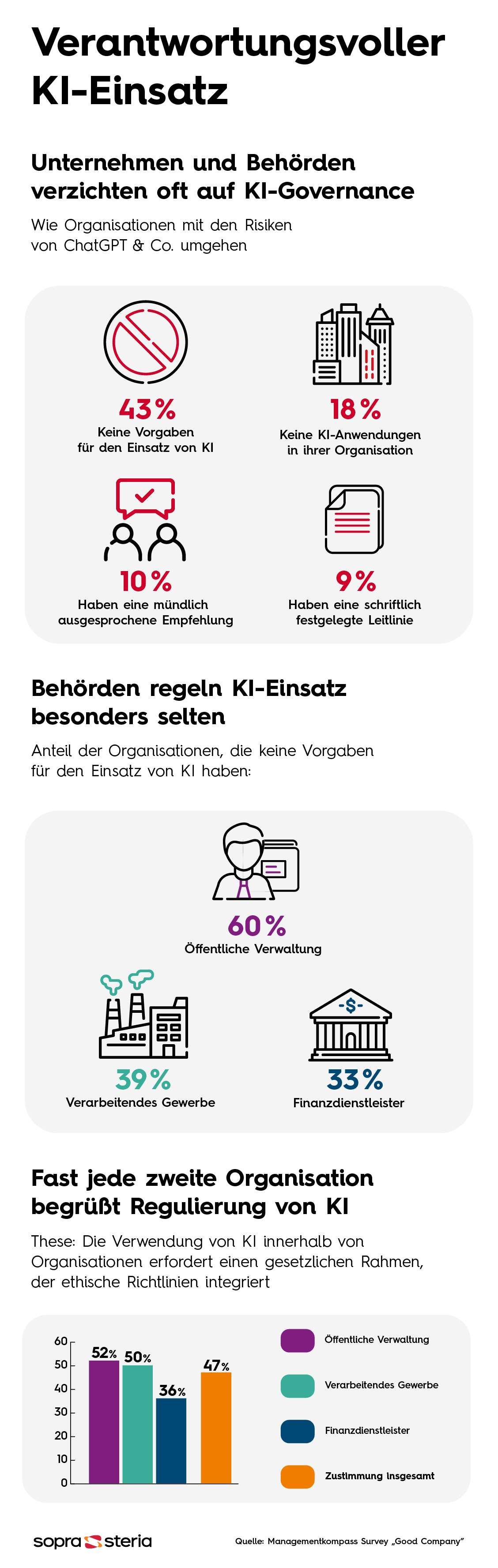

In der deutschen Wirtschaft und öffentlichen Verwaltung herrscht seit ChatGPT in weiten Teilen Aktionismus beim Einsatz von künstlicher Intelligenz (KI). 43 Prozent der Unternehmen und Behörden besitzen bislang keine speziellen Regelwerke und Richtlinien, eine so genannte KI-Governance. Durch die unkontrollierte Nutzung droht ihnen ein Wildwuchs und damit ein unerwünschter Mehraufwand. Zudem steigen durch die Intransparenz und fehlende Regeln die künftigen Compliance-Kosten. Das geht aus der Studie Managementkompass Survey Good Company von Sopra Steria hervor [1].

Künstliche Intelligenz etabliert sich in Unternehmen und Verwaltungen sukzessive als Standardtechnologie. Nur 18 Prozent der für den Managementkompass Survey befragten Entscheiderinnen und Entscheider geben an, dass ihre Organisation bislang keine KI nutzt.

Eine gesonderte Online-Panelbefragung – mit geringerer Stichprobe – deutet zudem darauf hin, dass der KI-Anteil an den IT-Budgets steigt. Jede zweite Organisation plant, in den kommenden Jahren mehr als 20 Prozent ihres IT-Budgets für die Integration von KI-Systemen einzusetzen. Knapp jedes fünfte Unternehmen rechnet damit, mehr als 30 Prozent zu investieren. Das ergibt eine Befragung von 100 Entscheiderinnen und Entscheidern, die Marktforscher Sago für Sopra Steria im August und September durchgeführt hat.

Mit der zunehmenden KI-Nutzung steigen die strategischen Anforderungen, wenn Unternehmen und Behörden ihre Ziele wie neue Geschäftsmodelle, Effizienz oder die Entlastung von Personal erreichen wollen. »Das KI-Potenzial schöpfen Unternehmen und Behörden dann aus, wenn sie die KI-Technologien, inklusive KI-Governance, in ihre Gesamtstrategie einbetten. Ansonsten droht ein Wildwuchs, der die Kosten für die CIOs unnötig nach oben treibt und die positiven Effekte dämpft«, sagt Christian Wrage, Vorstandssprecher von Sopra Steria.

Gleichzeitig steigt der Regulierungsbedarf – sowohl extern durch die Politik als auch intern durch die KI-nutzenden Organisationen. Risiken wie Datenmissbrauch, Manipulation, Diskriminierung oder der Wegfall von Arbeitsplätzen sollen durch Vorschriften wie den AI Act der Europäischen Union, den freiwilligen Verhaltenskodex der G7-Staaten oder eine beim AI Safety Summit verabredete Zusammenarbeit eingedämmt und das Investitionsklima verbessert werden.

Sopra-Steria-Vorstand Christian Wrage plädiert für Regulierung mit Augenmaß und eine aktive KI-Compliance der Wirtschaft. »Es braucht Regelwerke für vertrauenswürdige KI-Anwendungen und Transparenz. Gibt es beides nicht, werden sich deutlich mehr Akteure beim Einsatz zurückhalten – aus Sorge vor den Risiken. Sind die Regeln zu kompliziert oder zu kleinteilig, gilt allerdings dasselbe«, so Wrage.

Kaum verbriefte Regeln für den KI-Einsatz

47 Prozent der befragten Unternehmen und Behörden sprechen sich für einen gesetzlichen Rahmen der KI-Nutzung aus, der ethische Grundsätze integriert, so der Managementkompass Survey Good Company.

Interne Vorgaben für den vertrauenswürdigen Einsatz von KI sind in Deutschland allerdings noch die Ausnahme. Bislang verfügen nur neun Prozent der befragten Unternehmen und Behörden über schriftlich festgelegte Leitlinien für den KI-Einsatz. Zehn Prozent haben den Mitarbeitenden mündliche Empfehlungen gegeben. Sie informieren zum Beispiel über systematische Verzerrungen und frei erfundene Informationen von generativer KI wie ChatGPT oder über eingebaute Vorurteile in den Daten oder Algorithmen (Bias). Die Mehrheit der Befragten hält die aktuellen Vorgaben und die Informationen für ausreichend. Nur sieben Prozent finden die eigene Organisation intransparent, was die Nutzung von KI angeht.

Unternehmen und Verwaltungen profitieren jedoch, wenn sie ihren Compliance-Apparat und ihr Risikomanagement aktiv an den KI-Einsatz anpassen. Organisationen, die KI-Anwendungen systematisch bewerten und Transparenz über IT-Lösungen mit eingebauter KI schaffen, werden kommende gesetzliche Vorschriften schneller umsetzen, Compliance-Kosten senken und sich stärker auf das Innovationspotenzial von KI fokussieren können.

»Unternehmen sollten nicht auf den Gesetzgeber warten, sondern frühzeitig eine KI-Governance etablieren. Wenn sich eine »Good Practice« etabliert, kann diese die Eingriffsdynamik der Regulatoren mindern und regulatorische Eingriffe eventuell sogar überflüssig machen«, sagt Armin Rheinbay, Leiter Risikomanagement bei Sopra Steria Next. Der Managementberater spricht sich zudem für eine Verzahnung der internen Regelwerke aus: »Trotz des besonderen Stellenwerts der KI-Governance sollte sie in Corporate Governance, die IT-Governance und die Data-Governance eingebettet werden«, so Rheinbay.

[1] Die Studienreihe Managementkompass Survey erscheint dreimal pro Jahr. Für diese Ausgabe zum Thema »Good Company« wurden 371 Entscheiderinnen und Entscheider aus Wirtschaft und öffentlicher Verwaltung in Deutschland befragt. F.A.Z. Business Media | research befragte die Teilnehmenden darüber, wie stark ethische Grundsätze sowie ökologische, soziale und unternehmerische Verantwortung in den Strategien und Maßnahmen verankert sind. Der Umgang mit dem Einsatz von künstlicher Intelligenz ist ein Teilaspekt der Studie. Sie wurde im September 2023 im Auftrag des F.A.Z.-Instituts und von Sopra Steria online durchgeführt. Die Ergebnisse finden Sie auf dieser Website.« https://research.faz-bm.de/publikationen/soprasteria/managementkompass-survey-good-company/

Wie kann ein KI-Governance mit klaren Regeln für Unternehmen und Behörden aussehen?

Künstliche Intelligenz (KI) ist eine der wichtigsten Technologien der Gegenwart und Zukunft. Sie bietet enorme Chancen für Innovation, Wachstum und gesellschaftlichen Fortschritt, birgt aber auch Risiken und Herausforderungen für den Schutz von Grundrechten, die Sicherheit von Systemen und die Verantwortlichkeit von Akteuren. Um diese Risiken zu minimieren und das Vertrauen in KI zu stärken, braucht es einen angemessenen rechtlichen und ethischen Rahmen, der die Werte und Prinzipien der Europäischen Union widerspiegelt.

Ein solcher Rahmen sollte auf einer KI-Governance basieren, die klare Regeln für Unternehmen und Behörden festlegt, die KI entwickeln, bereitstellen oder nutzen. Diese Regeln sollten sich an den Zielen der EU-KI-Strategie orientieren, die darauf abzielt, eine menschenzentrierte, sichere und vertrauenswürdige KI zu fördern, die dem Gemeinwohl dient. Dabei sollten folgende Aspekte berücksichtigt werden:

- Die Einhaltung von Grundrechten und ethischen Prinzipien wie Fairness, Transparenz, Nichtdiskriminierung und Privatsphäre. KI-Systeme sollten so gestaltet sein, dass sie die Würde, Autonomie und Selbstbestimmung der Menschen respektieren und schützen. Sie sollten auch die Vielfalt der Gesellschaft widerspiegeln und keine Vorurteile oder Diskriminierung verstärken oder verursachen.

- Die Sicherheit und Zuverlässigkeit von KI-Systemen. KI-Systeme sollten so entwickelt und getestet werden, dass sie robust, resilient und fehlerfrei funktionieren. Sie sollten auch über geeignete Sicherheitsmaßnahmen verfügen, um Angriffe oder Missbrauch zu verhindern oder zu erkennen. Darüber hinaus sollten sie über Mechanismen zur Überwachung, Überprüfung und Korrektur ihres Verhaltens verfügen, um unerwünschte oder schädliche Folgen zu vermeiden oder zu beheben.

- Die Verantwortlichkeit und Haftung von KI-Akteuren. KI-Akteure sollten für die Auswirkungen ihrer KI-Systeme auf die Gesellschaft und die Umwelt verantwortlich sein. Sie sollten auch für mögliche Schäden haften, die durch ihre KI-Systeme verursacht werden. Dazu sollten sie über angemessene Mechanismen zur Identifizierung, Dokumentation und Meldung von Risiken und Vorfällen verfügen. Außerdem sollten sie den betroffenen Personen oder Organisationen angemessene Informationen, Erklärungen und Rechtsbehelfe zur Verfügung stellen.

Eine KI-Governance mit klaren Regeln für Unternehmen und Behörden ist nicht nur eine rechtliche oder ethische Notwendigkeit, sondern auch eine strategische Chance für Europa. Sie kann dazu beitragen, das Vertrauen in KI zu erhöhen, die Akzeptanz und Nutzung von KI zu fördern und einen Wettbewerbsvorteil für europäische KI-Anbieter zu schaffen. Sie kann auch dazu beitragen, eine globale Führungsrolle Europas bei der Gestaltung einer verantwortungsvollen und nachhaltigen KI zu stärken.

Genki Absmeier