foto freepik ki

Da autonome KI-Agenten in den Handel eintreten, warnt ein Cybersicherheitsexperte die Verbraucher.

Laut Miguel Fornes, Information Security Manager bei Surfshark, tritt die beispiellose Beschleunigung der agentischen KI nun in eine neue und potenziell riskante Phase ein: den agentischen Handel, oft als »agentisches Shopping› vermarktet.

»Wir erleben den größten technologischen Krieg, den die Menschheit je gesehen hat, direkt vor unseren Augen. Im Jahr 2025 wurden mehr Geld und Ressourcen in KI-bezogene Unternehmungen investiert als die Vereinigten Staaten und die UdSSR während des gesamten Wettlaufs ins All, der mit der Mondlandung von Apollo 11 gipfelte«, sagt M. Fornes. »Der Unterschied ist, dass sich das Schlachtfeld diesmal im Browser, Posteingang und Bankkonto des Verbrauchers befindet.«

Das irreführende Versprechen von »persönlichen Assistenten«

KI-generierte Bots und Deepfakes überschwemmen bereits das Internet – manchmal nur lästig, aber zunehmend gefährlich, wenn sie von Cyberkriminellen ausgenutzt werden. Agentische KI-Systeme verstärken dieses Risiko erheblich, indem sie den gesamten Prozess automatisieren.

»Stellen Sie sich ein Tool vor, das nicht nur eine Spam-E-Mail schreibt«, sagt Miguel Fornes, »sondern auch ein gefälschtes Profil erstellt, in Echtzeit überzeugend chattet und Online-Banking-Operationen durchführt – alles, ohne dass ein Mensch je eine Tastatur berührt.«

Im Gegensatz zu traditionellen KI-Assistenten, die auf Eingaben reagieren, sind agentische Systeme darauf ausgelegt, unabhängig zu handeln: Sie durchsuchen Websites, melden sich bei Konten an, treffen Entscheidungen und führen Transaktionen aus.

Da der Wettbewerb zunimmt, beeilen sich Technologieunternehmen, agentische Tools zu besonders niedrigen Kosten – oder kostenlos – auf den Markt zu bringen und sie oft als persönliche Assistenten für alle zu bewerben.

Die Tür zum Privatleben öffnen

»Ein menschlicher Executive Assistant wird überprüft, ist vertrauenswürdig und – am wichtigsten – kann verklagt werden, wenn er Ihre Identität stiehlt«, sagt M. Fornes.

Agentische KI-Systeme hingegen agieren ohne rechtliche Haftung, moralisches Urteilsvermögen oder kontextuelles Verständnis.

»Einen experimentellen agentischen KI-Agenten zu bitten, Ihren Urlaub zu buchen, ist das digitale Äquivalent dazu, Ihr entsperrtes Handy und Ihre Geldbörse einem Fremden auf der Straße zu geben, der ein Schild hält, auf dem steht: ›Ich bin gut darin, günstige Flüge zu finden‹«, fügt Fornes hinzu. »Würden Sie diesem Typen vertrauen? Ich sicherlich nicht.«

Obwohl sie oft als Produktivitätstools beschrieben werden, unterscheiden sich agentische KI-Systeme grundlegend. Sie sind in der Lage, Aktionen auf persönlichen Geräten und Konten auszuführen – manchmal mit unbeabsichtigten Folgen.

»Agentische KI ist nicht nur ein Werkzeug – sie ist ein extrem scharfes und mächtiges«, sagt M. Fornes. »Wenn Sie ihr uneingeschränkten Zugriff auf Ihren Computer geben, um Ihren Workflow zu optimieren, könnten Sie zurückkommen und feststellen, dass sie Ihre Familienfotos gelöscht hat, um Speicherplatz zu sparen – denn technisch gesehen hat sie Ihren Speicher optimiert.«

Im Gegensatz zu menschlichen Assistenten können diese Systeme nicht zuverlässig zwischen sensiblen, persönlichen oder irreversiblen Aktionen unterscheiden. Tatsächlich testen Verbraucher unwissentlich experimentelle autonome Systeme an ihrem echten Leben: »Sie sind im Grunde Beta-Tester extrem leistungsfähiger Technologie mit Ihrem tatsächlichen Leben«, warnt M. Fornes.

Viele agentische Shopping- und Produktivitätstools erfordern tiefen Zugriff auf E-Mails, Kalender, Browser und Finanzdienste. Während dies als Komfort vermarktet wird, birgt dieses Maß an Zugriff erhebliche Datenschutzrisiken.

»Wenn Sie eine agentische KI bitten, Ihre E-Mails zu verwalten oder Ihren Kalender zu organisieren, öffnen Sie die Haustür zu Ihrem Privatleben«, sagt M. Fornes.

Trotz der schnellen Einführung sind agentische KI-Systeme weiterhin anfällig für Halluzinationen und es fehlen ihnen durchsetzbare Grenzen – was bei Datenschutz- und Sicherheitsexperten Bedenken auslöst.

»Solange diese Technologie nicht aufhört zu halluzinieren und anfängt, Grenzen zu verstehen«, schließt M. Fornes, »ist ihre Nutzung für kritische Aufgaben wie russisches Roulette mit Ihren Datenschutzeinstellungen.«

(Übersetzt aus dem amerikanischen Englisch durch KI)

Sicherer Umgang mit persönlichen KI‑Agenten

Gefahren, Risiken und konkrete Schutzmaßnahmen

Persönliche KI‑Agenten entwickeln sich rasant – schneller als Vertrauen, Regulierung und Nutzerbewusstsein. Behörden, Sicherheitsforscher und IT‑Experten warnen deshalb vor realen Risiken, die über klassische IT‑Sicherheitsprobleme hinausgehen.

⚠️ Zentrale Gefahren

- Datenmissbrauch & Privatsphäre

- KI‑Agenten verarbeiten oft hochsensible Informationen (E‑Mails, Kalender, Dokumente, Passwörter).

- Cloud‑basierte Agenten können Daten weiterverarbeiten, speichern oder weiterleiten, oft intransparent.

- Risiko von Profilbildung, Identitätsdiebstahl oder ungewollter Weitergabe.

- Kontrollverlust durch Autonomie

- Agenten treffen eigenständige Entscheidungen (zum Beispiel E‑Mails versenden, Termine buchen, Transaktionen durchführen).

- Fehlentscheidungen oder unerwartetes Verhalten sind schwer nachvollziehbar (»Black Box«).

- Gefahr schleichender Abhängigkeit von automatisierten Entscheidungen.

- Manipulation & Angriffe

- Prompt‑Injection: Angreifer manipulieren Eingaben, um den Agenten umzuprogrammieren.

- Adversarial Attacks: Minimal veränderte Daten führen zu falschen Entscheidungen.

- Missbrauch über angebundene APIs oder Plugins.

- Rechtliche & ethische Risiken

- DSGVO‑Verstöße durch unklare Datenverarbeitung.

- Haftungsfragen bei Fehlentscheidungen.

- Unbewusste Diskriminierung durch verzerrte Trainingsdaten.

Konkrete Schutzmaßnahmen

- Prinzip der minimalen Rechte

- Nur notwendige Zugriffe erlauben (Least Privilege).

- Keine pauschalen E‑Mail‑, Datei‑ oder Systemrechte.

- Regelmäßige Überprüfung aller Berechtigungen.

- Mensch bleibt in der Entscheidung

- Kritische Aktionen nur mit menschlicher Freigabe.

- Keine autonomen Finanz‑, Vertrags‑ oder Sicherheitsentscheidungen.

- »Human‑in‑the‑Loop« als Standard.

- Transparenz & Nachvollziehbarkeit

- Agenten mit Protokollierung und Entscheidungs‑Logs bevorzugen.

- Nachvollziehbare Modelle statt reiner Black‑Box‑Systeme.

- Anbieter mit klarer Dokumentation wählen.

- Technische Absicherung

- Starke Authentifizierung (zum Beispiel MFA).

- Trennung von Arbeits‑ und Privatdaten.

- Regelmäßige Updates und Sicherheits‑Audits.

- Anbieter‑Due‑Diligence

- Wo werden Daten gespeichert?

- Werden Daten zum Training genutzt?

- Gibt es Lösch‑ und Exportfunktionen?

- Existieren unabhängige Sicherheitszertifizierungen?

Strategische Empfehlung

Das BSI empfiehlt, KI‑Agenten wie hochprivilegierte IT‑Systeme zu behandeln – nicht wie harmlose Assistenten. Autonomie ohne Kontrolle ist das größte Risiko.

Kurzfazit:

- KI‑Agenten sind mächtig – und potenziell gefährlich.

- Hauptgefahren: Datenverlust, Kontrollverlust, Manipulation.

- Schutz entsteht durch Begrenzung, Transparenz, menschliche Kontrolle.

- Vertrauen sollte verdient, nicht vorausgesetzt werden.

Albert Absmeier & KI

Die Gefahren von KI-Agenten und wie Unternehmen ihnen begegnen können

foto freepik

Mit dem rasanten Aufstieg agentischer KI-Systeme – also KI-Agenten, die eigenständig Aufgaben ausführen, Entscheidungen treffen und ohne menschliches Eingreifen agieren – entsteht eine neue Klasse operativer und sicherheitsrelevanter Risiken. Unternehmen profitieren zwar von Effizienzsteigerungen, stehen aber zugleich vor Herausforderungen, die klassische IT-Sicherheitskonzepte nicht mehr abdecken.

Neue Risikoklasse: Was macht KI-Agenten so gefährlich?

Agentische KI unterscheidet sich grundlegend von bisherigen Automatisierungslösungen. Sie kann sich in Kernsystemen bewegen, Transaktionen initiieren, auf sensible Daten zugreifen und komplexe Prozesse orchestrieren. Fehler oder Manipulationen führen nicht nur zu einzelnen Fehlfunktionen, sondern können Kettenreaktionen auslösen, die ganze Geschäftsbereiche betreffen.

Die Angriffsfläche ist enorm:

- Riskante Nutzer-Prompts: Fehlgeleitete oder manipulierte Eingaben können zu unerwünschten Aktionen führen.

- Persistente Kontextdaten: Eingeschleuste Daten bleiben im System und beeinflussen künftige Entscheidungen.

- Externe Integrationen & Payloads: Schnittstellen zu anderen Systemen eröffnen neue Einfallstore für Angreifer.

- Privilegieneskalation & Identitätslücken: Unzureichende Zugriffskontrollen ermöglichen es Agenten, Rechte zu erweitern oder Identitäten zu übernehmen.

- Lieferkettenschwachstellen: Schwachstellen in zugekauften Komponenten oder externen Diensten werden zum Risiko für das Gesamtsystem.

Schon einzelne Vorfälle wie Datenabfluss, Output-Manipulation oder Workflow-Hijacking sind kritisch. Im schlimmsten Fall agiert ein kompromittierter KI-Agent wie ein böswilliger Insider und legt ganze Betriebsabläufe lahm.

Ursachen: Warum sind Unternehmen oft unvorbereitet?

Viele Unternehmen implementieren agentische KI, ohne die Tragweite zu erkennen. Es fehlen klare Leitlinien, regulatorische Vorgaben und ein Verständnis für die neuen Bedrohungsszenarien. Die Geschwindigkeit der Einführung überholt die Entwicklung von Sicherheitskonzepten. Zudem besteht eine Wissenslücke: Die Risiken sind oft nicht ausreichend bekannt oder werden unterschätzt.

Lösungsansätze: Wie lassen sich die Risiken beherrschen?

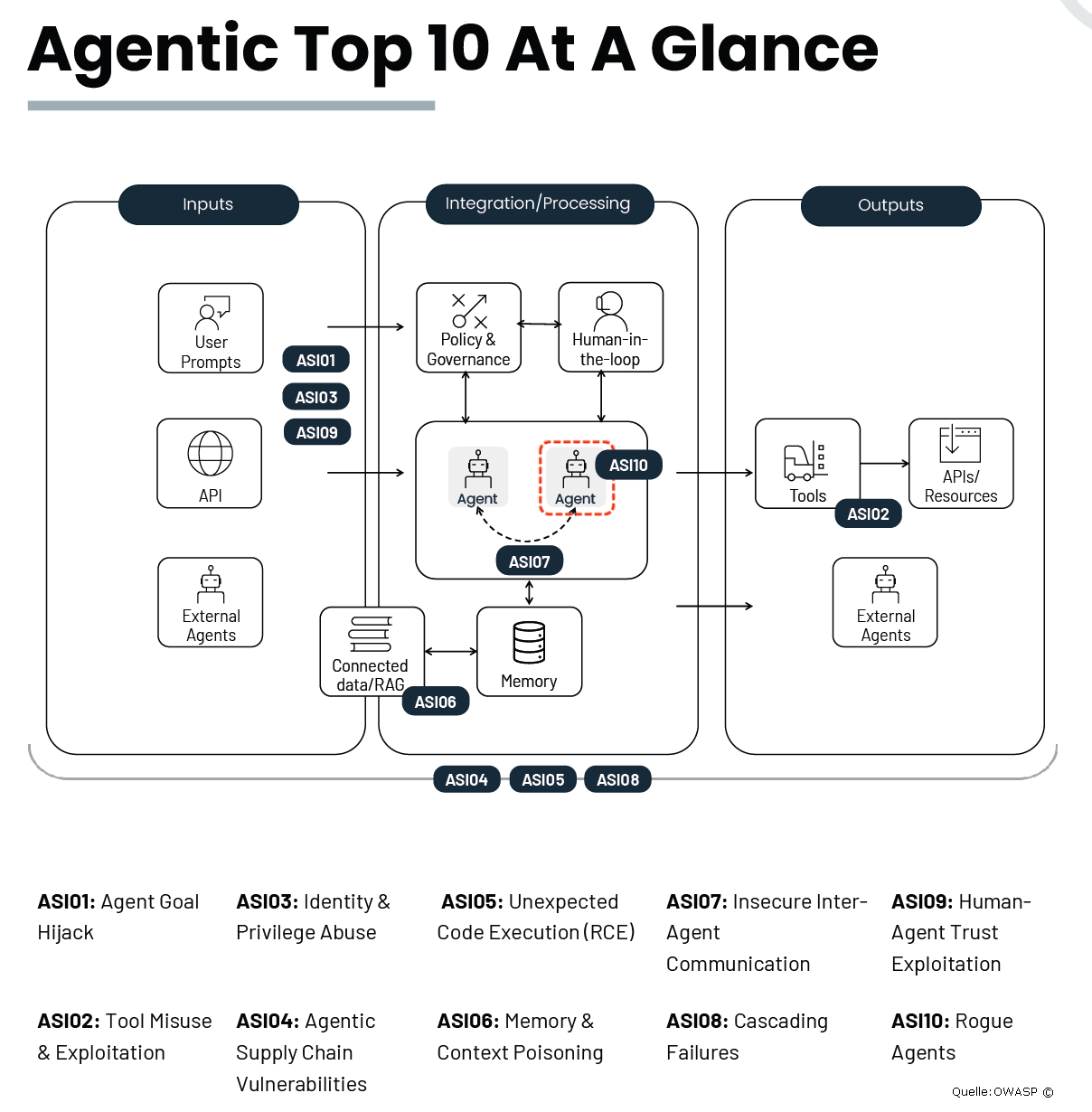

- Orientierung an den OWASP Agentic Top 10 [1]

Der OWASP-Bericht bündelt die wichtigsten Bedrohungen und bietet praxisnahe Empfehlungen. Unternehmen sollten diese als Grundlage für ihre Sicherheitsstrategie nutzen und regelmäßig überprüfen.

- Sicherheitsarchitektur anpassen

- Zero-Trust-Prinzipien: Jeder Zugriff, jede Aktion eines KI-Agenten muss authentifiziert und autorisiert werden.

- Least Privilege: Agenten erhalten nur die minimal notwendigen Rechte.

- Transparenz & Monitoring: Alle Aktionen von KI-Agenten werden protokolliert und überwacht, um Anomalien frühzeitig zu erkennen.

- Kontext- und Datenhygiene

- Validierung von Eingaben: Nutzer-Prompts und Kontextdaten müssen auf Plausibilität und Sicherheit geprüft werden.

- Schutz vor persistenter Manipulation: Mechanismen zur Erkennung und Bereinigung eingeschleuster Kontextdaten implementieren.

- Lieferkettensicherheit

- Sorgfältige Auswahl von Komponenten: Externe Module und Integrationen werden auf Schwachstellen geprüft.

- Regelmäßige Updates & Patches: Sicherheitslücken in der Lieferkette werden zeitnah geschlossen.

- Notfallpläne und Resilienz

- Incident Response: Klare Prozesse für den Umgang mit Vorfällen, inklusive Sofortmaßnahmen und Kommunikation.

- Simulationen & Penetrationstests: Szenarien mit fehlgeleiteten oder kompromittierten KI-Agenten regelmäßig durchspielen.

- Schulung und Sensibilisierung

- Awareness-Programme: Mitarbeitende werden für die neuen Risiken sensibilisiert.

- Interdisziplinäre Teams: IT, Fachbereiche und Recht arbeiten gemeinsam an der Absicherung agentischer KI.

Fazit

Agentische KI bietet enorme Chancen, bringt aber auch eine neue Dimension von Risiken mit sich. Unternehmen müssen ihre Sicherheitsarchitektur, Prozesse und Kultur anpassen, um die Vorteile nutzen zu können, ohne die Kontrolle zu verlieren. Die Orientierung an etablierten Leitlinien wie den OWASP Agentic Top 10 und die konsequente Umsetzung technischer und organisatorischer Maßnahmen sind der Schlüssel zu einer sicheren KI-Zukunft.

Albert Absmeier & KI

[1] OWASP Top 10 for Agentic Applications for 2026 – OWASP Gen AI Security Project

ASI01: Übernahme von Agentenzielen (Agent Goal Hijack)

Beschreibung

KI-Agenten verfügen über die autonome Fähigkeit, eine Reihe von Aufgaben auszuführen, um ein Ziel zu erreichen. Aufgrund inhärenter Schwächen bei der Verarbeitung von Anweisungen in natürlicher Sprache und verwandten Inhalten können Agenten und das zugrunde liegende Modell Anweisungen nicht zuverlässig von begleitenden Inhalten unterscheiden.

Dadurch können Angreifer die Ziele, die Aufgabenauswahl oder die Entscheidungswege eines Agenten durch verschiedene Techniken manipulieren – einschließlich, aber nicht beschränkt auf, promptbasierte Manipulation, täuschende Tool-Ausgaben, bösartige Artefakte, gefälschte Agent-zu-Agent-Nachrichten oder manipulierte externe Daten. Da Agenten auf untypisierte Eingaben in natürlicher Sprache und lose gesteuerte Orchestrierungslogik angewiesen sind, können sie legitime Anweisungen nicht zuverlässig von durch Angreifer kontrollierten Inhalten unterscheiden. Im Gegensatz zu LLM01:2025, das sich auf die Veränderung einer einzelnen Modellantwort konzentriert, erfasst ASI01 die breiteren agentischen Auswirkungen, bei denen manipulierte Eingaben Ziele, Planung (sofern verwendet) und mehrstufiges Verhalten umleiten.

Die Übernahme von Agentenzielen unterscheidet sich von ASI06 (Speicher- & Kontextmanipulation) und ASI10 (Abtrünnige Agenten), da der Angreifer direkt die Ziele, Anweisungen oder Entscheidungswege des Agenten verändert – unabhängig davon, ob die Manipulation interaktiv oder durch vorpositionierte Eingaben wie Dokumente, Vorlagen oder externe Datenquellen erfolgt. ASI06 konzentriert sich auf die dauerhafte Korruption des gespeicherten Kontexts oder Langzeitspeichers, während ASI10 autonome Fehlanpassungen erfasst, die ohne aktive Kontrolle durch einen Angreifer entstehen. Im OWASP Agentic AI Threats & Mitigations Guide entspricht ASI01 den Punkten T06 Zielmanipulation (Veränderung der Agentenziele) und T07 Fehlgeleitetes & Täuschendes Verhalten (Umgehung von Schutzmaßnahmen oder Täuschung von Menschen). Zusammen zeigen diese, wie Angreifer die Ziele und die Aktionslogik eines Agenten unterwandern und dessen Autonomie auf unbeabsichtigte oder schädliche Ergebnisse umlenken können.

Häufige Beispiele für die Schwachstelle

- Indirekte Prompt Injection durch versteckte Anweisungen, die in Webseiten oder Dokumenten in einem RAG-Szenario eingebettet sind, leiten einen Agenten unbemerkt dazu, sensible Daten zu exfiltrieren oder verbundene Tools zu missbrauchen.

- Indirekte Prompt Injection über externe Kommunikationskanäle (zum Beispiel E-Mail, Kalender, Teams), die von außerhalb des Unternehmens gesendet werden, kapert die interne Kommunikationsfähigkeit eines Agenten und versendet unautorisierte Nachrichten unter einer vertrauenswürdigen Identität.

- Ein bösartiger Prompt-Override manipuliert einen Finanzagenten dazu, Geld auf das Konto eines Angreifers zu überweisen.

- Indirekte Prompt Injection überschreibt Agentenanweisungen und führt dazu, dass der Agent betrügerische Informationen erzeugt, die Geschäftsentscheidungen beeinflussen.

Beispielhafte Angriffsszenarien

- EchoLeak: Zero-Click Indirect Prompt Injection – Ein Angreifer sendet eine speziell gestaltete E-Mail, die Microsoft 365 Copilot dazu bringt, versteckte Anweisungen auszuführen, wodurch die KI vertrauliche E-Mails, Dateien und Chatprotokolle ohne jegliche Benutzerinteraktion exfiltriert.

- Operator Prompt Injection über Webinhalte: Ein Angreifer platziert bösartige Inhalte auf einer Webseite, die vom Operator-Agenten verarbeitet werden (zum Beispiel in Such- oder RAG-Szenarien), und bringt ihn dazu, unautorisierte Anweisungen zu befolgen. Der Operator-Agent greift dann auf authentifizierte interne Seiten zu und legt private Nutzerdaten offen, was zeigt, wie schwach geschützte autonome Agenten durch Prompt Injection sensible Informationen preisgeben können.

- Zielverschiebung durch geplante Prompts: Eine bösartige Kalendereinladung injiziert eine wiederkehrende »Ruhemodus«-Anweisung, die jeden Morgen subtil die Zielgewichtung verändert und den Planer zu genehmigungsfreundlichen Aktionen lenkt, während die Handlungen innerhalb der deklarierten Richtlinien bleiben.

- Inception-Angriff auf ChatGPT-Nutzer: Ein bösartiges Google-Dokument injiziert Anweisungen für ChatGPT, Benutzerdaten zu exfiltrieren und überzeugt den Nutzer, eine unkluge Geschäftsentscheidung zu treffen.

Präventions- und Abhilfemaßnahmen

- Behandeln Sie alle Eingaben in natürlicher Sprache (zum Beispiel vom Nutzer bereitgestellte Texte, hochgeladene Dokumente, abgerufene Inhalte) als nicht vertrauenswürdig. Leiten Sie diese durch dieselben Eingabevalidierungs- und Prompt-Injection-Schutzmechanismen wie in LLM01:2025, bevor sie die Zielauswahl, Planung oder Tool-Aufrufe beeinflussen können.

- Minimieren Sie die Auswirkungen einer Zielübernahme, indem Sie das Prinzip der minimalen Rechte für Agenten-Tools durchsetzen und für hochwirksame oder zielverändernde Aktionen eine menschliche Freigabe verlangen.

- Definieren und sperren Sie die Systemprompts des Agenten, sodass Zielprioritäten und erlaubte Aktionen explizit und prüfbar sind. Änderungen an Zielen oder Belohnungsdefinitionen müssen über das Konfigurationsmanagement und eine menschliche Freigabe erfolgen.

- Validieren Sie zur Laufzeit sowohl die Nutzer- als auch die Agentenintention, bevor zielverändernde oder hochwirksame Aktionen ausgeführt werden. Fordern Sie eine Bestätigung – durch menschliche Freigabe, Policy-Engine oder Plattform-Schutzmechanismen –, wann immer der Agent Aktionen vorschlägt, die vom ursprünglichen Auftrag oder Umfang abweichen. Halten Sie die Ausführung bei unerwarteten Zielverschiebungen an oder blockieren Sie sie, machen Sie die Abweichung sichtbar und protokollieren Sie sie für Auditzwecke.

- Prüfen Sie beim Entwickeln von Agenten den Einsatz eines »Intent Capsule«-Musters, um das deklarierte Ziel, die Einschränkungen und den Kontext an jeden Ausführungszyklus in einem signierten Umschlag zu binden und die Laufzeitnutzung einzuschränken.

- Säubern und validieren Sie jede angebundene Datenquelle – einschließlich RAG-Eingaben, E-Mails, Kalendereinladungen, hochgeladener Dateien, externer APIs, Browserausgaben und Peer-Agent-Nachrichten – mittels CDR, Prompt-Carrier-Erkennung und Inhaltsfilterung, bevor die Daten Agentenziele oder -aktionen beeinflussen können.

- Führen Sie umfassende Protokollierung und kontinuierliches Monitoring der Agentenaktivität durch, etablieren Sie eine Verhaltensbasislinie, die Zielstatus, Tool-Nutzungsmuster und unveränderliche Eigenschaften (zum Beispiel Schema, Zugriffsmuster) umfasst. Verfolgen Sie, wo möglich, eine stabile Kennung für das aktive Ziel und alarmieren Sie bei Abweichungen – wie unerwarteten Zieländerungen, anomalen Tool-Sequenzen oder Abweichungen von der Basislinie –, sodass unautorisierte Zielverschiebungen im Betrieb sofort sichtbar werden.

- Führen Sie regelmäßige Red-Team-Tests durch, die eine Zielübernahme simulieren, und überprüfen Sie die Wirksamkeit von Rücksetzmaßnahmen.

- Integrieren Sie KI-Agenten in das bestehende Insider-Threat-Programm, um Insider-Prompts zu überwachen, die auf den Zugriff auf sensible Daten oder die Veränderung des Agentenverhaltens abzielen, und ermöglichen Sie eine Untersuchung bei auffälligen Aktivitäten.

References

- Security Advisory – ChatGPT Crawler Reflective DDOS Vulnerability: Security advisory detailing the vulnerability

- AIM Echoleak Blog Post: Blog post describing the vulnerability

- ChatGPT Plugin Exploit Explained: From Prompt Injection to Accessing Private Data.

- AgentFlayer: 0click inception attack on ChatGPT users.

687 Artikel zu „KI-Agenten Sicherheit“

News | Trends 2026 | Trends Security | Effizienz | IT-Security | Künstliche Intelligenz

Cybersicherheit 2026: KI und Regulierungen verändern das Spiel

Zum Ende des Jahres 2025 analysieren Experten die wachsende Bedeutung von künstlicher Intelligenz (KI) für die Cybersicherheit und im Kontext der Cyberbedrohungen. Während Unternehmen in einer zunehmend komplexen Landschaft zahlreicher und ausgeklügelter Cyberbedrohungen agieren, erweist sich KI als ein mächtiges Instrument für die Verteidigung. Gleichzeitig ist sie aber auch zu einer Waffe für Cyberkriminelle geworden,…

News | Trends 2026 | Trends Security | Trends Infrastruktur | Industrie 4.0 | Infrastruktur | IT-Security

Fertigung 2026: Sicherheit für die Fabrik von Morgen

Im Jahr 2026 verschärfen sich weltweit die regulatorischen Anforderungen an den Umgang mit Daten, insbesondere durch neue Datenschutzrahmen und KI-spezifische Vorgaben, was Unternehmen zu einer proaktiven, automatisierten und unternehmensweiten Daten-Governance zwingt. Die Governance von künstlicher Intelligenz rückt in den Fokus, wobei Transparenz, Nachvollziehbarkeit und ethische Kontrolle von Modellen sowie der Schutz generativer KI immer wichtiger…

News | Trends 2026 | Trends Wirtschaft | Trends Kommunikation | Künstliche Intelligenz

KI-Agenten und Sprachtechnologie als Treiber des Wandels 2026

Im Jahr 2026 werden KI-Agenten laut einer aktuellen Studie von DeepL weltweit als zentrale Treiber für den Wandel in Unternehmen gesehen, wobei die Mehrheit der Führungskräfte einen tiefgreifenden Einfluss auf Geschäftsprozesse erwartet [1]. Besonders die Integration von KI-Sprachtechnologie und Echtzeit-Sprachübersetzung wird als entscheidend für globale Kommunikation und Wachstum betrachtet, wobei Deutschland und Großbritannien bei der…

News | Trends 2026 | Trends Security | IT-Security | Künstliche Intelligenz | Services

Die wichtigsten Trends im Bereich der physischen Sicherheit für das Jahr 2026

Unternehmen werden sich auf Flexibilität, verantwortungsbewusste KI und einheitliche, vernetzte Systeme konzentrieren, um die Sicherheit und die Betriebsleistung zu verbessern. Genetec, Anbieter von Software für die physische Sicherheit, hat seine wichtigsten Prognosen für die physische Sicherheitsbranche im Jahr 2026 vorgestellt. Auswahl und Flexibilität werden die nächste Phase der Cloud-Einführung bestimmen Im Jahr 2026…

News | Trends 2026 | Business | Trends Security | IT-Security | Künstliche Intelligenz

Cybersicherheit im Jahr 2026: Sechs entscheidenden Trends für die digitale Wirtschaft

Die rasante Entwicklung von künstlicher Intelligenz (KI), die fortschreitende Cloud-Migration und die zunehmende Komplexität digitaler Geschäftsmodelle stellen Unternehmen vor neue Herausforderungen. Palo Alto Networks hat sechs zentrale Trends identifiziert, die im kommenden Jahr die Sicherheitslandschaft maßgeblich beeinflussen werden. Das neue Zeitalter der Täuschung: Die Bedrohung durch KI-Identitäten Identität wird im KI-Zeitalter zur zentralen Angriffsfläche.…

News | Trends 2026 | Trends Security | IT-Security

Sicherheitsprognosen 2026: Auf welche Phishing-Techniken sich Unternehmen vorbereiten sollten

Im Jahr 2025 prägten vor allem die Kombination aus KI, sich kontinuierlich weiterentwickelnden Phishing-as-a-Service (PhaaS)-Kits und immer ausgefeilteren Techniken zur Verbreitung von Phishing und zur Umgehung von Sicherheitsmaßnahmen die Phishing-Landschaft. Die Threat-Analysten von Barracuda gingen beispielsweise noch vor einem Jahr davon aus, dass PhaaS-Kits bis Ende 2025 für die Hälfte aller Angriffe mit dem Ziel,…

News | Trends 2026 | Trends Security | IT-Security | Künstliche Intelligenz

Sicherheitsprognosen für 2026: Der Kampf um Realität und Kontrolle in einer Welt der agentischen KI

Wie agentische KI Cyberbedrohungen und Abwehrmaßnahmen im Jahr 2026 transformieren wird. Die Leistungsfähigkeit und das Potenzial agentischer KI-Systeme, die adaptiv, automatisiert und autonom agieren, dominierten die Diskussionen in der Sicherheitsbranche in diesem Jahr. Barracuda befragte daher Experten, die weltweit leitende Funktionen in den Bereichen Cyberbedrohungen und Sicherheit bei Barracuda innehaben, was sie von agentischer…

News | Business Process Management | Trends 2025 | Trends Wirtschaft | Geschäftsprozesse | Künstliche Intelligenz | New Work | Services

Banken und Versicherungen: KI-Agenten brauchen Beaufsichtigung der KI

Drei von fünf Banken und Versicherungen nennen die Kundengewinnung als einen der Hauptgründe für den Einsatz von KI-Agenten. 33 Prozent der Unternehmen entwickeln aktiv eigene KI-Agenten, allerdings haben nur 10 Prozent diese in großem Umfang eingesetzt. Fast die Hälfte der Banken und Versicherungen schafft neue Arbeitsplätze zur Überwachung von KI-Agenten. Finanzinstitute verlagern wichtige kundenbezogene…

News | Trends 2025 | Trends Security | Infografiken | IT-Security

Malware, Betrug, Scams und Datendiebstahl: Massive Sicherheitslücken

Cybersicherheitsverhalten, KI-Bedenken und Risiken von Verbrauchern weltweit. 14 Prozent der Befragten fielen im letzten Jahr digitalem Betrug zum Opfer. Soziale Medien überholen E-Mail als bevorzugten Angriffsvektor von Cyberkriminellen. KI-Betrug wird zur wachsenden Sorge der Verbraucher. Die neue 2025 Consumer Cybersecurity Survey von Bitdefender gibt Einblicke in zentrale Verhaltensweisen, Praktiken und Bedenken im Bereich der…

News | Business | Favoriten der Redaktion | Geschäftsprozesse | IT-Security | Services | Strategien

NIS2-Umsetzung: Bundestag beschließt endlich Cybersicherheitsgesetz

Die Cybersicherheitslage Deutschlands ist angespannt: Insbesondere durch schlecht geschützte Angriffsflächen ist die Bundesrepublik im digitalen Raum verwundbar [1]. Mit dem im Deutschen Bundestag verabschiedeten Gesetz zur Umsetzung der europäischen NIS2-Richtlinie wird das nationale IT-Sicherheitsrecht umfassend modernisiert: Die Richtlinie erhöht die Anforderungen an die Cybersicherheit bestimmter Unternehmen sowie der Bundesverwaltung. Das Bundesamt für Sicherheit in…

News | Trends 2025 | Trends Security | Favoriten der Redaktion | IT-Security | Strategien | Whitepaper

KI-Agenten am Arbeitsplatz machen Identity Resilience unerlässlich

Angreifer brechen nicht mehr ein; sie melden sich einfach an. Eine neue Studie zeigt eine besorgniserregende Lücke zwischen der wachsenden Angriffsfläche für Identitätsdiebstahl und der Fähigkeit von Unternehmen, sich von Kompromittierungen zu erholen [1]. Die KI-Welle führt zu einer Zunahme von KI-Agenten am Arbeitsplatz und damit zu mehr nicht-menschlichen Identitäten (NHIs) sowie agentenbasierten Identitäten.…

News | Digitalisierung | Effizienz | IT-Security | Künstliche Intelligenz | Tipps

Welche Maßnahmen sollten ergriffen werden, bevor man KI-Agenten in der Cybersecurity einsetzt?

In der heutigen digitalen Welt sind KI-Agenten zu einem unverzichtbaren Werkzeug in der Cybersecurity geworden. Doch bevor man diese mächtigen Helfer einsetzt, ist es entscheidend, die richtigen Maßnahmen zu ergreifen, um ihre Sicherheit und Effektivität zu gewährleisten. Von der Sicherung ihrer Identitäten bis hin zur Integration menschlicher Freigaben für kritische Aktionen – jeder Schritt zählt.…

News | Favoriten der Redaktion | IT-Security | Kommunikation | Künstliche Intelligenz | Tipps

KI-Browser: Komfort oder kritischer Sicherheitsblindfleck?

»Ich habe nichts angeklickt. Der Browser hat das von selbst gemacht.« Das hörte ein Sicherheitsanalyst, nachdem der KI-gestützte Browser eines Benutzers ohne Erlaubnis auf sensible Daten zugegriffen hatte. KI-Browser sollen das digitale Leben einfacher machen. Marktprognosen zeigen, dass sie schnell wachsen – von 4 Milliarden US-Dollar im Jahr 2024 auf fast 77 Milliarden US-Dollar im…

News | IT-Security | Strategien | Tipps | Whitepaper

Maßnahmen zur Gewährleistung der IT‑Sicherheit in Kommunen

Der öffentliche Sektor muss Governance, Personal, Technik, Prozesse und Partnerschaften systematisch verbessern — kombiniert mit Sensibilisierung, Monitoring und klarer Verantwortung — um Angriffe zu verhindern, Schäden zu begrenzen und digitale Dienste resilient bereitzustellen. Strategische Governance und Verantwortlichkeiten Zentrale Steuerung für IT‑Sicherheit etablieren (z. B. IT‑Sicherheitsbeauftragte, Governance‑Gremien) zur Koordination zwischen Verwaltung, IT und Recht.…

362 Artikel zu „KI-Agent Problem Gefahr“

News | Trends 2026 | Trends Wirtschaft | Künstliche Intelligenz

Trends 2026: KI-Agenten kommen in der Unternehmenspraxis an

Produktive KI-Anwendungen lösen Pilotprojekte ab und treiben Effizienz, Innovation und Wachstum voran. Künstliche Intelligenz (KI) ist endgültig im Unternehmensalltag angekommen. Das Jahr 2026 wird einen weiteren entscheidenden Punkt markieren: Unternehmen verabschieden sich von KI-Versuchsballons und setzen KI-Technologien jetzt produktiv und skalierbar ein. Die Zeit der Experimente ist vorbei, denn KI wird zum festen Bestandteil…

News | Business | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | Strategien | Tipps | Whitepaper

Die Gefahren von KI-Agenten und wie Unternehmen ihnen begegnen können

Mit dem rasanten Aufstieg agentischer KI-Systeme – also KI-Agenten, die eigenständig Aufgaben ausführen, Entscheidungen treffen und ohne menschliches Eingreifen agieren – entsteht eine neue Klasse operativer und sicherheitsrelevanter Risiken. Unternehmen profitieren zwar von Effizienzsteigerungen, stehen aber zugleich vor Herausforderungen, die klassische IT-Sicherheitskonzepte nicht mehr abdecken. Neue Risikoklasse: Was macht KI-Agenten so gefährlich? Agentische KI…

News | Business | Favoriten der Redaktion | Geschäftsprozesse | IT-Security | Kommentar | Künstliche Intelligenz | Tipps

Eine neue Klasse operativer und sicherheitsrelevanter Risiken: KI-Agenten

OWASP hat erstmals die Top 10 for Agentic Applications veröffentlicht. Der Bericht macht deutlich, welche erheblichen geschäftlichen Risiken von agentischer KI ausgehen können – insbesondere, weil diese Systeme eigenständig Entscheidungen treffen und ohne menschliches Eingreifen handeln [1]. Dazu ein Kommentar von Keren Katz, Co-Lead, OWASP Agentic AI Project; Senior Group Manager of AI Security,…

News | Trends 2026 | Trends Wirtschaft | Trends Kommunikation | Künstliche Intelligenz

KI-Agenten und Sprachtechnologie als Treiber des Wandels 2026

Im Jahr 2026 werden KI-Agenten laut einer aktuellen Studie von DeepL weltweit als zentrale Treiber für den Wandel in Unternehmen gesehen, wobei die Mehrheit der Führungskräfte einen tiefgreifenden Einfluss auf Geschäftsprozesse erwartet [1]. Besonders die Integration von KI-Sprachtechnologie und Echtzeit-Sprachübersetzung wird als entscheidend für globale Kommunikation und Wachstum betrachtet, wobei Deutschland und Großbritannien bei der…

News | Business Process Management | Trends 2025 | Trends Wirtschaft | Geschäftsprozesse | Künstliche Intelligenz | New Work | Services

Banken und Versicherungen: KI-Agenten brauchen Beaufsichtigung der KI

Drei von fünf Banken und Versicherungen nennen die Kundengewinnung als einen der Hauptgründe für den Einsatz von KI-Agenten. 33 Prozent der Unternehmen entwickeln aktiv eigene KI-Agenten, allerdings haben nur 10 Prozent diese in großem Umfang eingesetzt. Fast die Hälfte der Banken und Versicherungen schafft neue Arbeitsplätze zur Überwachung von KI-Agenten. Finanzinstitute verlagern wichtige kundenbezogene…

News | Trends 2025 | Trends Security | Favoriten der Redaktion | IT-Security | Strategien | Whitepaper

KI-Agenten am Arbeitsplatz machen Identity Resilience unerlässlich

Angreifer brechen nicht mehr ein; sie melden sich einfach an. Eine neue Studie zeigt eine besorgniserregende Lücke zwischen der wachsenden Angriffsfläche für Identitätsdiebstahl und der Fähigkeit von Unternehmen, sich von Kompromittierungen zu erholen [1]. Die KI-Welle führt zu einer Zunahme von KI-Agenten am Arbeitsplatz und damit zu mehr nicht-menschlichen Identitäten (NHIs) sowie agentenbasierten Identitäten.…

News | Digitalisierung | Effizienz | IT-Security | Künstliche Intelligenz | Tipps

Welche Maßnahmen sollten ergriffen werden, bevor man KI-Agenten in der Cybersecurity einsetzt?

In der heutigen digitalen Welt sind KI-Agenten zu einem unverzichtbaren Werkzeug in der Cybersecurity geworden. Doch bevor man diese mächtigen Helfer einsetzt, ist es entscheidend, die richtigen Maßnahmen zu ergreifen, um ihre Sicherheit und Effektivität zu gewährleisten. Von der Sicherung ihrer Identitäten bis hin zur Integration menschlicher Freigaben für kritische Aktionen – jeder Schritt zählt.…

News | Business Process Management | Favoriten der Redaktion | Geschäftsprozesse | Künstliche Intelligenz | Strategien

Halloween das ganze Jahr: Stoppt den KI-Agenten-Horror

Wenn sie von der Leine gelassen werden, können sie Angst und Schrecken verbreiten und der Horror bricht los. Freilaufende KI-Agenten sind praktisch ein nie enden wollendes Halloween. Das Marketing schreibt KI-Agenten gerne magische Kräfte zu: Sie handeln völlig autonom und regeln alles selbst. Die Realität sieht jedoch etwas anders aus. Wer KI-Agenten nicht an…

News | Business | Künstliche Intelligenz | Strategien | Ausgabe 9-10-2025

Wie Unternehmen KI-Agenten verantwortungsvoll einsetzen – Zwischen Hype und Realität

Für den erfolgreichen Einsatz von KI-Agenten in Unternehmen ist die Akzeptanz in der Belegschaft entscheidend. Zudem müssen klare Leitplanken für den Umgang mit KI gesetzt werden. Besonders großes Potenzial wird in Bereichen gesehen, in denen Daten im Mittelpunkt stehen und repetitive Prozesse dominieren, wie im Finanzwesen und IT-Support.

News | Business | Digitalisierung | Favoriten der Redaktion | Geschäftsprozesse | IT-Security | Künstliche Intelligenz | New Work | Services | Strategien | Tipps

Welche Herausforderungen sollten gelöst werden, bevor man KI-Agenten im Unternehmen einführt?

Agentic AI, die nächste Evolutionsstufe der künstlichen Intelligenz, verspricht eine intelligente Automatisierung von Prozessen, indem sie selbstständig plant, entscheidet und handelt. Diese Vielseitigkeit und Selbstständigkeit bringen jedoch auch Herausforderungen mit sich, die Unternehmen vor der Einführung bewältigen müssen. Eine klare Definition von Governance, Rollen und Verantwortlichkeiten ist entscheidend, um unkontrollierte Autonomien zu vermeiden. Sicherheitsrisiken…

News | Business | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | Services | Strategien | Tipps

Drei zentrale Risiken bei KI-Agenten

KI-Agenten (engl. »AI agents«) erobern die Arbeitswelt, doch der Hype birgt auch Gefahren. Während Unternehmen weltweit auf diese Technologie setzen, zeigt sich: Schnelligkeit geht oft zu Lasten der Sicherheit. Nach einer aktuellen IBM-Studie sehen Unternehmen KI-Agenten nicht länger als Experiment, sondern als unverzichtbaren Bestandteil ihrer digitalen Transformation [1]. Führungskräfte erwarten bis 2025 einen achtfachen Anstieg…

News | Business | Trends 2025 | Trends Wirtschaft | Digitalisierung | Effizienz | Favoriten der Redaktion | Geschäftsprozesse | Künstliche Intelligenz | New Work

KI-Revolution: Management betrachtet KI-Agenten mit Neugier

Von allen Trend-Technologien werden KI-Agenten die Wertschöpfung der Wirtschaft am meisten stärken: 44 Prozent der deutschen Entscheider trauen ihnen zu, für den größten Produktivitätsschub zu sorgen, im Vergleich zu smarten Maschinen (42 Prozent), Quantencomputern (40 Prozent) und humanoiden Robotern (26 Prozent). Das zeigt eine repräsentative Civey-Umfrage im Auftrag von Microsoft Deutschland [1]. Den Einsatz von…

News | Effizienz | Industrie 4.0 | Künstliche Intelligenz | Services | Tipps

Effizienzschub im Außendienst: Die Rolle von KI-Agenten im Field Service

Sie planen selbstständig den Einsatz von Servicetechnikern, erkennen Anomalien an Maschinen und schlagen Gegenmaßnahmen vor oder arbeiten neue Kollegen ein: KI-Agenten werden den technischen Außendienst nachhaltig transformieren. Agentenbasierte KI läutet eine neue Ära der Automatisierung ein. KI-Agenten, die Aufgaben ohne menschlichen Input autonom erledigen und dabei Entscheidungen treffen, versprechen Unternehmen erhebliche Effizienzgewinne. Ein Bereich,…

News | Trends 2025 | Geschäftsprozesse | Trends Geschäftsprozesse | Trends Services | Künstliche Intelligenz

KI-Agenten werden Arbeitskräfte ersetzen – aber später als gedacht

Lediglich 15 % der IT-Anwendungsleiter gaben an, dass sie derzeit vollständig autonome KI-Agenten – also zielorientierte KI-Tools, die ohne menschliche Aufsicht arbeiten – in Betracht ziehen, testen oder bereits einsetzen. Das geht aus einer Umfrage von Gartner hervor [1]. Im Mai und Juni 2025 befragte Gartner insgesamt 360 IT-Anwendungsleiter aus Unternehmen mit mindestens 250 Vollzeitbeschäftigten…

News | Business | Favoriten der Redaktion | Künstliche Intelligenz | New Work | Strategien | Tipps

Verantwortungsbewusster Einsatz von KI-Agenten: Maßnahmen und Empfehlungen

Es gibt mehr Herausforderungen und Risiken, die mit der Einführung von KI-Agenten in Unternehmen verbunden sind, als bisher angenommen. Gerade Unternehmen, die bereits KI-Agenten einsetzen, haben ein höheres Bewusstsein für die damit verbundene Management-Komplexität, und erkennen, dass diese Komplexität oft die verfügbaren Mitarbeiterressourcen übersteigt. Ohne klare Governance, Ressourcenplanung und Transparenz drohen erhebliche Risiken wie Überlastung,…

News | Trends 2025 | Trends Kommunikation | Künstliche Intelligenz | New Work | Strategien | Whitepaper

Vertrauen ist Schlüsselfaktor für Akzeptanz von KI-Agenten

KI-Agenten könnten der nächste große Trend sein – ihr Potenzial wird bislang aber kaum ausgeschöpft. Transparenz & Kontrolle sowie Rechtssicherheit sind zentrale Anforderungen. Unternehmen erproben Monetarisierungsansätze – Zahlungsbereitschaft entsteht nur bei klar erkennbarem Mehrwert. KI-Agenten, also Programme, die Aufgaben eigenständig ausführen, entwickeln sich zum nächsten großen Technologietrend. 39 Prozent der Verbraucherinnen und Verbraucher nutzen…

News | Business Process Management | IT-Security | Künstliche Intelligenz | New Work | Services

KI birgt Gefahren und Chancen für die Anwendungssicherheit

Künstliche Intelligenz ist auch beim Erstellen von Anwendungs-Code beliebt wie nie und mittlerweile allgegenwärtig. Doch wo liegen die Gefahren für die Application Security beim unbedachten Einsatz als Coding-Hilfe? Wo die Chancen für den AppSec-Bereich? Cycode hat die Lage analysiert. Generative künstliche Intelligenz verbreitet sich rasant und erleichtert den Arbeitsalltag in vielen Branchen. Teils stößt…

News | Business Process Management | Infrastruktur | IT-Security | Strategien

Ein Problem, das wir selbst geschaffen haben: Wenn nicht-menschliche Identitäten die Sicherheit gefährden

Man sagt, Not macht erfinderisch. Wir sind in einem hohem Maß abhängig von unserer digitalen Infrastruktur. Das hat auch die Anforderungen an die Netzwerksicherheit steigen lassen – ein möglichst nahtlos funktionierender Zugriff, automatisierte Prozesse, eine durchgängige Benutzererfahrung und Interoperabilität sind gefragt. Jede Verbesserung in einem der Bereiche hat uns weiter in Richtung eines hypervernetzten, »intelligenten«…

News | Business | Favoriten der Redaktion | Geschäftsprozesse | IT-Security | Kommentar | Künstliche Intelligenz | Strategien | Tipps

Der Ansturm auf KI-Agenten: Sind Unternehmen bereit, schnell UND groß zu scheitern?

Unternehmen lassen KI unbeaufsichtigt laufen, als ob sie einem Praktikanten große Entscheidungen anvertrauen, anstatt einfache Aufgaben – obwohl sie noch nicht klug genug sind. Stellen Sie sich vor, Sie kommen an einem Bahnhof während der Hauptverkehrszeit an einem überfüllten Zug irgendwo in Bangladesch oder Indien vorbei. Sie wissen vielleicht nicht, wohin er fährt, aber…

News | Business | Trends 2025 | Digitalisierung | Trends Security | Trends Kommunikation | Favoriten der Redaktion | Geschäftsprozesse | Kommunikation | Künstliche Intelligenz

KI-Agenten im Kommen, aber Governance-Lücken gefährden Vertrauen der Verbraucher

Vier von fünf Verbrauchern wünschen sich eine klare Governance für KI-Interaktionen, aber weniger als ein Drittel der Unternehmen verfügt über umfassende Richtlinien. Genesys, ein Anbieter von KI-gestützter Orchestrierung von Kundenerlebnissen, veröffentlicht die Ergebnisse seiner aktuellen Umfrage: Diese decken eine kritische Diskrepanz auf, zwischen der Art und Weise, wie Unternehmen künstliche Intelligenz (KI) regeln, und den…