Illustration Absmeier foto freepik ki

Moderne Rechenzentren benötigen effiziente Lösungen, um die Abwärme von KI-Clustern sicher abzuführen. Heiko Ebermann von Vertiv erklärt im Gespräch, wie Immersion Cooling als Plattformansatz zur Skalierbarkeit der digitalen Infrastruktur beiträgt. Dabei wird deutlich, dass die technische Umsetzung weit über das bloße Eintauchen der Hardware hinausgeht.

Heiko Ebermann, Global Offering Manager Liquid Cooling, Vertiv.

Heiko Ebermann, Global Offering Manager Liquid Cooling, Vertiv.

Herr Ebermann, Immersion Cooling ist in kurzer Zeit vom Nischenthema zum Top-Agenda-Punkt geworden. Wo liegen die Vorteile der Tauchkühlung?

Das wachsende Interesse an Flüssigkühlung ist weniger ein Kommunikationstrend als vielmehr eine direkte Konsequenz der Lastprofile, die wir aktuell in unseren weltweiten Projekten beobachten. Das Training von KI-Modellen, Graphics Processing Unit (GPU)-Cluster und andere High-Density-Anwendungen verschieben derzeit die Leistungsdichten und thermischen Umgebungsbedingungen in Bereiche, in denen luftbasierte Konzepte zwar theoretisch noch möglich wären, aber in der Praxis deutlich an ihre Grenzen stoßen. Vor allem, wenn noch knappe zeitliche Vorgaben, Flächenrestriktionen und hohe Verfügbarkeitsanforderungen dazukommen.

In diesem Kontext ist Immersion Cooling einer der heute verfügbaren Ansätze für besonders hohe Leistungsdichten und ergänzt etablierte Direct-to-Chip-Flüssigkühlungskonzepte sinnvoll. Immersion Cooling wird hier dann manchmal als technische »Abkürzung« wahrgenommen: IT in ein dielektrisches Fluid eintauchen, Wärme direkt abführen, Problem gelöst. Die physikalische Grundidee ist dabei auch tatsächlich sehr effektiv. In der Umsetzung entscheidet aber nicht die Grundidee, sondern die Auslegung eines Gesamtsystems. Dazu gehören klimatechnische Komponenten, Redundanz, Regelung, Monitoring und Service. Deshalb ist Tauchkühlung aus meiner Sicht weniger ein isoliertes Kühlgerätethema, sondern ein integrierter Plattformansatz, bei dem Planung, Betrieb und Supply Chain deutlich enger aufeinander abgestimmt werden müssen als bei konventionellen Klimatisierungskonzepten.

Wie stellt sich die Tauchkühlung technisch dar und was ändert sich im Vergleich zur klassischen Klimatisierung in der Rechenzentrumsfläche?

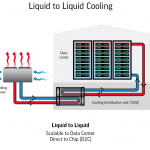

Technisch wird der thermische Pfad anders aufgebaut. Die Wärme wird nicht primär über Luft als Wärmeträger an der IT-Technik aufgenommen und wegtransportiert, sondern über eine nichtleitende Flüssigkeit, die die Komponenten direkt umströmt und die Abwärme der Server- und KI-Komponenten unmittelbar an der Quelle aufnimmt. Bei integrierten Systemen wird die Wärmeenergie anschließend über eine Wärmeübergabestation, oft auch CDU (Coolant Distribution Unit), an den Gebäudekühlkreislauf übergeben. Die Anbindung an Rückkühlung oder Wärmenutzung gehört hier ebenfalls zum Konzept. Im White Space verschiebt das den Schwerpunkt. Das heißt, Luftführung, Hotspot-Management und Lüfterleistung sind nicht mehr die dominanten Stellgrößen, während Medienführung, Hydraulik, Sensorik, Wartungszugang und Sicherheits- beziehungsweise Störfallkonzepte an Bedeutung gewinnen. Für die Planung heißt das: Die Qualität des Kühlkonzepts entscheidet sich frühzeitig an den Wärmeübertragerpunkten, Betriebszuständen und der Frage, ob Monitoring und Regelung so integriert sind, dass später auch ein zuverlässiger und effizienter Betrieb sichergestellt werden kann.

Sind die Leistungsgrößen mit herkömmlichen rackbasierten Kühllösungen vergleichbar?

Im Prinzip ja. Bei der Einordnung helfen hier die IT-typischen Systemgrößen. Es gibt kompakte, in sich geschlossene Einheiten, etwa als 24-HE-Self-Contained-Ausführung mit integrierter CDU. In dieser Konfiguration sind bei 12 °C Kaltwasser nominal bis zu 50 kW Kühlleistung pro Behälter möglich. Darüber hinaus gibt es modulare Ausbaustufen mit separaten Tanks und zentraler CDU. In dieser Architektur ist eine Konfiguration von bis zu vier Tanks vorgesehen, die eine Gesamtkapazität von bis zu 240 kW liefern. Je nach Auslegung liegt die nominale Kühlleistung pro Tank typischerweise im Bereich von 60 bis 120 kW. Für die Planung im Bestand und auch für Erweiterungsflächen sind außerdem Gewicht und Handling entscheidend, weil sie Statik, Einbringung und spätere Serviceprozesse direkt beeinflussen. Das Nassgewicht bei einer 24-HE-Standalone-Einheit liegt etwa bei 900 kg, und ein einzelner 42-HE-Tank liegt nass bei 1.100 kg – jeweils ohne zusätzliche IT-Hardware. Das sind genau die Parameter, die Planungsbüros früh berücksichtigen müssen, damit aus einer grundsätzlich guten Technologie am Ende auch ein sauber betreibbares Gesamtsystem wird.

Ab wann lohnt sich denn Immersion Cooling überhaupt?

Eine einfache Daumenregel aufzustellen ist immer verlockend, sie greift in der Praxis aber oft zu kurz. Die Entscheidung für ein bestimmtes Kühlkonzept ergibt sich aus dem Zusammenspiel von Leistungsdichte, Lastprofil, Energiepreis, Flächen- und Ausbaukosten sowie Hardware-Austauschzyklen. Bei moderaten Leistungsdichten ist eine sauber geplante Luftkühlung häufig weiterhin der wirtschaftlichste Ansatz. Im mittleren Dichtebereich ist Direct Liquid Cooling (DLC) oft der pragmatischere Schritt: Man führt die Verlustleistung der GPUs über Kühlplatten direkt ab, während das restliche System in weiten Teilen unverändert bleiben kann. Immersion Cooling wird immer dann besonders attraktiv, wenn Leistungsdichten dauerhaft sehr hoch sind oder wenn KI-Plattformen so kompakt aufgebaut werden müssen, dass alternative Konzepte an ihre physikalischen Grenzen stoßen. Grundsätzlich gilt: Maßgeblich für Auslegung und Wirtschaftlichkeit ist das reale Lastprofil, nicht der absolute Spitzenwert.

Was müssen Planungsbüros bei der Tauchkühlung anders machen als bei klassischer Luftkühlung?

Planungsseitig sind Projekte mit Tauchkühlung deutlich stärker auf Schnittstellen fokussiert, weil IT, Hydraulik, Regelung und Betrieb enger zusammenhängen. Es reicht nicht, sich grundsätzlich für Tauchkühlung zu entscheiden. Man muss den Übergabepunkt zwischen IT-System und Facility-Kreislauf präzise definieren und dabei das Temperatur- und Volumenstromniveau, die Redundanzen sowie die Instandhaltungslogik von Anfang an mitdenken. Genauso wichtig ist die Service- und Wartungssicht. Wartungszugang, sichere Arbeitsprozesse und das Handling von Komponenten und Fluiden müssen in der Auslegung berücksichtigt werden. Das gilt sowohl für das Immersionsfluid im Tank als auch für das Kühlmedium im Sekundärkreislauf. Dazu gehört die Frage, wie im laufenden Betrieb gearbeitet wird, ohne die Verfügbarkeit zu beeinträchtigen.

Ist die Integration von Immersion Cooling auch für Bestandsanlagen sinnvoll?

Grundsätzlich ist das möglich, aber in Bestandsanlagen ist ein Retrofit häufig der anspruchsvollere Weg. Aufstellfläche, Leitungswege und der Umbau im laufenden Betrieb werden schnell zu Kostentreibern. Immersion Cooling ist nicht nur »ein Tank«, sondern muss als System aus Behälter, CDU und Verrohrung mit klar definierten Übergabepunkten geplant werden.

Ein Thema, das Betreiber beschäftigt, ist die Hardware-Kompatibilität und die Garantiebedingungen. Wie sieht der Markt hier aus?

Das muss frühzeitig geklärt werden, da es die TCO-Betrachtung maßgeblich beeinflusst. Wenn man Immersion Cooling als Plattformprojekt aufsetzt, lässt sich das heute bereits sehr gut abbilden. Betreiber brauchen Klarheit darüber, welche Serverplattformen freigegeben sind und wie die Garantie-Modelle sowie RMA-Prozesse (Return Merchandise Authorization) logistisch darstellbar sind. Der Markt entwickelt sich hier sichtbar weiter. Vertiv unterstützt Kunden mit fundierter Beratung bei der Systemintegration sowie bei der Partnerkoordination. Wenn diese Punkte prozessual verankert sind, stellen Garantie und Service heute keine wirklichen Hürden mehr dar.

Welche Orientierung können Sie Betreibern abschließend geben?

Der erste Schritt sollte ein Gespräch mit unseren Experten sein, entweder über den Vertiv-Vertrieb oder einen qualifizierten Systemintegrator. Betreiber, bei denen Hochdichte-Umgebungen bereits konkret budgetiert und zeitlich terminiert sind, etwa bei dedizierten KI-Clustern, sollten jetzt aktiv in die Vorplanung gehen. Zurückhaltender wäre ich, wenn die Leistungsdichte im Mittel eher moderat bleibt. In diesem Fall sind Luftkühlung oder DLC oft der effizientere Weg. Immersion Cooling bleibt dann aber eine valide Option für spezifische High-Density-Zonen. Oft beginnt die Zusammenarbeit mit einem Proof-of-Concept-Projekt.

211 Artikel zu „Kühlung flüssig“

News | Effizienz | Nachhaltigkeit | Rechenzentrum

Hohe Anforderungen an Rechenzentren mit Flüssigkeitskühlung

Flüssigkeitsgekühlte Rechenzentren bieten eine besonders effiziente und nachhaltige Lösung für den Betrieb leistungsstarker KI- und HPC-Systeme und erfüllen dabei strenge Energieeffizienz- und Umweltanforderungen, wie Clark Li, Country Manager von KAYTUS für die DACH-Region bereits im ersten Teil des Interviews erklärt hat. Die Umsetzung solcher Systeme stellt jedoch hohe technische und organisatorische Anforderungen, etwa bei Stromversorgung,…

News | Nachhaltigkeit | Rechenzentrum | Ausgabe 11-12-2024

Direct-to-Chip-Flüssigkeitskühlung – KI und der steigende Energiebedarf der Rechenzentren

KI-Workloads treiben den Energieverbrauch von Rechenzentren deutlich in die Höhe. Neue Algorithmen, energieeffizientere GPUs und innovative Kühlungsansätze können den Stromhunger durchaus reduzieren. Der beste Ansatz ist jedoch die Direct-to-Chip-Flüssigkeitskühlung, um den PUE-Wert zu senken und die Energieeffizienz zu verbessern.

News | Infrastruktur | Nachhaltigkeit | Rechenzentrum | Ausgabe 11-12-2023

Nachhaltigkeit und Performance bei Rechenzentren – Flüssigkeitskühlung gewinnt zunehmend an Bedeutung

Server für KI stoßen schnell an die Grenzen der Luftkühlung. Es ist daher eine Reihe von Flüssigkeitskühlungen erforderlich, von Wärmetauschern an der Rückseite der Tür über die direkte Kühlung des Chips bis hin zum vollständigen Eintauchen des Systems, um den PUE-Wert in einem Rechenzentrum auf nahezu 1,0 zu senken. Michael McNerney, Senior Vice President Marketing and Network Security gibt noch weitere Einblicke in die innovativen Entwicklungen bei Supermicro.

News | Rechenzentrum | Ausgabe 11-12-2021

Flüssigkeitskühlung reduziert den Stromverbrauch im Rechenzentrum – Stay cool

Schätzungen zufolge werden Rechenzentren ab 2021 zwischen 1 und 3 Prozent der weltweiten Stromerzeugung verbrauchen. Ein erheblicher Teil dieses Stroms stammt, je nach geografischer Lage, aus fossilen Brennstoffanlagen. Um den CO₂-Fußabdruck von Rechenzentren zu reduzieren und die Betriebskosten zu senken, sollten neue Technologien implementiert werden, die die Kühlkosten des Rechenzentrums senken und die Power Usage Effectiveness (PUE) erhöhen.

News | Effizienz | Nachhaltigkeit | Rechenzentrum

Flüssigkeitsgekühlte Rechenzentren: Für mehr Nachhaltigkeit und Energieeffizienz

Flüssigkeitsgekühlte Rechenzentren ermöglichen eine effiziente Wärmeableitung und sind besonders für hochdichte KI- und HPC-Anwendungen geeignet, während sie gleichzeitig die Energieeffizienz steigern und Nachhaltigkeitsanforderungen erfüllen. Im Interview erklärt Clark Li, Country Manager von KAYTUS für die DACH-Region, warum umfassende Flüssigkeitskühlungstechnologien und grüne Prinzipien entlang des gesamten Produktlebenszyklus notwendig sind, um gesetzlichen Vorgaben und Umweltverantwortung gerecht zu…

News | Effizienz | Favoriten der Redaktion | Infrastruktur | Künstliche Intelligenz | Nachhaltigkeit | Rechenzentrum

5 Hindernisse beim Aufbau eines flüssigkeitsgekühlten KI-basierten Rechenzentrums (AIDC)

Wie Anwender die komplexe Infrastruktur von AIDCs der nächsten Generation in der Praxis meistern können. Aufgrund der rasanten Entwicklung KI-basierter Technologien der nächsten Generation, wie GenAI und AI4S (KI für die Wissenschaft), müssen Rechenzentren Workloads bewältigen, die noch vor wenigen Jahren unvorstellbar waren. Allerdings stellen der deutsche Branchenverband Bitkom und nationale Studien fest, dass die…

News | Effizienz | Favoriten der Redaktion | Infrastruktur | Nachhaltigkeit | Rechenzentrum | Strategien | Tipps

Direct Liquid Cooling: Der Paradigmenwechsel in der Datacenter-Kühlung

Wie Flüssigkeitskühlung Rechenzentren effizienter, nachhaltiger und zukunftsfähig macht – eine technische und strategische Analyse. Rechenzentren verschlingen weltweit 1,3 % des globalen Stromverbrauchs [1], ein großer Teil davon für die Kühlung. Moderne KI-Anwendungen verstärken dieses Problem dramatisch: Sie erzeugen bis zu fünfmal mehr Abwärme als herkömmliche Server und bringen traditionelle Luftkühlsysteme an ihre Grenzen. Direct…

News | Nachhaltigkeit | Rechenzentrum | Ausgabe 11-12-2024

Innovative Lösungen für Stromversorgung und Kühlung – Neue Herausforderungen und Chancen für Rechenzentren

Künstliche Intelligenz (KI) und High-Performance-Computing (HPC) – diese beiden Technologien verändern nicht nur die Art und Weise, wie die Zukunft gestaltet wird, Produkte entwickelt werden und neue Geschäftsmodelle entstehen. Ihr Einsatz führt auch zu einem noch nie dagewesenen Bedarf an Energie und Kühlung in Rechenzentren. Laut einer aktuellen Studie der German Datacenter Association hat sich seit 2010 die Rechenleistung, die Unternehmen benötigen, aufgrund der fortschreitenden Digitalisierung verzehnfacht [1]. Weltweit wird sich der Strombedarf von Rechenzentren bis 2026 voraussichtlich verdoppeln [2]. Um gleichzeitig die anvisierten und vom Gesetzgeber geforderten Nachhaltigkeitsziele zu erreichen, braucht es im Bereich Stromversorgung und Kühlung innovative Lösungen.

News | Produktmeldung | Rechenzentrum

Rechenzentren: Flüssigkeitsgekühlte KI- und Enterprise-Rack-Scale-Lösungen

Supermicro eröffnet drei neue Produktionsstätten im Silicon Valley und weltweit, um das Wachstum von flüssigkeitsgekühlten KI- und Enterprise-Rack-Scale-Lösungen zu unterstützen. Erweiterte Produktionskapazitäten sollen die weltweite Kapazität an flüssigkeitsgekühlten Racks auf mehr als das Doppelte der heutigen 1.000 pro Monat ausgelieferten KI SuperClusters erhöhen. Supermicro, ein Anbieter von IT-Gesamtlösungen für KI, Cloud, Storage und…

News | Effizienz | Infrastruktur | Lösungen | Rechenzentrum | Ausgabe 1-2-2023

Wasserkühlung – Wenn aus Kühlen Heizen wird

News | Infrastruktur | Lösungen | Rechenzentrum | Ausgabe 7-8-2020

Effiziente Kühlsysteme für stabile und performante Prozesse – Serverkühlung: Das Rückgrat der Digitalisierung

Ob im Home Office oder beim Streaming: Die weltweite Covid-19-Pandemie und damit verbundene Kontaktbeschränkungen führen zu einer starken Auslastung des Datennetzwerks. Damit Rechenzentren überhaupt funktionieren, müssen sie rund um die Uhr gekühlt werden. Als Experte auf dem Gebiet erläutert Ingo Gdanitz, Business Development Manager bei der technotrans SE, die Herausforderungen und Potenziale effizienter Serverkühlung.

News | Trends 2026 | Effizienz | Trends Infrastruktur | Infrastruktur | Rechenzentrum

Investieren, transformieren, wachsen: Fünf Trends für KI-Rechenzentren in Deutschland

Schon heute machen laut Bitkom KI-Datacenter rund 15 Prozent der installierten Kapazitäten in Deutschland aus. Bis 2030 soll dieser Anteil auf 40 Prozent steigen. Doch im internationalen Vergleich hinkt Deutschland nicht zuletzt wegen hoher Baukosten und langer Genehmigungsprozesse deutlich hinterher: Während in den USA und China Mega-Rechenzentren für KI entstehen, sind die Kapazitäten hierzulande deutlich…

News | Effizienz | Lösungen | Nachhaltigkeit | New Work | Services

Rohstoff Energie: Was habe ich damit zu tun?

Das Smartphone, das Auto, die Fabrik oder das Krankenhaus – ohne Energie steht unsere moderne Welt still. Wie können wir also verantwortlicher mit ihr umgehen, damit Ressourcen nicht unnötig verbraucht werden und wir auch morgen noch genug Energie zur Verfügung haben? Mit dieser Frage haben sich Azubis der Friedhelm Loh Group in ihren Projektarbeiten intensiv…

News | Produktmeldung | Rechenzentrum | Services

KI-gestützter vorausschauender Wartungsservice für moderne Rechenzentren und KI-Fabriken

Vertiv Next Predict ist ein neuer KI-gestützter Managed Service, der Fachwissen aus der Praxis mit fortschrittlichen Algorithmen für maschinelles Lernen kombiniert, um Probleme zu antizipieren, bevor sie auftreten. Vertiv, ein weltweit führender Anbieter für kritische digitale Infrastrukturen, stellt mit Vertiv Next Predict einen KI-gestützten Managed Service vor, der die Wartung von Rechenzentren grundlegend verändert.…

News | Infrastruktur | Künstliche Intelligenz | Rechenzentrum | Services

Warum der Betrieb von KI-Rechenzentren zunehmend schwieriger wird

Komplexe KI-Workloads werden 2026 einen stärkeren Bedarf für den Ausbau und die Modernisierung von Rechenzentren auslösen und zudem häufig eine standortübergreifende Zusammenarbeit erfordern. Neben einer Aufrüstung an Hardware und Software ergeben sich dabei auch Herausforderungen an das Management der komplexen Systeme. Denn ein einziger Ausfall kann zu Verlusten von über 1 Million US-Dollar führen. Infrastruktur-Spezialist…

News | Künstliche Intelligenz | Produktmeldung | Rechenzentrum

Supermicro kündigt Unterstützung für NVIDIA Vera Rubin NVL72 und HGX Rubin NVL8 Systeme an

Supermicro, ein Anbieter von IT-Gesamtlösungen für KI, Cloud, Storage und 5G/Edge, kündigt in Zusammenarbeit mit NVIDIA den Ausbau seiner Fertigungs- und Flüssigkeitskühlungskapazitäten an, um frühzeitige Bereitstellungen von Rechenzentrumsplattformen im großen Maßstab zu ermöglichen, die für die neu vorgestellten NVIDIA Vera-Rubin- und Rubin-Plattformen optimiert sind. Dank der beschleunigten Entwicklung und der Zusammenarbeit mit NVIDIA ist Supermicro…

News | Trends 2026 | Trends 2030 | Effizienz | Trends Infrastruktur | Infrastruktur | Künstliche Intelligenz | Rechenzentrum

Von Las Vegas ins Rechenzentrum – was die CES 2026 über die bevorstehende Infrastruktur-Revolution verrät

Auf der CES 2026 war KI allgegenwärtig, was auf eine Infrastruktur-Revolution für Unternehmensrechenzentren hindeutet – dies unterstreicht die Notwendigkeit von KI-fähigen Datenplattformen, die GPUs kontinuierlich mit Daten versorgen können. KI stand auf der vor wenigen Tagen zu Ende gegangenen CES im Mittelpunkt – und die Messe kann eine unerwartete Kristallkugel für Trends in der…

News | Infrastruktur | Produktmeldung | Rechenzentrum

Antwort auf den KI-Bedarf: Vertiv präsentiert Strategie zur schnellen Skalierung weltweiter Rechenkapazitäten

Der amerikanische Spezialist für kritische digitale Infrastruktur in Rechenzentren und Kommunikationsnetzen sowie in gewerblichen und industriellen Umgebungen unterhält in Europa mehrere Standorte, darunter strategisch wichtige Produktionsstätten in der Region Venetien. Hier werden Kerntechnologien wie hochpräzise Klimasysteme, Kaltwassersätze (Chiller) und unterbrechungsfreie Stromversorgungen (USV) entwickelt und für den globalen Markt gefertigt. Das Unternehmen Vertiv ist aus dem…

News | Trends 2026 | Trends Infrastruktur | IT-Security | Künstliche Intelligenz | Rechenzentrum

Quantencomputer, KI-Agenten und neue Rechenzentren: Die IT-Welt steht 2026 Kopf

Das neue Jahr eröffnet Unternehmen viele neue Chancen – angetrieben durch Technologien, die die IT-Landschaft grundlegend verändern werden. Fortschritte in Quantencomputing, agentenbasierter KI und Rechenzentrumsarchitektur ebnen den Weg für mehr Effizienz, Intelligenz und Skalierbarkeit. Ein Spezialist für Out-of-Band-Managementlösungen zum Schutz kritischer Infrastrukturen beleuchtet die Trends für 2026 und zeigt auf, welche Schritte IT-Teams ergreifen können,…

News | Business | Trends 2025 | Trends Wirtschaft | Rechenzentrum

Rechenzentren treiben Frankfurts Wirtschaftswachstum hoch – trotzt Hürden für Betreiber

Rechenzentren sind das Fundament der digitalen Wertschöpfung in Frankfurt und der gesamten Region Rhein-Main. Die neue Studie von IW und Detecon liefert dazu eindeutige Zahlen und zeigt, dass die Branche im Gegensatz zur Gesamtwirtschaft Rekordzuwächse verzeichnet. Davon profitieren auch die Stadt sowie die gesamte Region RheinMain. Das BIP der Rechenzentrumsbranche hat sich in den…