Illustration Absmeier foto freepik

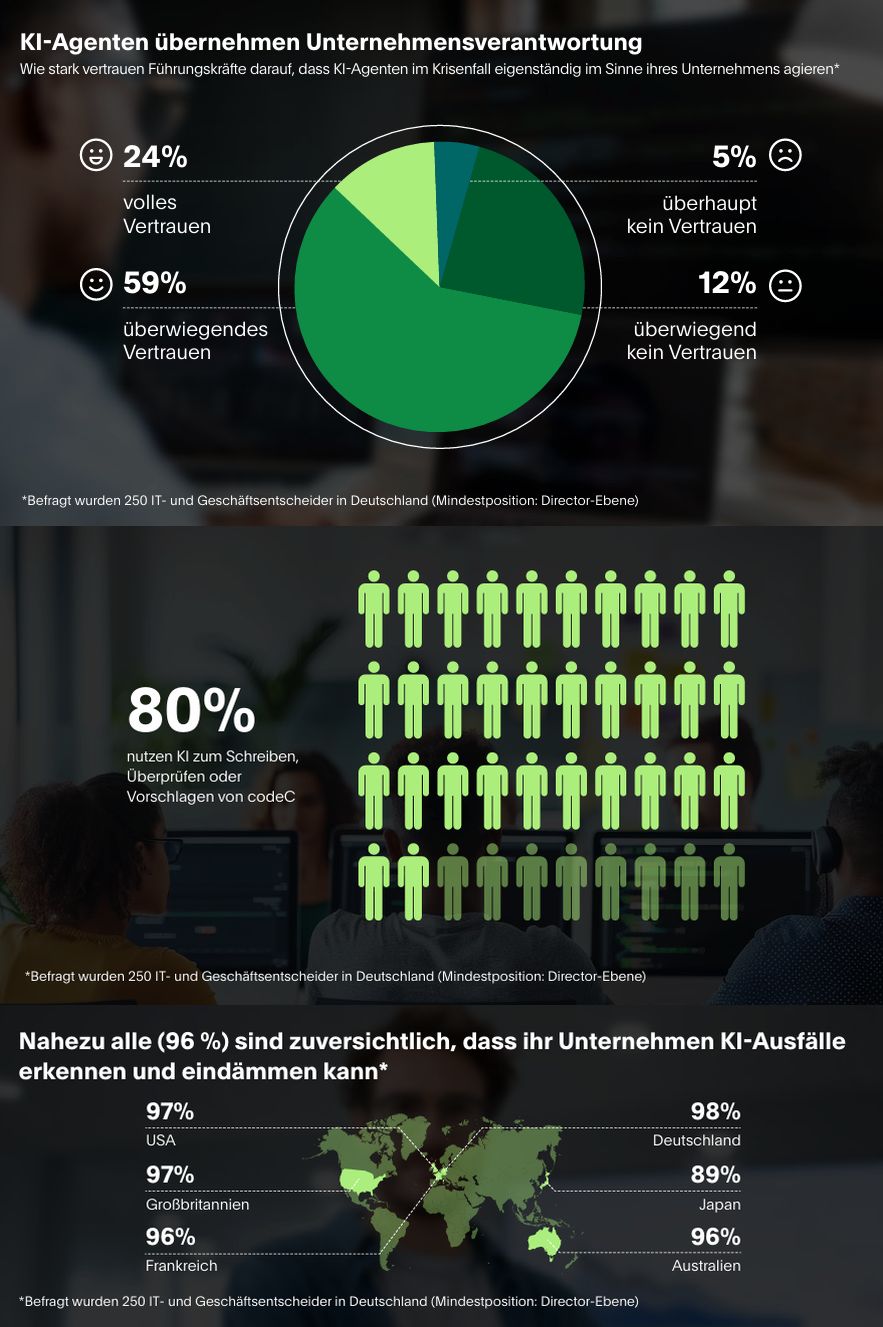

KI-Agenten (engl. »AI agents«) erobern die Arbeitswelt, doch der Hype birgt auch Gefahren. Während Unternehmen weltweit auf diese Technologie setzen, zeigt sich: Schnelligkeit geht oft zu Lasten der Sicherheit. Nach einer aktuellen IBM-Studie sehen Unternehmen KI-Agenten nicht länger als Experiment, sondern als unverzichtbaren Bestandteil ihrer digitalen Transformation [1]. Führungskräfte erwarten bis 2025 einen achtfachen Anstieg von KI-gestützten Arbeitsabläufen. Sie versprechen sich davon eine höhere Prozesseffizienz, sinkende Kosten und veränderte Workflows. Bereits 69 Prozent der Führungskräfte sehen in der verbesserten Entscheidungsfindung den größten Nutzen von KI-Agenten.

Doch ihre wachsende Bedeutung geht mit erheblichen Risiken einher. Eine Analyse von Palo Alto Networks zeigt, dass drei von vier laufenden agentenbasierten KI-Projekten erhebliche Sicherheitsprobleme bergen. Der Grund liegt weniger im Code, sondern in fehlender Governance. In über 3.000 Gesprächen mit europäischen Führungskräften wurde deutlich, dass viele Projekte ohne klare Zieldefinitionen, verbindliche Kontrollmechanismen oder abgestimmte Sicherheitsrichtlinien gestartet werden. Doch welche Risiken stehen im Zentrum? Und wie können Unternehmen ihnen begegnen?

Hier ein Überblick:

- Fehlende Zieldefinition: Wenn Projekte ins Leere laufen

Viele Unternehmen beginnen ihre agentenbasierten KI-Initiativen mit der Technologie, nicht mit den Zielen. Projekte starten, ohne zuvor messbare Geschäftsziele oder Risikogrenzen festzulegen. Dieser »Outcome Drift« führt zu Abweichungen, unklaren Verantwortlichkeiten und steigenden Budgets, während der Mehrwert ausbleibt. Laut Gartner drohen bis 2027 etwa 40 Prozent der Projekte abgebrochen zu werden, weil keine klaren Zielsetzungen vorhanden sind [2].

Der Ansatz muss sein, Projekte rückwärts zu denken. Nur wenn Unternehmen zu Beginn zwei bis drei konkrete, vom Vorstand genehmigte Ziele festlegen, lassen sich Investitionen steuern und Risiken begrenzen. Ausgehend von gewünschten Ergebnissen und Benchmarks wird die Architektur von KI-Agenten so entwickelt, dass jede Handlung einer autorisierten Identität mit dokumentiertem Zweck zugeordnet werden kann. Dadurch entstehen weniger blinde Flecken und Projekte bleiben steuerbar.

- Zu weit gefasste Berechtigungen: Wenn Agenten mehr dürfen, als sie sollten

Ein häufiges Problem in der Praxis ist die Vergabe übermäßiger Zugriffsrechte. Agenten erhalten volle Systemrechte oder unzureichend überwachte Berechtigungen. Das ist vergleichbar damit, einem Praktikanten uneingeschränkten Zugang zu allen Unternehmenssystemen zu geben – es erhöht das Risiko unnötig und entspricht nicht dessen Aufgabenfeld. Dieses Vorgehen öffnet Angreifern Tür und Tor.

Abhilfe schaffen Leitplanken, die von Beginn an in die Planung und das Design eingebaut werden. Jede Handlung muss klar autorisiert, nachvollziehbar und im Zweifel durch einen Menschen überprüft werden.

Dazu zählen Zero-Trust-Prinzipien, Identitäts- und Privilegientrennung sowie Kontrollen von untergeordneten Agenten. Kurzlebige Zugangsdaten, mehrstufige Authentifizierung und eine strikte Trennung von Berechtigungen verhindern Kontrollverlust. Ebenso zum Fundament gehören dabei Aktionsprotokolle und kontinuierliche Überwachung. Grundsätzlich gilt: Unternehmen sollten Agenten wie eigenständige Identitäten behandeln. So wird blindes Vertrauen durch sorgfältige Kontrolle ergänzt.

- Governance-Lücken: Wenn wichtige Akteure außen vor bleiben

Das dritte Risiko ist fehlende Governance. Noch immer betrachten viele Unternehmen agentenbasierte KI als isoliertes IT-Projekt. Bereiche wie Recht, Betrieb, Compliance oder Risikomanagement werden erst spät einbezogen – oder gar nicht. So entstehen Schattenprojekte, Verantwortlichkeiten bleiben unklar und die Sicherheit gerät ins Hintertreffen.

Palo Alto Networks empfiehlt daher die Einrichtung eines »Governance Council«. Dieses funktionsübergreifende Gremium soll klare Entscheidungsrechte besitzen, regelmäßig an den Vorstand berichten und verbindliche Standards setzen. Governance wird so zur Grundlage, die Projekte widerstandsfähig, regelkonform und strategisch abgestimmt macht. Unternehmen, die frühzeitig alle relevanten Akteure einbinden und diese Strukturen fest im Board verankern, schaffen damit nicht nur Sicherheit, sondern auch die Basis für eine langfristig erfolgreiche Implementierung von KI-Agenten.

Best Practices

Um agentenbasierte KI-Projekte sicher aufzusetzen, sollten Unternehmen bereits im nächsten Quartal folgende Maßnahmen prüfen:

Governance

- Ein »Agentic Governance Council« einrichten und Verantwortlichkeiten klar festlegen

- Ein zentrales Register führen, das alle Agenten, Datenzugriffe und Verantwortliche dokumentiert

- Vor dem Go-live realistische Szenarien und Stresstests («Premortems«) durchführen

Zieldefinitionen

- Pro Anwendungsfall messbare Ziele definieren und Risiken mit Grenzwerten versehen

- Kritische, irreversible Entscheidungen grundsätzlich einem Menschen vorbehalten

- Jede Aktion einer autorisierten Identität mit klar dokumentiertem Zweck zuordnen

Schutzmechanismen

- Sichtbarkeit und Kontrolle bei KI-Applikationen

- Identitäten von Menschen, Systemen und Agenten unter einer einheitlichen Sicherheitsrichtlinie verwalten

- Zugriffsrechte strikt nach dem Prinzip »Least Privilege« vergeben und regelmäßig erneuern

- Ein kontinuierliches Monitoring etablieren und Menschen in kritische Freigaben einbinden

Ohne klare Zieldefinition, Berechtigungsgrenzen, Leitplanken und automatisierte Kontrollmechanismen drohen bestehende Schwachstellen in Netzwerk-, Cloud- und SaaS-Umgebungen noch verstärkt zu werden. »Die Ergebnisse machen deutlich, dass es bei KI-Agenten nicht um reine Technik geht, sondern um die richtigen Rahmenbedingungen«, so Thomas Maxeiner, Director Technical Solutions bei Palo Alto Networks. »Von Anfang an müssen Governance, klare Zielsetzungen und sichere Identitätskontrollen mitgedacht werden. Nur so lassen sich Innovation und Sicherheit in Einklang bringen.«

[1] https://de.newsroom.ibm.com/IBM-Studie-Unternehmen-betrachten-KI-Agenten-als-unverzichtbar-und-nicht-nur-experimentell

[2] https://www.gartner.com/en/newsroom/press-releases/2025-06-25-gartner-predicts-over-40-percent-of-agentic-ai-projects-will-be-canceled-by-end-of-2027

Verantwortungsbewusster Einsatz von KI-Agenten: Maßnahmen und Empfehlungen

Illustration Absmeier foto freepik ki

Es gibt mehr Herausforderungen und Risiken, die mit der Einführung von KI-Agenten in Unternehmen verbunden sind, als bisher angenommen. Gerade Unternehmen, die bereits KI-Agenten einsetzen, haben ein höheres Bewusstsein für die damit verbundene Management-Komplexität, und erkennen, dass diese Komplexität oft die verfügbaren Mitarbeiterressourcen übersteigt. Ohne klare Governance, Ressourcenplanung und Transparenz drohen erhebliche Risiken wie Überlastung, Sicherheitslücken und Kontrollverlust. Konkrete Maßnahmen für einen verantwortungsbewussten Einsatz von KI-Agenten helfen, diese Risiken zu minimieren.

Unternehmen, die bereits KI-Agenten einsetzen, zeigen ein größeres Bewusstsein für die bevorstehenden Management-Herausforderungen. Unter den von PagerDuty Befragten, deren Unternehmen nur einen KI-Agenten einsetzen, sind 67 % der Meinung, dass die KI-bedingte Komplexität die Anzahl der Mitarbeiter übersteigen wird, die ihr Unternehmen für deren Verwaltung zur Verfügung hat [1]. Diese Sorge ist unter denjenigen, die mehrere KI-Agenten im Einsatz haben, mit 76 % noch höher. Im Gegensatz dazu rechnen nur 23 % der Befragten von Unternehmen ohne KI-Agenten mit dieser Herausforderung.

Schlussfolgerung: Erst durch die praktische Umsetzung von KI-Lösungen wird das tatsächliche Ausmaß der organisatorischen und operativen Komplexität deutlich.

Dieser Befund ist hochinteressant und lässt sich als Warnsignal für Unternehmen interpretieren, die KI-Agenten einführen wollen. Die Kernaussagen und ihre Bedeutung:

Bedeutung für das Management

- Illusion der Einfachheit

- Von außen wirkt KI oft wie ein »Plug-and-Play«-Tool.

- In der Praxis zeigt sich: Mehr Agenten = mehr Schnittstellen, Abhängigkeiten und Kontrollbedarf.

- Ressourcenfalle

- Unternehmen unterschätzen, wie viele Fachkräfte für Governance, Monitoring und Compliance nötig sind.

- KI ersetzt nicht automatisch Personal, sondern verschiebt Aufgaben in Richtung Steuerung und Kontrolle.

- Governance-Defizite

- Ohne klare Regeln für Rollen, Verantwortlichkeiten und Eskalationsprozesse droht Chaos.

- KI-Agenten können Entscheidungen beschleunigen – aber auch Fehler potenzieren, wenn niemand die Aufsicht hat.

- Lernkurve durch Erfahrung

- Unternehmen ohne KI-Einsatz sehen die Risiken noch nicht.

- Erst im Betrieb wird sichtbar, wie komplex Modell-Drift, Datenqualität, Transparenz und Security wirklich sind.

Die Zahlen zeigen deutlich: Je tiefer Unternehmen in KI einsteigen, desto klarer erkennen sie die Management-Herausforderungen. Wer heute noch glaubt, KI-Agenten seien ein Selbstläufer, wird morgen von der Realität eingeholt.

Handlungsempfehlungen für Führungskräfte.

- Frühzeitig Governance etablieren (Rollen, Prozesse, Eskalationspfade).

- Ressourcen für Monitoring & Compliance einplanen.

- Transparenz schaffen – nachvollziehbare Entscheidungen der KI-Agenten.

- Schrittweise Skalierung statt unkontrollierter Einführung mehrerer Agenten.

Nur so lässt sich verhindern, dass die versprochene Effizienz von KI in operative Überlastung und Kontrollverlust umschlägt.

KI-Agenten sind keine Selbstläufer.

Wer die Einführung von KI-Agenten nicht mit klarer Governance, Ressourcenplanung und Transparenz begleitet, riskiert Überlastung und Kontrollverlust. Welche Gefahren drohen und welche konkreten Maßnahmen sind notwendig um KI-Agenten verantwortungsbewusst einzusetzen.

KI-Agenten entfalten ihr Potenzial nur dann, wenn Unternehmen sie kontrolliert und verantwortungsbewusst einsetzen. Ohne klare Leitplanken drohen erhebliche Risiken. Hier die Gefahren und die notwendigen Maßnahmen in strukturierter Form zusammengefasst:

Gefahren beim unbedachten Einsatz von KI-Agenten

- Überlastung & Kontrollverlust

- Mehrere Agenten erzeugen exponentiell steigende Komplexität.

- Fehlende Ressourcen für Monitoring führen zu Blindflug.

- Sicherheitsrisiken

- KI-Agenten greifen auf sensible Daten zu (Kunden, Finanzen, IP).

- Studien zeigen: 96 % der Experten sehen KI-Agenten als wachsende Angriffsfläche.

- Gefahr von Datenlecks, Missbrauch oder Manipulation (z. B. durch Prompt Injection).

- Rechtliche & Compliance-Probleme

- DSGVO-Verstöße durch unkontrollierte Datenverarbeitung.

- Unklare Haftungsfragen bei Fehlentscheidungen oder Schäden.

- Fehlerhafte Entscheidungen & Halluzinationen

- KI-Agenten können falsche Schlüsse ziehen oder ungewollte Aktionen ausführen.

- Ohne menschliche Kontrolle droht operative Instabilität.

- Ethische Risiken & Bias

- Verzerrte Trainingsdaten führen zu Diskriminierung oder unfairen Entscheidungen.

- Reputationsschäden durch intransparente Ergebnisse.

Konkrete Maßnahmen für verantwortungsbewussten Einsatz

- Governance & Richtlinien

- Einführung klarer KI-Guidelines (Nutzungszwecke, Datenarten, Verantwortlichkeiten).

- Einrichtung eines KI-Governance-Boards mit IT, Recht, Compliance und Fachbereichen.

- Ressourcenplanung

- Aufbau von KI-Operations-Teams (vergleichbar mit DevOps/SecOps).

- Schulung der Mitarbeiter im Umgang mit KI-Agenten.

- Transparenz & Nachvollziehbarkeit

- Dokumentation aller KI-Entscheidungen (Audit-Trails).

- Einsatz von Explainable AI (XAI), um Ergebnisse nachvollziehbar zu machen.

- Sicherheitsarchitektur

- Identitäts- und Zugriffsmanagement für KI-Agenten (wie für menschliche Nutzer).

- Kontinuierliches Monitoring auf Anomalien, Modell-Drift und Fehlverhalten.

- Schrittweise Einführung

- Start mit Pilotprojekten in klar abgegrenzten Prozessen.

- Skalierung erst nach erfolgreicher Validierung und Risikobewertung.

- Notfall- und Eskalationspläne

- Definierte Prozesse für KI-Ausfälle oder Fehlentscheidungen.

- »Human-in-the-Loop«-Mechanismen für kritische Entscheidungen.

Management-Essenz

- Gefahr: Ohne Governance, Ressourcen und Transparenz drohen Überlastung, Sicherheitslücken, Kontrollverlust.

- Maßnahme: KI-Agenten wie digitale Mitarbeiter behandeln – mit klaren Rollen, Rechten, Monitoring und Rechenschaftspflichten.

Damit wird klar: KI-Agenten sind kein Selbstläufer. Sie brauchen denselben organisatorischen Rahmen wie Menschen – nur dann werden sie zum echten Wettbewerbsvorteil statt zum Risiko.

Genki Albert Absmeier

[1] https://www.pagerduty.com/resources/insights/learn/executives-adopting-ai-agents/

Quelle: PagerDuty (c)

4270 Artikel zu „KI Risiken“

News | Künstliche Intelligenz | New Work | Strategien

Bachelorarbeit und KI – Chancen und Risiken bei der akademischen Abschlussarbeit

Die künstliche Intelligenz ist in unserem Leben allgegenwärtig. Auch in den Hochschulen und Universitäten hat sie längst Einzug gehalten. Referate, Seminararbeiten und Abschlussarbeiten erstellen die Studierenden ganz oder teilweise mithilfe von Apps wie ChatGPT, Go Thesis oder DeepL Write. Vor allem wenn der Zeitdruck groß wird, wie am Ende des Studiums, wird gern KI eingesetzt.…

Trends 2025 | News | Trends Security | IT-Security | Künstliche Intelligenz

Insider-Bedrohungen und KI-blinde Flecken befeuern Dateisicherheitsrisiken

Einheitliche, mehrschichtige Plattformen zur resilienten Verteidigung werden immer wichtiger. Eine neue Studie zeigt, dass Unternehmen zunehmend mit Sicherheitsrisiken durch Insider-Aktivitäten, veralteten Tools und die wachsende Komplexität von KI konfrontiert sind [1]. Die von OPSWAT in Auftrag gegebene Studie, die vom unabhängigen Ponemon Institute durchgeführt wurde, ergab, dass 61 Prozent der Unternehmen in den letzten…

Trends 2025 | News | Trends Infrastruktur | Industrie 4.0 | IT-Security | Künstliche Intelligenz | Whitepaper

Zunehmende Cyberrisiken in der Fertigung: 61 Prozent der Cybersicherheitsexperten planen Einführung von KI

Laut des Berichts zum Stand der intelligenten Fertigung zählt Cybersicherheit mittlerweile nach der Wirtschaftslage zu den größten externen Bedenken. Rockwell Automation hat die Ergebnisse des zehnten Jahresberichts zum Stand der intelligenten Fertigung bekannt gegeben. Der Bericht basiert auf Erkenntnissen von über 1500 Führungskräften in der Fertigung aus 17 der wichtigsten Industrieländer und zeigt: Cybersicherheit…

Trends 2025 | News | Trends Security | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | Services

Umgang mit KI-Risiken: Identity, Zugriff und Kontrolle

Datenschutz und Sicherheitsrisiken durch KI bereiten Führungskräften die größten Sorgen. Damit KI-Agenten die ihnen zugedachten Aufgaben erfüllen können, benötigen sie oft Zugriff auf die Daten, Systeme und Ressourcen des Unternehmens. Je mehr Zugriff sie dabei besitzen, desto mehr können sie leisten. Daher drängt es sich – vor allem in dieser »Wild-West-Phase« der Tests und Experimente…

News | Business | Künstliche Intelligenz | Strategien | Tipps

Schatten-KI im Unternehmen: Risiken erkennen, Vertrauen sichern

Wer glaubt, dass das KI-Zeitalter nur positive Überraschungen parat hat, irrt gewaltig. Eine neue Herausforderung nimmt bereits Form an: die Schatten-KI. Gemeint ist der unkontrollierte Einsatz von KI-Tools außerhalb formeller Governance-Strukturen, also ohne Freigabe oder Überwachung durch IT, Security oder Compliance. Schatten-KI verbreitet sich sogar noch schneller, als das seinerzeit bei der Schatten-IT der Fall…

News | Cloud Computing | Digitalisierung | Infrastruktur | Künstliche Intelligenz | Ausgabe 5-6-2025

Zwischen Fachkräftemangel, Cyberrisiken, souveräne Clouds und KI-Potenzial – Ernstfall Digitalisierung

Seit Anfang des Jahres ist Kai Grunwitz neuer Vorsitzender der Geschäftsführung von Kyndryl Deutschland. Im Gespräch mit »manage it« spricht er über den unterschätzten Reiz des Mainframes, warum Mut zur Digitalisierung wichtiger ist als jede Regulierung – und wie technologische Allianzen mit Microsoft & Co. zum Schlüssel für resiliente Infrastrukturen werden.

Trends 2025 | News | Trends Security | IT-Security | Künstliche Intelligenz | Whitepaper

KI boomt – die Sicherheitsrisiken auch

Generative künstliche Intelligenz (Generative Artificial Intelligence, GenAI) ist im Jahr 2025 keine experimentelle Technologie mehr, sondern eine unternehmenskritische Lösung, die Unternehmen unterstützt, innovativ zu arbeiten und Daten zu schützen. Zwar ermöglicht GenAI theoretisch beispiellose Produktivitätssteigerungen, gleichzeitig führt sie zu neuen, komplexen Risiken: Während der GenAI-Traffic 2024 um über 890 Prozent gestiegen ist, haben sich sicherheitsrelevante Vorfälle…

News | Blockchain | Digitalisierung | Favoriten der Redaktion | Künstliche Intelligenz | Strategien

Deutschland im KI-Wettlauf: Chancen nutzen, Risiken minimieren, Infrastrukturen bereitstellen

Künstliche Intelligenz (KI) ist die Schlüsseltechnologie für Innovationen, Effizienz und Wettbewerbsfähigkeit. Wie können deutsche Unternehmen die Chancen von KI nutzen, mutig voranschreiten und bestehende Hürden bei der breiten Umsetzung überwinden? Auf dem 14. Frankfurter Symposium für Digitale Infrastruktur am 22.05.2025 in der Union Halle wurden diese Themen gerade diskutiert und konkrete Handlungsempfehlungen erarbeitet. Dabei standen…

News | Trends Security | IT-Security | Strategien | Tipps

So gehen Unternehmen Sicherheitsrisiken innerhalb der KI- und Softwarelieferketten an

Die Anzahl der Unternehmen, die sogenannte Adversarial Tests (Angriffsfälle) durchführen, hat sich im Vergleich zum Vorjahr verdoppelt. Die Anzahl der Unternehmen, die eine Software Composition Analysis (SCA) für Code-Repositorien nutzen, ist um 67 % gestiegen. Die Zahl der Firmen, die Forschungsgruppen beschäftigen, um neue Angriffsmethoden zu entwickeln, hat sich um 30 % erhöht. Die Zahl…

Trends 2025 | News | Trends Security | IT-Security

Cybersecurity-Trends für 2025: Manipulative KI, Techno-Nationalismus und Risiken für Open-Source-Projekte

2025 markiert einen Wendepunkt im Bereich der Cybersecurity: Manipulative KI-Systeme, der wachsende Einfluss von Techno-Nationalismus und gezielte Angriffe auf Open-Source-Projekte treiben die Fragmentierung und Komplexität der Bedrohungsszenarien auf ein neues Niveau. Der aktuelle Threatscape Report 2025 zeigt eindringlich, welche Cyberherausforderungen dieses Jahr zu erwarten sind und wie dadurch die digitale Souveränität von Staaten und die…

News | Effizienz | IT-Security | Ausgabe 1-2-2024 | Security Spezial 1-2-2024

Die beste Technologie zur Verwaltung der Netzwerkinfrastruktur – Cyberrisiken effizient eindämmen

Unternehmen jeder Größe sehen sich einer wachsenden IT-Bedrohungslandschaft gegenüber. Gleichzeitig steigen die Anforderungen an die Leistungsfähigkeit der Netzwerkinfrastruktur. Bei vielen Unternehmen steht zudem die Migration in die Cloud an. Welche Herausforderungen kommen daher auf Unternehmen zu und wie kann man Effizienz mit Sicherheit verbinden? Darüber haben wir mit Professor Avishai Wool, Mitgründer und CTO von AlgoSec, gesprochen.

News | Business | Favoriten der Redaktion | Künstliche Intelligenz | New Work

Generative KI: Vier Risiken, die Unternehmen adressieren sollten

Generative KI-Systeme wie ChatGPT und Copilot haben ihren Siegeszug gestartet und werden sich nicht mehr stoppen lassen. Technologien, die eigenständig Texte und Bilder über einfache Prompts erstellen und Ideen generieren können, haben die Art, wie wir kreativ denken und Probleme lösen, in kurzer Zeit signifikant verändert. Obwohl die (generative) KI anfangs auf einige Vorbehalte stieß…

News | Trends 2023 | Künstliche Intelligenz

Generative KI: mehr Vorteile als Risiken

Die Risiken generativer künstlicher Intelligenz – wie Verletzungen des Urheberrechts oder der Cybersicherheit – sind offenkundig. Dennoch glauben international drei von vier Manager, dass ihre Vorteile größer sind als die damit verbundenen Probleme; in Deutschland sagen dies gut zwei Drittel. Nahezu alle Führungskräfte (96 Prozent international, 99 Prozent in Deutschland) stellen fest, dass generative KI…

News | IT-Security | Künstliche Intelligenz | Tipps

Zwischen DSVGO und AI Act – Wie Unternehmen beim Einsatz von KI rechtliche Risiken im Blick behalten

Fünf Jahre ist die DSGVO nun in Kraft und die Europäische Kommission will die Regelung noch im ersten Halbjahr verbessern. Konkret sollen verbindliche Fristen für die Weiterleitung von Beschwerden und eine generelle Bearbeitungsfrist kompletter Beschwerdeverfahren eingeführt werden. Das Thema KI wird die EU separat im »AI Act« regeln, wobei DSGVO und KI eng verflochten sind,…

News | Blockchain | Business | Künstliche Intelligenz

Banken und Finanzdienstleister: KI weist den Weg zu hohen Umsätzen bei niedrigen Risiken

Die Lösung des ewigen Zielkonflikts zwischen Umsatz und Risiko ist für Banken zur Existenzfrage geworden. Zu hohe Risiken sind genauso geschäftsschädigend wie zu hohe Umsatzhürden. Die richtige Balance zu finden, ist quasi die hohe Kunst des Bankings, bei der digitale Plattformen eine immer wichtigere Rolle spielen. Pegasystems erklärt, warum. Die Situation im Bankensektor ist…

News | Kommentar | Künstliche Intelligenz

Risiken für Unternehmen: Führungskräfte implementieren KI ohne Strategie

Gartner stellte kürzlich im Rahmen seines Berichts Hype Cycle for Emerging Technologies die 25 wichtigsten neuen Technologien für Unternehmen vor. Die Schlüsselerkenntnisse wurden aus über 2.000 Technologien ermittelt, die jedes Jahr untersucht werden. Zu den Ergebnissen zählt die beschleunigte Automatisierung durch künstliche Intelligenz (KI). Die Studie kommt zu dem Schluss, dass u.a. diese Technologie zwar…

News | Favoriten der Redaktion | IT-Security

Remote Learning und Remote Working: Chancen und Risiken für die App-Sicherheit

Illustration: Geralt Absmeier Covid-19 hat viele von uns gezwungen, sich sehr schnell mit neuen Realitäten auseinanderzusetzen. Dazu gehören Remote Learning und Remote Working. Kinder und Erwachsene, Eltern und Lehrer sowie ein großer Teil der Erwerbstätigen sind betroffen. Mobile Apps und Webanwendungen wurden vor der Corona-Krise in erster Linie im geschäftlichen Umfeld oder im Freizeitbereich eingesetzt.…

News | Blockchain | Business | Trends 2018 | Infrastruktur | IT-Security | Künstliche Intelligenz | Rechenzentrum | Tipps

Einsatz von künstlicher Intelligenz zur Erkennung und Reaktion auf Cryptojacking – Risiken nicht unterschätzen

Da digitale Währungen auch bei Cyberkriminellen immer beliebter werden, fallen mehr und mehr IT-Nutzer dem Cryptojacking zum Opfer. Dabei wird fremde Computerleistung für das »Schürfen« digitaler Währungen abgeschöpft. In letzter Zeit sind große, namhafte Unternehmen wie Tesla und Youtube Opfer von Cryptomining-Malware geworden. Branchen wie der Bildungs- und Gesundheitssektor sind besonders anfällig, wobei 85 Prozent…

Trends 2025 | News | Trends Wirtschaft | Business | Digitalisierung | Effizienz | Favoriten der Redaktion | Geschäftsprozesse | Künstliche Intelligenz | New Work

KI-Revolution: Management betrachtet KI-Agenten mit Neugier

Von allen Trend-Technologien werden KI-Agenten die Wertschöpfung der Wirtschaft am meisten stärken: 44 Prozent der deutschen Entscheider trauen ihnen zu, für den größten Produktivitätsschub zu sorgen, im Vergleich zu smarten Maschinen (42 Prozent), Quantencomputern (40 Prozent) und humanoiden Robotern (26 Prozent). Das zeigt eine repräsentative Civey-Umfrage im Auftrag von Microsoft Deutschland [1]. Den Einsatz von…

Trends 2025 | News | Trends Wirtschaft | Business | Cloud Computing | Digitalisierung | Geschäftsprozesse | Services | Strategien

KI wird Monetarisierung von Software deutlich verändern

KI-fähige Produkte und Funktionen drücken die Margen, nutzungsbasierte Monetarisierung ist mittlerweile Mainstream und Datenlücken verstärken die Herausforderungen bei der Kundenbindung. Revenera, Anbieter von Plattformen zur Software-Monetarisierung, Open-Source-Compliance und Installation, präsentiert den »Revenera Monetization Monitor: Software Monetization Models & Strategies 2026 Outlook«. Die Umfrage unter mehr als 500 Anbietern legt dabei unter anderem die aktuellen…