foto freepik ki

Desinformation ist zu einer der hartnäckigsten Herausforderungen des digitalen Zeitalters geworden. Das Ausmaß und die schnelle Verbreitung von Fehlinformationen können demokratische Institutionen, die öffentliche Sicherheit und das Vertrauen in Institutionen bedrohen. Das Tempo und die Raffinesse von Desinformationen haben sich über die Reichweite traditioneller Gegenmaßnahmen hinaus beschleunigt. Wenn manipulierte Videos in wenigen Stunden Millionen erreichen können, reicht es nicht mehr aus, Falschinformationen nachträglich zu korrigieren. Aber die Möglichkeit besteht: Durch den Aufbau intelligenter und transparenter Informationssysteme, die mit der Geschwindigkeit und Reichweite von Desinformationen mithalten können, lässt sich der öffentliche Zugang zu faktischen und kontextualisierten Nachrichten dauerhaft sichern.

Die Grenzen traditioneller Werkzeuge

Faktenprüfungs-Websites, digitale Bildungsprogramme und Moderationsrichtlinien sozialer Plattformen sind grundsätzlich reaktiv. Sie identifizieren Falschinformationen, nachdem sie bereits ein Publikum erreicht haben – zu diesem Zeitpunkt ist der Schaden oft bereits angerichtet. Verschärft wird dies durch veränderte Konsumgewohnheiten. Viele Menschen nutzen keine verifizierten Nachrichtenquellen mehr, sondern begegnen Informationen in algorithmusgesteuerten Feeds, die aus dem ursprünglichen Kontext gerissen wurden. So entstehen Echokammern voller Fehlinformationen, die korrekte Informationen kaum noch durchbrechen können. Sogar Suchmaschinen und Large-Language-Modelle können unbeabsichtigt zum Problem beitragen, indem sie glaubwürdigen Journalismus mit Meinungsblogs und erfundenen Inhalten mischen. Eine Anfrage zu einem umstrittenen Thema könnte ein Durcheinander aus verschiedensten Quellen ans Licht bringen – was den Einzelnen dazu zwingt, herauszufinden, was wahr und vertrauenswürdig ist. Generative KI-Plattformen verschärfen die Situation, indem sie nicht verifiziertes Material in fließende, selbstbewusst klingende Antworten mischen und Falschinformationen mit dem gleichen Gewicht wie Fakten präsentieren.

Faktenprüfungs-Websites, digitale Bildungsprogramme und Moderationsrichtlinien sozialer Plattformen sind grundsätzlich reaktiv. Sie identifizieren Falschinformationen, nachdem sie bereits ein Publikum erreicht haben – zu diesem Zeitpunkt ist der Schaden oft bereits angerichtet. Verschärft wird dies durch veränderte Konsumgewohnheiten. Viele Menschen nutzen keine verifizierten Nachrichtenquellen mehr, sondern begegnen Informationen in algorithmusgesteuerten Feeds, die aus dem ursprünglichen Kontext gerissen wurden. So entstehen Echokammern voller Fehlinformationen, die korrekte Informationen kaum noch durchbrechen können. Sogar Suchmaschinen und Large-Language-Modelle können unbeabsichtigt zum Problem beitragen, indem sie glaubwürdigen Journalismus mit Meinungsblogs und erfundenen Inhalten mischen. Eine Anfrage zu einem umstrittenen Thema könnte ein Durcheinander aus verschiedensten Quellen ans Licht bringen – was den Einzelnen dazu zwingt, herauszufinden, was wahr und vertrauenswürdig ist. Generative KI-Plattformen verschärfen die Situation, indem sie nicht verifiziertes Material in fließende, selbstbewusst klingende Antworten mischen und Falschinformationen mit dem gleichen Gewicht wie Fakten präsentieren.

Agentenbasierte KI: eine proaktive Lösung

Hier kommt agentenbasierte KI ins Spiel: eine Klasse künstlicher Intelligenz, die weit über grundlegende Abruf- oder Zusammenfassungsfunktionen hinausgeht. Im Gegensatz zur traditionellen KI, die möglicherweise die statistisch wahrscheinlichste Antwort liefert, ist agentenbasierte KI darauf ausgelegt, mit Absicht zu handeln. Sie interpretiert Nuancen hinter einer Frage, versteht den Kontext und ruft Informationen ausschließlich aus vertrauenswürdigen, vorab genehmigten Quellen ab. Jede Tatsache wird mit einem Quellennachweis versehen, was dem Nutzer eine sofortige Überprüfung ermöglicht. Anstatt jede Frage isoliert zu behandeln, hält sie den Gesprächsfaden aufrecht und passt sich an, während sich die Diskussion weiterentwickelt. Bei mehrdeutigen Anfragen wird nicht geraten – es wird nachgefragt, geklärt und der Nutzer zu einer präzisen Antwort geführt. Diese Fähigkeit, autonomes Denken, kontextuelles Verständnis und überprüfbare Ergebnisse zu kombinieren, macht agentenbasierte KI zu einer mächtigen Waffe gegen Desinformation. Anstatt passiv alles zu wiederholen, was im Internet steht, arbeitet sie aktiv daran, sicherzustellen, dass nur glaubwürdige, validierte Informationen geliefert werden.

Vertrauenswürdige redaktionelle Ökosysteme

Selbst die intelligenteste KI ist nur so gut wie ihre Informationsquellen. Hier kommen vertrauenswürdige redaktionelle Ökosysteme ins Spiel. Die KI arbeitet innerhalb einer kuratierten, von Journalisten verwalteten Wissensbasis aus verifiziertem Inhalt renommierter Nachrichtenorganisationen und Fachexperten. Dies bringt mehrere entscheidende Vorteile:

- Genauigkeit – Inhalte werden von professionellen Journalisten geprüft, bevor sie in den Datensatz aufgenommen werden.

- Transparenz – Jede Antwort ist mit ihrer ursprünglichen Quelle verknüpft, was Benutzern eine klare Möglichkeit zur Überprüfung gibt.

- Unabhängigkeit – Redaktionelle Governance verhindert, dass einzelne Interessengruppen den Datensatz manipulieren können.

- Sicherheit – Ausschluss unbestätigter Quellen reduziert das Risiko von KI-»Halluzinationen« erheblich.

Ein reales Beispiel ist ChatEurope – entwickelt von einem Konsortium großer europäischer Medienorganisationen [1]. Anstatt das Internet zu durchforsten, greift er ausschließlich auf verifizierte Nachrichtenarchive seiner Partner zurück und liefert mehrsprachige Antworten mit direkten Zitaten.

Mehrsprachiger Zugang als Resilienzwerkzeug

Sprachbarrieren sind ein mächtiger Faktor für Desinformationsverbreitung. Falsche Narrative können in einer Sprache Wurzeln schlagen und Tage oder sogar Wochen lang frei zirkulieren, bevor glaubwürdige Gegen-Narrative übersetzt werden und dasselbe Publikum erreichen. Vertrauenswürdige redaktionelle Ökosysteme, die von agentenbasierter KI unterstützt werden, können diesen Kreislauf durchbrechen. Sie liefern dieselben verifizierten Informationen gleichzeitig in mehreren Sprachen und verkürzen die Zeitspanne für böswillige Akteure erheblich. Hochwertige mehrsprachige Übersetzung bewahrt kulturelle und kontextuelle Nuancen, die oft in maschinell erzeugten Übersetzungen verloren gehen, und stellt sicher, dass Bedeutung und Absicht des ursprünglichen Berichts erhalten bleiben. Dieser Ansatz erweitert auch die Reichweite für traditionell unterversorgte Gruppen, sei es aufgrund von Geografie, begrenztem Zugang zu lokaler Berichterstattung oder geringerer digitaler Infrastruktur.

Gesprächstiefe und Anpassungsfähigkeit

Im Gegensatz zu statischen Faktenprüfungsseiten können agentenbasierte KI-Systeme mehrschichtige Gespräche mit Nutzern führen. Sie passen sich dem Fluss einer Diskussion an, stellen klärende Fragen und bauen auf vorherigen Austauschen auf, um die Genauigkeit der gelieferten Informationen zu verfeinern. Zum Beispiel könnte ein Nutzer mit der Frage beginnen: »Was ist die aktuelle Haltung der EU zu Agrarsubventionen?« Die KI antwortet mit einer quellenbasierten, prägnanten Antwort und liefert die verwendeten Quellen. Der anhaltende Kontext ermöglicht es, mehrschichtige Fehlinformationen zu widerlegen, ohne den Nutzer zurück zu einer Suchleiste zu zwingen.

Menschliche Kontrolle bleibt unerlässlich

Trotz ihrer Geschwindigkeit und Skalierbarkeit kann agentenbasierte KI nicht isoliert arbeiten. Redaktionelle Aufsicht durch Menschen bleibt die entscheidende Sicherheitsmaßnahme für Genauigkeit, Ausgewogenheit und Kontext. Redakteure überprüfen sensible oder umstrittene Themen, bevor sie in den Datensatz aufgenommen werden. Sie bringen menschliches Urteilsvermögen mit, das notwendig ist, um schnell sich entwickelnde Geschichten zu korrigieren oder einzuordnen, und stellen sicher, dass die Berichterstattung eine ausgewogene Perspektive über Regionen und Gemeinschaften hinweg widerspiegelt. Dieser Ansatz verwandelt KI in einen Verstärker journalistischer Strenge, anstatt sie zu ersetzen – er verbindet rechnerische Präzision mit redaktioneller Einsicht.

Zusammenarbeit als Schlüssel

Die widerstandsfähigsten redaktionellen Ökosysteme der Zukunft basieren auf umfassender Zusammenarbeit: Medienorganisationen liefern geprüfte Inhalte, Technologiepartner schaffen sichere und intelligente Liefersysteme, Entwickler und Forscher etablieren offene Standards und transparente Methoden, und öffentliche Institutionen stellen Finanzierung und rechtliche Rahmenbedingungen bereit. Diese Zusammenarbeit schafft nicht nur die technischen Möglichkeiten, um Falschinformationen wirksam zu bekämpfen, sondern auch die gesellschaftliche Glaubwürdigkeit, die uns dazu bringt, diesen Plattformen zu vertrauen und sie zu nutzen.

Wir leben in einer Zeit, in der Falschinformationen sich in Sekunden weltweit ausbreiten können. Die Kombination aus agentenbasierter KI und kuratierter redaktioneller Governance bietet einen der klarsten Wege zur Wiederherstellung der Integrität öffentlicher Informationen. Die Zukunft im Kampf gegen Fehlinformationen wird nicht allein durch Technologie oder allein durch guten Journalismus gewonnen. Der Schlüssel ist eine intelligente Fusion beider Systeme – basierend auf Vertrauen, Transparenz und Unabhängigkeit, so agil, mehrsprachig und skalierbar wie die Bedrohungen, gegen die sie entwickelt wurden.

Martin Kraft, Managing Director Operations EMEA & APAC,

Martin Kraft, Managing Director Operations EMEA & APAC,

[1] Website: https://chateurope.eu/de/

ChatEurope

ChatEurope ist eine neue, europaweite Nachrichtenplattform, die im Juli 2025 gestartet wurde. Sie kombiniert künstliche Intelligenz mit den Inhalten führender europäischer Nachrichtenagenturen und Medienhäuser, um Bürgerinnen und Bürgern faktenbasierte Antworten auf Fragen zu europäischen Themen zu geben.

Kernelemente von ChatEurope

- Initiatoren: Ein Konsortium von 15 Medienorganisationen, darunter dpa (Deutschland), Deutsche Welle, AFP (Frankreich), ANSA (Italien), El País (Spanien), Agora (Polen) und weitere Partner aus Rumänien und Frankreich.

- Technologie: Der Chatbot basiert auf einem Sprachmodell des französischen KI-Unternehmens Mistral und wurde von der rumänischen Firma DRUID AI entwickelt.

- Ziel:

- Transparenz über EU-Entscheidungen schaffen

- Bürger besser informieren

- Desinformation und Fake News entgegenwirken

- Sprachen: Die Plattform ist in sieben europäischen Sprachen verfügbar (u. a. Deutsch, Englisch, Französisch, Spanisch, Italienisch, Polnisch, Rumänisch).

- Förderung: Das Projekt wird von der EU-Kommission unterstützt.

Nutzung und Wirkung

- Bereits in den ersten Monaten wurden tausende Fragen von Bürgerinnen und Bürgern beantwortet.

- Besonders gefragt sind Themen wie:

- Digitale Agenda der EU (AI Act, Digital Services Act, Digital Markets Act)

- Krieg in der Ukraine

- Regionale Nachrichten und Auswirkungen europäischer Politik.

Kurz gesagt: ChatEurope ist der erste europäische Nachrichten-Chatbot, der geprüfte Informationen aus seriösen Quellen bündelt, um die demokratische Meinungsbildung zu stärken.

Hier eine kritische Einordnung von ChatEurope mit Chancen und Grenzen:

Chancen von ChatEurope

- Stärkung der Informationsqualität: Bürger erhalten geprüfte, faktenbasierte Antworten aus seriösen Quellen (dpa, AFP, ANSA, El País etc.). Das ist ein Gegengewicht zu Social-Media-Desinformation.

- Europäische Perspektive: Statt national fragmentierter Berichterstattung bündelt ChatEurope Inhalte aus mehreren Ländern und Sprachen – ein Schritt zu einer gemeinsamen europäischen Öffentlichkeit.

- Niedrige Zugangshürden: Durch den Chatbot-Ansatz können auch Menschen erreicht werden, die klassische Nachrichtenportale nicht regelmäßig nutzen.

- Transparenz über EU-Politik: Gerade bei komplexen Themen wie AI Act, Digital Markets Act oder Energiepolitik kann ChatEurope Bürgern verständliche Erklärungen liefern.

Risiken und Grenzen

- Abhängigkeit von wenigen Medienhäusern: Die Inhalte stammen von einem Konsortium. Das sichert zwar Qualität, kann aber auch zu einer eingeschränkten Themenvielfalt führen.

- Technologische Limitierungen: Sprachmodelle (hier von Mistral) sind nur so gut wie ihre Trainings- und Prompt-Architektur. Verzerrungen oder Fehlinterpretationen sind möglich.

- Vertrauensfrage: Bürger, die ohnehin skeptisch gegenüber »Mainstream-Medien« sind, könnten ChatEurope als »EU-Propaganda« abtun.

- Skalierung & Aktualität: Ob die Plattform mit der Geschwindigkeit von Social Media mithalten kann, bleibt offen. Gerade bei Krisen (z. B. Ukraine-Krieg, Energiepreise) ist Aktualität entscheidend.

- Governance: Wer entscheidet, welche Fragen wie beantwortet werden? Transparenz über redaktionelle Leitlinien ist hier zentral.

Strategische Implikationen

- Für die EU: ChatEurope kann ein demokratiepolitisches Instrument sein, um Vertrauen in Institutionen zu stärken – wenn es transparent und pluralistisch bleibt.

- Für Medienhäuser: Es ist ein Experiment, wie man KI nutzen kann, um Reichweite und Relevanz zu sichern.

- Für Bürger: Es bietet eine niedrigschwellige Möglichkeit, sich zu informieren – ersetzt aber nicht die kritische Auseinandersetzung mit unterschiedlichen Quellen.

Genki Absmeier

768 Artikel zu „Fake News“

News | IT-Security | Kommunikation | Tipps

Fake News: Was Beeinflussungsoperationen bewirken und wie man sich schützen kann

Beeinflussung durch falsche Fakten, Memes und Videos ist in den sozialen Medien inzwischen an der Tagesordnung. Mit Falschnachrichten steuern die Akteure politische Themen und Entscheidungen und stiften Angst und Misstrauen. Dabei nehmen sie Organisationen ebenso ins Visier wie Einzelpersonen. Unternehmen und Behörden können sich schützen, indem sie ein Bewusstsein für Beeinflussung entwickeln und proaktiv handeln.…

News | Trends 2024 | Trends Kommunikation | Digitalisierung | Favoriten der Redaktion | Kommunikation

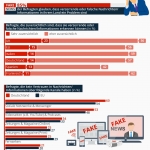

Leichtes Spiel: 80 Prozent der Deutschen nehmen Fake News einfach hin und hinterfragen sie nicht

Ein kritischer Umgang mit Internetquellen ist unabdingbar, um Fake News zu erkennen. Trotzdem prüft ein Großteil der Internetnutzer den Wahrheitsgehalt von Informationen nicht. Das trifft besonders auf Deutschland zu, das im europäischen Vergleich im hinteren Drittel landet. Mehr Digitalkompetenz ist nötig, um diesen Zustand zu verbessern. Warum zivilgesellschaftliches und unternehmerisches Engagement dabei so entscheidend sind,…

News | Trends 2024 | Trends Security | IT-Security | Tipps

50 % der Europäer wissen nicht, wie sie Fake News erkennen können

Die Besorgnis der Europäer darüber, wie ihre persönlichen Daten in sozialen Netzwerken verwendet werden, spiegelt sich in den Ergebnissen der von Panda Security durchgeführten Umfrage wider. Die von IO Research durchgeführte Studie behandelt 5 verschiedene Cybersicherheitsthemen und befragte mehr als 4.000 Personen in Deutschland, Frankreich, Italien und Spanien. Die Europäer sind besorgt darüber, wie ihre…

News | Trends Kommunikation | Digitalisierung | Trends 2018 | Trends 2017 | Kommunikation | Services

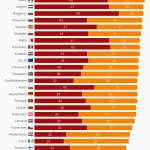

Medien: Wo Fake News als Problem gesehen werden

Laut einer aktuellen Eurobarometer-Umfrage im Auftrag der Europäischen Kommission [1] sagen durchschnittlich mehr als acht von zehn EU-Bürgern, dass Fake News oder Informationen, die Fakten falsch darstellen/verdrehen ein Problem in ihrem Land sind. Wie die Grafik zeigt sind es mit 70 Prozent in Belgien die wenigsten. Auch in Luxemburg und Dänemark werden Fake News weniger…

News | Business | Digitalisierung | IT-Security | Kommunikation | Lösungen | Services | Strategien | Tipps

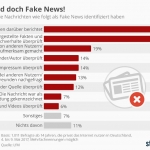

Falschmeldungen: Fake News erkennen und bekämpfen

59 Prozent der Deutschen sind schon mal mit so genannten Fake News konfrontiert worden. Wie man dieser falschen Meldungen Herr werden kann, wird heiß diskutiert. Eine Umfrage der Landesanstalt für Medien NRW zeigt nun, wie die Nutzer bisher mit der Identifizierung von falschen Nachrichten umgehen. So erfahren die meisten (48 Prozent) aus anderen Medien, dass…

News | Trends Kommunikation | Digitalisierung | Trends 2018 | IT-Security | Kommunikation | Strategien

Fake News, ein europaweites Problem

85 Prozent der für eine aktuelle Erhebung befragten EU-Bürger glauben, dass verzerrende oder falsche Nachrichten in ihrem Land ein Problem sind. Für die Studie wurden im Auftrag der Europäischen Kommission 26.576 Menschen (ab 15 Jahren) in der gesamten Europäischen Union befragt. Aber können die Europäer auch zwischen echten und falschen Informationen unterscheiden. Nur 14 Prozent…

Trends 2025 | News | Trends Security | Trends Kommunikation | IT-Security | Kommunikation | Tipps

KI-Betrug mit Deepfakes um 500 % gestiegen

KI-Betrug mit Deepfakes hat 2025 um 500 % zugenommen. Das geht aus dem neuesten Bericht der Forex-Broker-Experten von BrokerChooser hervor [1]. Die Experten analysierten Betrugsprotokolle, um zu berechnen, wie oft das Abbild verschiedener Prominenter verwendet wurde, um gefälschte Nachrichten über Deepfakes und andere KI-Medien zu erstellen. Sie sammelten auch Daten über den Anstieg von Vorfällen…

Trends 2025 | News | Trends Kommunikation | Favoriten der Redaktion | IT-Security | Tipps

Wahlbezogene Deepfakes erreichten 3,8 Milliarden Menschen – X als Hauptkanal

Die neueste Analyse von Surfshark zeigt, dass seit 2021 in 38 Ländern wahlbezogene Deepfake-Vorfälle aufgetreten sind, die die Hälfte der Weltbevölkerung — 3,8 Milliarden Menschen — betreffen [1]. Politisch motivierte Deepfakes haben Wahlen in den größten Volkswirtschaften und Demokratien der Welt infiltriert, darunter die USA, Brasilien, das Vereinigte Königreich, Deutschland und Südkorea. Unter den…

News | IT-Security | Tipps

Finanzielle Verluste durch Deepfake-Betrug

Der Bericht von Surfshark zeigt, dass es in der ersten Hälfte des Jahres 2025 fast viermal so viele Deepfake-Vorfälle gab (insgesamt 580) wie im gesamten Jahr 2024 – und dass allein in diesem Zeitraum Verluste von 410 Millionen US-Dollar durch Deepfake-Betrug entstanden sind. Insgesamt belaufen sich die Verluste durch betrügerisch eingesetzte Deepfake-Technologie seit 2019 auf…

News | Business | Künstliche Intelligenz | Tipps

Vorsicht Fake – Wie KI-Bilder und Datenklau ehrliche Bewerbungen gefährden

Was Bewerbende über KI-Fakes, Identitätsdiebstahl und Job-Scams wissen sollten – und wie sie sich schützen können. Täuschend echte Bewerbungsfotos, KI-generierte Lebensläufe und gefälschte Video-Interviews – was vor wenigen Jahren noch nach Science-Fiction klang, ist heute Realität. Laut einem aktuellen Gartner-Bericht könnte bis 2028 jede vierte Bewerbung gefälscht sein. Besonders bei Remote-Jobs wird es für Unternehmen…

News | IT-Security | Tipps

Finanzieller Schaden durch Vatertagsgrüße – Vorsicht vor Fake-WhatsApp und Fake-SMS

Am 29. Mai ist Vatertag – für viele Kinder einen willkommenen Anlass, ihrem Vater eine kleine Freude zu machen. Ob mit einem humorvollen Spruch, einem Bild aus der Kindheit oder einer persönlichen WhatsApp-Nachricht – die Botschaft zählt: »Ich denk an dich, Papa!« Wenn Väter an diesem Tag auf ihr Handy blicken, sind solche Nachrichten oft ein…

News | Trends Security | IT-Security | Tipps

Fake-Ads für Kryptowährungen: Cristiano-Ronaldo-Malvertising für Binance

Aktuelle Kampagnen mit Fake-Ads für Kryptowährungen. Fortschrittliche Tarntechniken im Einsatz. Die Experten der Bitdefender Labs beobachten aktuelle Malvertising-Kampagnen auf Facebook. Vehikel für die Angriffe mit Malware sind vor allem bekannte Kryptowährungsseiten wie Binance, Trading View, ByBit, SolFlare, MetaMask, Gate.io oder MEXC. Angebliche Markenbotschafter sind Influencer und Prominente wie Elon Musk oder Cristiano Ronaldo. Die…

Trends 2025 | News | Trends Security | IT-Security | Kommunikation

Deepfakes haben 2025 Hochkonjunktur – sind berühmte Menschen die einzigen Ziele?

Deepfake-Vorfälle entwickeln sich in einem alarmierenden Tempo: Im ersten Quartal 2025 wurden 179 Vorfälle gemeldet – ein Anstieg um 19 % gegenüber 2024, wie eine Analyse von Surfshark zeigt [1]. Zu den bemerkenswerten Fakes gehören Taylor Swift in kompromittierenden Situationen, Trump, der die Kleidung von Zelenskyy kritisiert, und Elon Musk, der China-freundliche Ansichten vertritt. Allein…

News | Trends 2024 | Trends Security | IT-Security

Betrugsversuche mit Deepfakes nehmen in den letzten drei Jahren um 2137 % zu

Weiterentwickelnde KI-basierte Technologien stellen neue Sicherheitsherausforderungen dar. Finanzinstitute sehen sich mit einer deutlichen Zunahme von Deepfake-Betrugsversuchen konfrontiert, die in den letzten drei Jahren um 2137 % zugenommen haben, so die Daten aus dem Signicat-Bericht »The Battle Against AI-Driven Identity Fraud« [1]. Da Deepfakes sich sehr schnell weiterentwickeln, müssen Unternehmen aller Branchen ihre Sicherheitsstrategien überdenken,…

News | IT-Security | Tipps

Fake-Jobangebote für Software-Entwickler auf Linkedin

Aktive Kampagne mit Verbindungen zur nordkoreanischen Lazarus-Gruppe (APT 38). Infostealer für Krypto-Wallets als Payload einer vermeintlichen Projekt-Demo. Die Bitdefender Labs beobachten eine aktive Kampagne mit gefälschten Jobangeboten auf Linkedin. Im Rahmen des Bewerbungsverfahrens erhalten die Angreifer über einen Link bösartigen Code für eine Backdoor, einen Infostealer, einen Keylogger und einen Kryptominer. Linkedin ist nicht nur…

Trends 2025 | News | Trends Security | IT-Security | Künstliche Intelligenz

KI, Deepfakes und Quantenkryptografie: Die Cybersicherheit steht 2025 auf dem Prüfstand

Die Bedrohungen im Cyberraum entwickeln sich schneller, als viele Unternehmen reagieren können: Sie stehen einer Vielzahl neuer Herausforderungen gegenüber – von KI-unterstützten Angriffen bis hin zu Deepfake-Technologien. Andreas Müller, Vice President Enterprise Sales Central and Eastern Europe bei Delinea, beleuchtet die wichtigsten Cybersicherheitstrends und -herausforderungen für das Jahr 2025. Cybersicherheit der Zukunft: Frühe Erkennung erweitert…

News | E-Commerce | IT-Security | Tipps

Weihnachtswunder oder Schnäppchenfalle? 8 Tipps, um Fake Shops zu entlarven

Etwa 90 % der Konsumentinnen und Konsumenten treffen Vorsorge gegen Shopping-Betrug. Trotzdem sind bereits rund 30 % der Befragten auf Fake Shops reingefallen. So kurz vor Weihnachten bemerkt man oft, dass auf der Geschenkeliste noch etwas fehlt – ob es eine Kleinigkeit für die Schwägerin oder ein Wichtelgeschenk fürs Büro ist. Doch wer hat…

News | IT-Security | Strategien | Tipps

Deepfake-Angriffe: Wachsende Bedrohung in der digitalen Welt

Wie hoch ist das Gefahrenpotenzial KI-gestützter Angriffe auf Unternehmen und welche Abwehrmaßnahmen gibt es? Technologien auf Basis künstlicher Intelligenz (KI) machen in jüngerer Zeit rasante Fortschritte. Im Zuge dessen gewinnt eine besondere Form der digitalen Täuschung zunehmend an Bedeutung: Deepfakes. Diese hochrealistischen, synthetischen Nachahmungen, die mithilfe von KI erstellt werden, bereiten Unternehmen und öffentlichen…

News | Business | Favoriten der Redaktion | IT-Security | Kommunikation | Tipps

Demokratien gegen Desinformation und Fakes besser schützen

Ein Bürgerrat »Forum gegen Fakes« hat seine Empfehlungen mit 28 konkreten Maßnahmen an Politik, Medien, Bildungseinrichtungen, Wirtschaft und Zivilgesellschaft zum Umgang mit Desinformation an Bundesinnenministerin Nancy Faeser übergeben. Rund 424.000 Teilnehmende waren beteiligt. Demokratien geraten durch Desinformation immer stärker unter Druck. Um gegen diese Entwicklung anzutreten, hat die Bertelsmann Stiftung das Projekt »Forum gegen Fakes…

News | IT-Security | Künstliche Intelligenz | Tipps

KI hilft Betrügern: Deep-Fake-Videos zu Dieter Bohlens Ostheoarthritis

Urheber von Gesundheitsspam nutzen KI-Technologien für Social-Media-Kampagnen. Die Bitdefender Labs beobachten weltweite Kampagnen mit KI-generierten Deepfake-Videos und -Audios auf den Social-Media-Plattformen Facebook, Messenger und Instagram. Unter den angeblichen Fürsprechern für Behandlungsmethoden etwa rund um das Thema Knie und Gelenke befinden sich Prominente wie Dieter Bohlen, der bekannte Arzt Dr. Heinz Lüscher, Christiano Ronaldo, Brad Pitt,…

News | Künstliche Intelligenz

Täuschend echte Deepfakes: 45 Prozent der Deutschen fürchten, gefälschte Videos nicht (mehr) erkennen zu können

Mehrheit (58,1 Prozent) fordert Kennzeichnungspflicht von manipulierten Inhalten. 71,5 Prozent sehen in Deepfakes eine Gefahr für die Glaubwürdigkeit der Medien. Aber: Künstliche Intelligenz weckt als Zukunftstechnologie auch viele Hoffnungen. Ein kurzes Tippen auf das Smartphone – und schon lächelt das eigene Gesicht von Supermans Körper oder aus dem neuen Beyoncé-Musikvideo. Möglich machen dies sogenannte…

News | IT-Security | Tipps

Ob simple E-Mail oder Deep-Fake: Doxing gegen Unternehmen

Kaspersky warnt vor einer neuen Cybergefahr für Unternehmen: Beim »Corporate Doxing« werden Methoden des bislang eher aus dem privaten Bereich bekannten Doxing im Kontext gezielter Angriffe genutzt. Derzeit beobachten die Experten besonders viele Attacken mit Hilfe gefälschter, geschäftlicher E-Mails (Business E-Mail Compromise, BEC). Gleichzeitig werden die Tricks zur Vortäuschung falscher Identitäten (Identitätsdiebstahl) immer ausgefeilter. So…

News | IT-Security | Tipps

Scareware: Panik-Mache mit Fake-Alerts

Der ein oder andere Internetnutzer hat es bestimmt schon einmal erlebt: Während des Surfens öffnen sich plötzlich Pop-up-Fenster oder Meldungen, die für Systemmeldungen gehalten werden. Doch Vorsicht: Bei genauerem Hinsehen entpuppen diese sich als Meldungen, die über die aufgerufene Website abgegeben werden. »Bei solchen Meldungen handelt es sich möglicherweise um Scareware – eine Form der…

News | E-Commerce | Tipps

Wie erkennen Verbraucher einen Fake-Shop?

Das Online-Geschäft boomt. Laut dem E-Commerce Verband bevh, gaben Verbraucher im Zeitraum April bis Juni 20.222 Millionen Euro im Online-Handel aus – und die Tendenz steigt weiter. Dabei nimmt aber auch der Betrug über sogenannte Fake-Shops zu, selbst auf Seiten wie Amazon oder eBay. Die Online-Experten der SEO-Küche geben Tipps, wie Nutzer unseriöse Anbieter…

News | IT-Security | Kommunikation

Deep-Fake-Texte – Mögliche Manipulationen der US-Wahl durch kriminelle Nutzung von künstlicher Intelligenz

Vor dem Hintergrund der nahenden US-Präsidentschaftswahlen könnten die jüngsten Fortschritte in der KI das Potenzial haben, die Wähler zu beeinflussen – durch die Verwendung von KI-generiertem Text, der praktisch unmöglich von menschlich generiertem Text zu unterscheiden ist. Christopher Thissen, KI-Experte bei Vectra AI, analysiert die aktuellen Möglichkeiten und Gefahren durch Deep-Fake-Texte. Die untersuchte, neue…