foto freepik

Dr. Vera Schmitt arbeitet an der größten deutschsprachigen KI-Plattform zur Desinformationserkennung. Im Interview gibt sie Antworten zu aktuellen Herausforderungen.

Desinformationskampagnen, die den gesellschaftlichen Zusammenhalt bedrohen, nehmen weltweit rasant zu. Doch wie kann die Gesellschaft auf diese Herausforderung reagieren? Dr. Vera Schmitt und ihre Forschungsgruppe XplaiNLP am Quality and Usability Lab der TU Berlin haben darauf eine klare Antwort: Künstliche Intelligenz (KI). Mit innovativen Projekten wie VeraXtract und news-polygraph arbeiten sie an der größten deutschsprachigen KI-Plattform zur Desinformationserkennung. Um die Gruppe aufzubauen, hat Dr. Schmitt über 4 Millionen Euro Drittmittel eingeworben.

»Unser Ziel ist es, die gesellschaftliche Widerstandsfähigkeit gegenüber Desinformation zu stärken«, erklärt Dr. Schmitt im ausführlichen Interview [1]. Die promovierte Computerwissenschaftlerin entwickelt mit ihrer Forschungsgruppe Systeme zur intelligenten Entscheidungsunterstützung, um Desinformationsnarrative aufzudecken, Fakten transparent zu machen und langfristig den Zusammenhalt in der Gesellschaft zu fördern.

Kampf gegen Desinformationsnarrative

Das neuste Projekt VeraXtract, zielt auf die Analyse und Erkennung komplexer Desinformationsnarrative ab. »Wir wollen nicht nur einzelne Falschmeldungen identifizieren, sondern zugrundeliegende Narrative entschlüsseln – von Verschwörungstheorien bis hin zu politisch gesteuerten Kampagnen », sagt Dr. Schmitt. Mit einem KI-gestützten »Narrative Monitoring Tool« sollen Journalist*innen und die Öffentlichkeit künftig besser verstehen können, wie solche Narrative funktionieren und sich verbreiten. Das Tool liefert nachvollziehbare Erklärungen für seine Entscheidungen, um die Transparenz und Vertrauenswürdigkeit der Ergebnisse zu gewährleisten.

Das zweite große Projekt, news-polygraph, richtet sich speziell an Journalistinnen und Journalisten. Ziel ist die Entwicklung einer multimodalen Plattform, die Desinformationen in Texten, Bildern, Audio- und Videoinhalten analysiert. »Die erste Demoversion planen wir im April – dann können Journalisten sie testen«, kündigt Dr. Schmitt an. Doch die Herausforderungen sind groß: »Faktenchecks erfolgen eigentlich immer zu spät. Desinformationen bleiben selbst nach ihrer Widerlegung im Bewusstsein«, betont die Wissenschaftlerin. Ihre Vision: KI-Tools, die Desinformationen in Echtzeit erkennen und präventiv im ganzen Internet eingreifen.

KI als Brücke zwischen Menschen

Dr. Schmitt ist überzeugt, dass KI nicht nur Risiken birgt, sondern auch helfen kann, Brücken zwischen Menschen zu bauen: »Algorithmen könnten so umgestaltet werden, dass sie nicht nur unsere bisherigen Likes und Präferenzen verstärken, sondern auch gezielt Inhalte präsentieren, die eine größere Vielfalt an Meinungen, Kulturen oder Sichtweisen abbilden. Das könnte helfen, die bekannten Filterblasen zu durchbrechen und uns ein ausgewogeneres Bild der Welt zu zeigen.«

[1] Erfahren Sie im Interview mehr darüber, wie KI den Zusammenhalt in der Gesellschaft unterstützen kann und wie junge Menschen vor Desinformationen geschützt werden können. https://www.tu.berlin/news/interviews/forschungsgruppe-xplainlp

Über die Forschungsgruppe XplaiNLP:

Dr. Vera Schmitt leitet die Forschungsgruppe XplaiNLP an der TU Berlin. Mit über vier Millionen Euro an Drittmitteln und 24 Teammitgliedern zählt die Forschungsgruppe XplaiNLP zu den führenden Gruppen im Bereich der Desinformationserkennung und erklärbarer KI in Deutschland.

646 Artikel zu „Fake“

News | IT-Security | Tipps

Fake-Jobangebote für Software-Entwickler auf Linkedin

Aktive Kampagne mit Verbindungen zur nordkoreanischen Lazarus-Gruppe (APT 38). Infostealer für Krypto-Wallets als Payload einer vermeintlichen Projekt-Demo. Die Bitdefender Labs beobachten eine aktive Kampagne mit gefälschten Jobangeboten auf Linkedin. Im Rahmen des Bewerbungsverfahrens erhalten die Angreifer über einen Link bösartigen Code für eine Backdoor, einen Infostealer, einen Keylogger und einen Kryptominer. Linkedin ist nicht nur…

News | Trends 2025 | Trends Security | IT-Security | Künstliche Intelligenz

KI, Deepfakes und Quantenkryptografie: Die Cybersicherheit steht 2025 auf dem Prüfstand

Die Bedrohungen im Cyberraum entwickeln sich schneller, als viele Unternehmen reagieren können: Sie stehen einer Vielzahl neuer Herausforderungen gegenüber – von KI-unterstützten Angriffen bis hin zu Deepfake-Technologien. Andreas Müller, Vice President Enterprise Sales Central and Eastern Europe bei Delinea, beleuchtet die wichtigsten Cybersicherheitstrends und -herausforderungen für das Jahr 2025. Cybersicherheit der Zukunft: Frühe Erkennung erweitert…

News | E-Commerce | IT-Security | Tipps

Weihnachtswunder oder Schnäppchenfalle? 8 Tipps, um Fake Shops zu entlarven

Etwa 90 % der Konsumentinnen und Konsumenten treffen Vorsorge gegen Shopping-Betrug. Trotzdem sind bereits rund 30 % der Befragten auf Fake Shops reingefallen. So kurz vor Weihnachten bemerkt man oft, dass auf der Geschenkeliste noch etwas fehlt – ob es eine Kleinigkeit für die Schwägerin oder ein Wichtelgeschenk fürs Büro ist. Doch wer hat…

News | IT-Security | Strategien | Tipps

Deepfake-Angriffe: Wachsende Bedrohung in der digitalen Welt

Wie hoch ist das Gefahrenpotenzial KI-gestützter Angriffe auf Unternehmen und welche Abwehrmaßnahmen gibt es? Technologien auf Basis künstlicher Intelligenz (KI) machen in jüngerer Zeit rasante Fortschritte. Im Zuge dessen gewinnt eine besondere Form der digitalen Täuschung zunehmend an Bedeutung: Deepfakes. Diese hochrealistischen, synthetischen Nachahmungen, die mithilfe von KI erstellt werden, bereiten Unternehmen und öffentlichen…

News | IT-Security | Kommunikation | Tipps

Fake News: Was Beeinflussungsoperationen bewirken und wie man sich schützen kann

Beeinflussung durch falsche Fakten, Memes und Videos ist in den sozialen Medien inzwischen an der Tagesordnung. Mit Falschnachrichten steuern die Akteure politische Themen und Entscheidungen und stiften Angst und Misstrauen. Dabei nehmen sie Organisationen ebenso ins Visier wie Einzelpersonen. Unternehmen und Behörden können sich schützen, indem sie ein Bewusstsein für Beeinflussung entwickeln und proaktiv handeln.…

News | Business | Favoriten der Redaktion | IT-Security | Kommunikation | Tipps

Demokratien gegen Desinformation und Fakes besser schützen

Ein Bürgerrat »Forum gegen Fakes« hat seine Empfehlungen mit 28 konkreten Maßnahmen an Politik, Medien, Bildungseinrichtungen, Wirtschaft und Zivilgesellschaft zum Umgang mit Desinformation an Bundesinnenministerin Nancy Faeser übergeben. Rund 424.000 Teilnehmende waren beteiligt. Demokratien geraten durch Desinformation immer stärker unter Druck. Um gegen diese Entwicklung anzutreten, hat die Bertelsmann Stiftung das Projekt »Forum gegen Fakes…

News | Trends 2024 | Trends Kommunikation | Digitalisierung | Favoriten der Redaktion | Kommunikation

Leichtes Spiel: 80 Prozent der Deutschen nehmen Fake News einfach hin und hinterfragen sie nicht

Ein kritischer Umgang mit Internetquellen ist unabdingbar, um Fake News zu erkennen. Trotzdem prüft ein Großteil der Internetnutzer den Wahrheitsgehalt von Informationen nicht. Das trifft besonders auf Deutschland zu, das im europäischen Vergleich im hinteren Drittel landet. Mehr Digitalkompetenz ist nötig, um diesen Zustand zu verbessern. Warum zivilgesellschaftliches und unternehmerisches Engagement dabei so entscheidend sind,…

News | IT-Security | Künstliche Intelligenz | Tipps

KI hilft Betrügern: Deep-Fake-Videos zu Dieter Bohlens Ostheoarthritis

Urheber von Gesundheitsspam nutzen KI-Technologien für Social-Media-Kampagnen. Die Bitdefender Labs beobachten weltweite Kampagnen mit KI-generierten Deepfake-Videos und -Audios auf den Social-Media-Plattformen Facebook, Messenger und Instagram. Unter den angeblichen Fürsprechern für Behandlungsmethoden etwa rund um das Thema Knie und Gelenke befinden sich Prominente wie Dieter Bohlen, der bekannte Arzt Dr. Heinz Lüscher, Christiano Ronaldo, Brad Pitt,…

News | Trends 2024 | Trends Security | IT-Security | Tipps

50 % der Europäer wissen nicht, wie sie Fake News erkennen können

Die Besorgnis der Europäer darüber, wie ihre persönlichen Daten in sozialen Netzwerken verwendet werden, spiegelt sich in den Ergebnissen der von Panda Security durchgeführten Umfrage wider. Die von IO Research durchgeführte Studie behandelt 5 verschiedene Cybersicherheitsthemen und befragte mehr als 4.000 Personen in Deutschland, Frankreich, Italien und Spanien. Die Europäer sind besorgt darüber, wie ihre…

News | IT-Security | Tipps

Gefälschte E-Mails, QR-Codes und Deep Fakes erkennen

Eine weit verbreitete Angriffsmethode von Cyberkriminellen ist die Kompromittierung von (Geschäfts)-E-Mails. Dabei erhalten die Benutzer beispielsweise eine E-Mail, vermeintlich von einem Vorgesetzten, Manager oder einer anderen Autorität, mit der Bitte sensible Daten weiterzuleiten, einen Link anzuklicken oder eine Datei zu öffnen. Zwar stammt die E-Mail mitnichten vom vorgeblichen Absender – aber da sie so wirkt,…

News | Künstliche Intelligenz

Täuschend echte Deepfakes: 45 Prozent der Deutschen fürchten, gefälschte Videos nicht (mehr) erkennen zu können

Mehrheit (58,1 Prozent) fordert Kennzeichnungspflicht von manipulierten Inhalten. 71,5 Prozent sehen in Deepfakes eine Gefahr für die Glaubwürdigkeit der Medien. Aber: Künstliche Intelligenz weckt als Zukunftstechnologie auch viele Hoffnungen. Ein kurzes Tippen auf das Smartphone – und schon lächelt das eigene Gesicht von Supermans Körper oder aus dem neuen Beyoncé-Musikvideo. Möglich machen dies sogenannte…

News | IT-Security | Tipps

Ob simple E-Mail oder Deep-Fake: Doxing gegen Unternehmen

Kaspersky warnt vor einer neuen Cybergefahr für Unternehmen: Beim »Corporate Doxing« werden Methoden des bislang eher aus dem privaten Bereich bekannten Doxing im Kontext gezielter Angriffe genutzt. Derzeit beobachten die Experten besonders viele Attacken mit Hilfe gefälschter, geschäftlicher E-Mails (Business E-Mail Compromise, BEC). Gleichzeitig werden die Tricks zur Vortäuschung falscher Identitäten (Identitätsdiebstahl) immer ausgefeilter. So…

News | IT-Security | Tipps

Scareware: Panik-Mache mit Fake-Alerts

Der ein oder andere Internetnutzer hat es bestimmt schon einmal erlebt: Während des Surfens öffnen sich plötzlich Pop-up-Fenster oder Meldungen, die für Systemmeldungen gehalten werden. Doch Vorsicht: Bei genauerem Hinsehen entpuppen diese sich als Meldungen, die über die aufgerufene Website abgegeben werden. »Bei solchen Meldungen handelt es sich möglicherweise um Scareware – eine Form der…

News | E-Commerce | Tipps

Wie erkennen Verbraucher einen Fake-Shop?

Das Online-Geschäft boomt. Laut dem E-Commerce Verband bevh, gaben Verbraucher im Zeitraum April bis Juni 20.222 Millionen Euro im Online-Handel aus – und die Tendenz steigt weiter. Dabei nimmt aber auch der Betrug über sogenannte Fake-Shops zu, selbst auf Seiten wie Amazon oder eBay. Die Online-Experten der SEO-Küche geben Tipps, wie Nutzer unseriöse Anbieter…

News | IT-Security | Kommunikation

Deep-Fake-Texte – Mögliche Manipulationen der US-Wahl durch kriminelle Nutzung von künstlicher Intelligenz

Vor dem Hintergrund der nahenden US-Präsidentschaftswahlen könnten die jüngsten Fortschritte in der KI das Potenzial haben, die Wähler zu beeinflussen – durch die Verwendung von KI-generiertem Text, der praktisch unmöglich von menschlich generiertem Text zu unterscheiden ist. Christopher Thissen, KI-Experte bei Vectra AI, analysiert die aktuellen Möglichkeiten und Gefahren durch Deep-Fake-Texte. Die untersuchte, neue…

News | E-Commerce | Trends E-Commerce | Trends 2020

Zweidrittel fordern konsequenteres Vorgehen gegen Fake Reviews

Umfrage zeigt: Die Hälfte der Verbraucher wünscht sich Bewertungen nur von verifizierten Kunden. Positive Reviews sind für 55 Prozent genauso wichtig wie negative Kundenbewertungen. Wunsch nach Strafen, wenn Unternehmen nicht gegen Fake Reviews vorgehen. Fake Reviews lösen bei jedem Dritten den Verlust von Vertrauen in eine Marke aus. Der Einzelhandel benötigt neue Standards, um…

News | Business | IT-Security | Künstliche Intelligenz

Betrug mit Deep Fake: die Schattenseite der künstlichen Intelligenz

In den letzten Jahren waren Fake-News eine große Sorge. Es wird angenommen, dass diese Falschmeldungen eine wichtige Rolle bei Wahlprozessen wie den US-Präsidentschaftswahlen 2016 und dem Referendum über den Rückzug des Vereinigten Königreichs aus der EU im selben Jahr gespielt haben. Deep Fakes sind der Einsatz künstlicher Intelligenz, um vermeintlich reale Videos und Audioaufnahmen…

News | E-Commerce | Kommentar

Was tun gegen Fake-Bewertungen im Netz?

Jede fünfte Bewertung auf Amazon.co.uk ist fake. Deutsche Zahlen gibt es noch nicht. Aus diesem Grund hat das Bundeskartellamt im Mai dieses Jahres eine Untersuchung gestartet, aus der hervorgehen soll, wie es auf deutschen Bewertungs- und Handelsplattformen um die Echtheit von Kundenmeinungen steht. Die Ergebnisse lassen noch auf sich warten. Klar ist hingegen, dass das…

News | Trends Kommunikation | Trends 2019

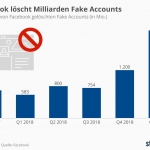

Facebook löscht Milliarden Fake Accounts

2,4 Milliarden monatlich aktive Nutzer hat Facebook im Geschäftsbericht für das erste Quartal 2019 gemeldet. Im selben Zeitraum löschte das Unternehmen 2,2 Milliarden Fake-Accounts. Das geht aus dem Community Standards Enforcement Report hervor. Und dabei erwischt Facebook längst nicht alle gegen die Regeln verstoßenden Profile, wie eine weitere Statista-Grafik zeigt. Die enormen Zahlen gehen…

News | IT-Security | Künstliche Intelligenz | Ausgabe 1-2-2019 | Security Spezial 1-2-2019

Deepfakes heben Social-Engineering-Angriffe auf eine neue Gefahrenstufe

Social-Engineering-Angriffe stellen eine hohe Gefahr für die IT-Sicherheit dar, weil sie technische Abwehrmaßnahmen umgehen. Noch problematischer wird die Bedrohungslage durch KI- und ML-basierte Deepfakes, die stark im Kommen sind. Unternehmen müssen ein Bewusstsein für diese Gefahren entwickeln und Führungskräfte wie Mitarbeiter entsprechend sensibilisieren.