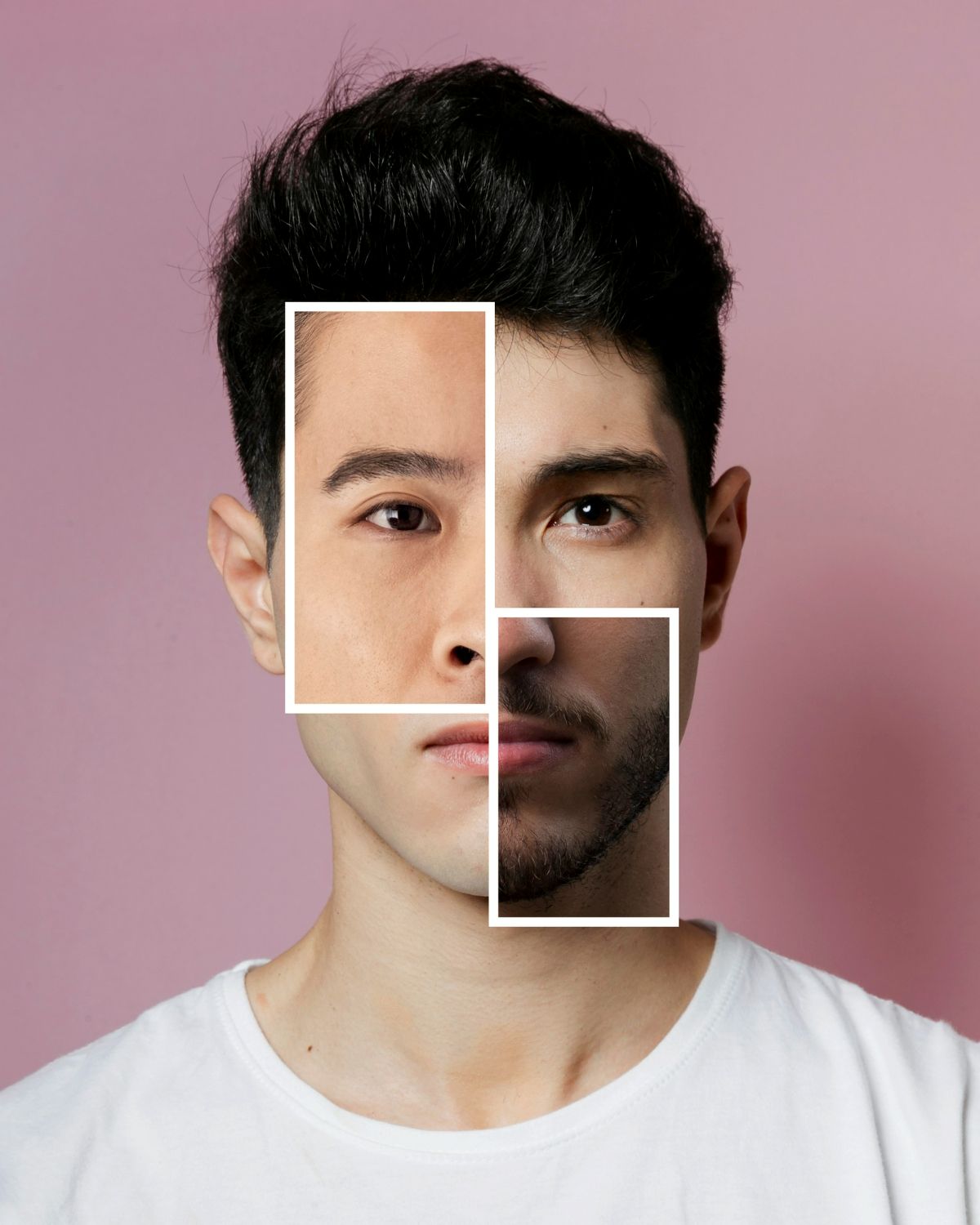

foto freepik

- Repräsentative Untersuchung der IU Internationalen Hochschule liefert Daten zu Deepfakes – 15 Prozent sind bereits darauf hereingefallen.

- Debatte um Grok und sexualisierte Deepfakes zeigt, wie schnell Manipulationen Reichweite bekommen

- Repräsentative IU-Studie liefert Daten zu Vertrauen, Nutzung und Risiken von Desinformation

Ob in Social Feeds, Messengern oder KI-gestützten Chatdiensten: Manipulierte Inhalte lassen sich heute in Minuten erzeugen und in Sekunden verbreiten. 96,3 Prozent der Menschen in Deutschland kennen Fake News – also bewusst falsche oder irreführende Informationen [1]. Doch nur 34,3 Prozent wissen, was Deepfakes sind: mit künstlicher Intelligenz erzeugte, täuschend echte Bild-, Audio- oder Videoinhalte [2]. Das zeigt die repräsentative Studie »Fakt oder Fake? Medienkompetenz in Deutschland« der IU Internationalen Hochschule, die im September 2025 veröffentlicht wurde [3].

Diese Wissenslücke ist brisant, wie zum Beispiel die aktuelle Debatte um den KI-Chatbot Grok zeigt: Gegen dessen Plattform X hat die EU-Kommission im Januar 2026 ein Verfahren nach dem Digital Services Act eingeleitet [4]. Grok ermöglicht es, in Sekunden fotorealistische Bilder zu generieren – auch sexualisierte Deepfakes ohne Einwilligung der abgebildeten Personen.

Wie anfällig die Menschen in Deutschland für Deepfakes sind, belegen weitere Zahlen der IU-Studie: Sie zeigen unter anderem, dass 33,1 Prozent der Befragten bereits Fake News geglaubt haben, die sich für sie nachträglich als falsch herausgestellt haben. Bei Deepfakes sind es 15,0 Prozent.

Zentrale Befunde und konkrete Prüfschritte gegen Fake News und Deepfakes erläutert Prof. Dr. Nele Hansen, Professorin für Medienmanagement an der IU Internationalen Hochschule, nun im begleitenden Video »Online sicher? Neue Medienkompetenz-Studie 2026«.

Weitere Ergebnisse der IU-Studie:

Jüngere kennen Deepfakes besser:

Je jünger die Generation, desto häufiger ist das Wissen über Deepfakes vorhanden. Diese Wissenslücke ist problematisch, denn die Folgen können gravierend sein: Von den 15,0 Prozent der Befragten, die bereits Deepfakes geglaubt haben, berichten 46,0 Prozent von dadurch ausgelöstem Stress oder Angst, 17,7 Prozent haben sich deswegen mit anderen gestritten.

KI verstärkt das Problem:

84,8 Prozent stimmen zudem der Aussage zu, dass durch die Nutzung von KI-basierten Suchmaschinen die Verbreitung von Fake News zukünftig weiter zunehmen wird.

Verantwortung bei Plattformen und Politik:

Gleichzeitig verorten 65,1 Prozent der Befragten die Hauptverantwortung für die Bekämpfung von Fake News und Deepfakes bei den Betreibern sozialer Plattformen, 63,1 Prozent bei der Politik.

»Ob Menschen Informationen lediglich konsumieren oder sie selbstbewusst einordnen, hängt maßgeblich von Medienkompetenz und kritischem Hinterfragen ab«, resümiert Prof. Dr. Nele Hansen, Professorin für Medienmanagement an der IU Internationalen Hochschule.

[1] Definition Fake News: Fake News sind absichtlich erfundene oder manipulierte Nachrichten, die als echte Berichterstattung erscheinen, um Menschen zu täuschen. Sie können genutzt werden, um öffentliche Meinungen zu beeinflussen, Aufmerksamkeit zu erlangen oder wirtschaftliche und politische Interessen zu verfolgen.

[2] Definition Deepfakes: Ein Deepfake ist ein mit Künstlicher Intelligenz bearbeitetes Video, Bild oder Audio, das täuschend echt aussieht bzw. sich täuschend echt anhört und Personen, Szenen oder Stimmen verfälscht.

[3] Über die Studie: Für die Studie »Fakt oder Fake? Medienkompetenz in Deutschland« wurden 1.999 Menschen in Deutschland im Alter von 16 bis 65 Jahren befragt, repräsentativ nach Alter und Geschlecht. Der Befragungszeitraum lag zwischen 14. und 25. April 2025. Als Panel diente horizoom.

https://www.iu.de/news/iu-studie-90-prozent-sehen-fake-news-als-ernsthafte-bedrohung-fuer-demokratie-und-freiheit/

[4] Beispiel-Quellen zur Thematik: https://www.faz.net/aktuell/feuilleton/medien-und-film/medienpolitik/grok-erzeugt-weiter-sexualisierte-bilder-200502477.html

und https://www.faz.net/aktuell/wirtschaft/mehr-wirtschaft/eu-ermittelt-gegen-x-wegen-sexualisierter-ki-bilder-accg-200475429.html

[5] https://www.youtube.com/watch?v=MzvKM5oAxmo

Wie kann man Deepfakes erkennen?

Deepfakes zu erkennen ist heute anspruchsvoller als noch vor wenigen Jahren, aber es gibt eine Reihe von technischen, visuellen und kontextuellen Methoden, die in Kombination sehr zuverlässig funktionieren. Hier eine strukturierte Übersicht, die sowohl für Alltagssituationen als auch für professionelle Due‑Diligence‑Analysen taugt.

Technische und visuelle Hinweise auf Deepfakes

- Unnatürliche Details im Gesicht

- Unregelmäßige Blinzelmuster (zu selten, zu häufig oder unnatürlich synchron)

- Asymmetrische Gesichtszüge, die sich zwischen Frames verändern

- Unsaubere Übergänge zwischen Gesicht und Hals

- Unnatürliche Hauttexturen oder »plastikartige« Oberflächen

- Fehler bei Zähnen und Zunge, oft unscharf oder unregelmäßig

- Probleme mit Licht und Schatten

- Lichtquellen passen nicht zur Umgebung

- Schatten bewegen sich nicht konsistent

- Reflexionen in Brillen oder Augen wirken künstlich

- Unstimmigkeiten in Bewegungen

- Kopfbewegungen wirken »abgehackt« oder schweben leicht

- Lippenbewegungen passen nicht exakt zur Sprache

- Mikroexpressionen fehlen oder wirken verzögert

- Audio‑Anomalien

- Stimme klingt zu glatt oder synthetisch

- Atmung fehlt oder ist unnatürlich

- Hintergrundgeräusche passen nicht zur Szene

- Artefakte bei schnellen Bewegungen

- Verzerrungen an den Rändern des Gesichts

- »Ghosting« oder Flimmern bei Kopfbewegungen

- Unschärfen, die nicht zur Kameratechnik passen

Kontextuelle Prüfungen (oft wichtiger als visuelle)

- Quellenvalidierung

- Stammt das Video aus einer vertrauenswürdigen Quelle

- Gibt es mehrere unabhängige Veröffentlichungen

- Ist der Account verifiziert oder neu erstellt

- Metadaten‑Analyse

- Dateiformat, Erstellungszeit, Bearbeitungsspuren

- Fehlende oder manipulierte EXIF‑Daten

- Reverse‑Image‑Search / Frame‑Search

- Einzelne Frames lassen sich oft über Suchmaschinen finden

- Deepfakes basieren häufig auf bekannten Originalvideos

- Inhaltliche Plausibilität

- Passt das Verhalten zur Person

- Passt der Kontext zur Umgebung

- Gibt es logische Brüche im Ablauf

Professionelle Tools zur Deepfake‑Erkennung

Für forensische Analysen existieren spezialisierte Werkzeuge:

- Microsoft Video Authenticator

- Reality Defender

- Hive Moderation Deepfake Detector

- Intel FakeCatcher (nutzt Blutfluss‑Signale im Gesicht)

- Deepware Scanner

Diese Tools arbeiten mit neuronalen Netzen, die typische Manipulationsmuster erkennen.

Praktische Heuristik für den Alltag

Eine einfache, aber erstaunlich effektive Regel:

Wenn ein Video emotional aufwühlt, extrem wirkt oder »zu gut passt«, ist es besonders verdächtig.

Deepfakes werden häufig genutzt, um starke Reaktionen auszulösen.

Albert Absmeier & KI

278 Artikel zu „Deepfakes „

News | Trends 2025 | Trends Security | Trends Kommunikation | IT-Security | Kommunikation | Tipps

KI-Betrug mit Deepfakes um 500 % gestiegen

KI-Betrug mit Deepfakes hat 2025 um 500 % zugenommen. Das geht aus dem neuesten Bericht der Forex-Broker-Experten von BrokerChooser hervor [1]. Die Experten analysierten Betrugsprotokolle, um zu berechnen, wie oft das Abbild verschiedener Prominenter verwendet wurde, um gefälschte Nachrichten über Deepfakes und andere KI-Medien zu erstellen. Sie sammelten auch Daten über den Anstieg von Vorfällen…

News | Trends 2025 | Trends Kommunikation | Favoriten der Redaktion | IT-Security | Tipps

Wahlbezogene Deepfakes erreichten 3,8 Milliarden Menschen – X als Hauptkanal

Die neueste Analyse von Surfshark zeigt, dass seit 2021 in 38 Ländern wahlbezogene Deepfake-Vorfälle aufgetreten sind, die die Hälfte der Weltbevölkerung — 3,8 Milliarden Menschen — betreffen [1]. Politisch motivierte Deepfakes haben Wahlen in den größten Volkswirtschaften und Demokratien der Welt infiltriert, darunter die USA, Brasilien, das Vereinigte Königreich, Deutschland und Südkorea. Unter den…

News | Trends 2025 | Trends Security | IT-Security | Kommunikation

Deepfakes haben 2025 Hochkonjunktur – sind berühmte Menschen die einzigen Ziele?

Deepfake-Vorfälle entwickeln sich in einem alarmierenden Tempo: Im ersten Quartal 2025 wurden 179 Vorfälle gemeldet – ein Anstieg um 19 % gegenüber 2024, wie eine Analyse von Surfshark zeigt [1]. Zu den bemerkenswerten Fakes gehören Taylor Swift in kompromittierenden Situationen, Trump, der die Kleidung von Zelenskyy kritisiert, und Elon Musk, der China-freundliche Ansichten vertritt. Allein…

News | Trends 2024 | Trends Security | IT-Security

Betrugsversuche mit Deepfakes nehmen in den letzten drei Jahren um 2137 % zu

Weiterentwickelnde KI-basierte Technologien stellen neue Sicherheitsherausforderungen dar. Finanzinstitute sehen sich mit einer deutlichen Zunahme von Deepfake-Betrugsversuchen konfrontiert, die in den letzten drei Jahren um 2137 % zugenommen haben, so die Daten aus dem Signicat-Bericht »The Battle Against AI-Driven Identity Fraud« [1]. Da Deepfakes sich sehr schnell weiterentwickeln, müssen Unternehmen aller Branchen ihre Sicherheitsstrategien überdenken,…

News | Trends 2025 | Trends Security | IT-Security | Künstliche Intelligenz

KI, Deepfakes und Quantenkryptografie: Die Cybersicherheit steht 2025 auf dem Prüfstand

Die Bedrohungen im Cyberraum entwickeln sich schneller, als viele Unternehmen reagieren können: Sie stehen einer Vielzahl neuer Herausforderungen gegenüber – von KI-unterstützten Angriffen bis hin zu Deepfake-Technologien. Andreas Müller, Vice President Enterprise Sales Central and Eastern Europe bei Delinea, beleuchtet die wichtigsten Cybersicherheitstrends und -herausforderungen für das Jahr 2025. Cybersicherheit der Zukunft: Frühe Erkennung erweitert…

News | Künstliche Intelligenz

Täuschend echte Deepfakes: 45 Prozent der Deutschen fürchten, gefälschte Videos nicht (mehr) erkennen zu können

Mehrheit (58,1 Prozent) fordert Kennzeichnungspflicht von manipulierten Inhalten. 71,5 Prozent sehen in Deepfakes eine Gefahr für die Glaubwürdigkeit der Medien. Aber: Künstliche Intelligenz weckt als Zukunftstechnologie auch viele Hoffnungen. Ein kurzes Tippen auf das Smartphone – und schon lächelt das eigene Gesicht von Supermans Körper oder aus dem neuen Beyoncé-Musikvideo. Möglich machen dies sogenannte…

News | IT-Security | Künstliche Intelligenz | Ausgabe 1-2-2019 | Security Spezial 1-2-2019

Deepfakes heben Social-Engineering-Angriffe auf eine neue Gefahrenstufe

Social-Engineering-Angriffe stellen eine hohe Gefahr für die IT-Sicherheit dar, weil sie technische Abwehrmaßnahmen umgehen. Noch problematischer wird die Bedrohungslage durch KI- und ML-basierte Deepfakes, die stark im Kommen sind. Unternehmen müssen ein Bewusstsein für diese Gefahren entwickeln und Führungskräfte wie Mitarbeiter entsprechend sensibilisieren.

News | IT-Security | Künstliche Intelligenz | Services | Strategien | Whitepaper

Mehr Cyberresilienz durch künstliche Intelligenz: 5-Stufenplan für Unternehmen

Olaf Pursche, Leiter Kompetenzgruppe Sicherheit eco – Verband der Internetwirtschaft e.V.: »KI ist längst fester Bestandteil von Geschäftsprozessen. Mit ihrer Verbreitung nehmen jedoch auch Bedrohungen wie Deepfakes und KI-gestütztes Phishing zu. Entscheidend ist daher die sichere und verantwortungsvolle Integration von KI als zentraler Baustein der Cyberresilienz.« eco veröffentlicht Whitepaper für Entscheidungsträgerinnen und Entscheidungsträger zu sicherer…

News | Kommunikation | Produktmeldung | Services

Schwachstelle Posteingang: Wie Unternehmen ihre E-Mail-Verwaltung verbessern

Konnect eMail stellt Lösungen vor, um Arbeitsabläufe zu optimieren, die Compliance zu gewährleiten und sich vor Ransomware-Angriffen zu schützen. E-Mails sind das Rückgrat der modernen Arbeitswelt – und zugleich ihre Achillesferse. Werden sie nicht korrekt abgelegt, kann das zum Risikofaktor werden. Mit der Integrationslösung für Outlook und SharePoint von Konnect eMail können Unternehmen ihre…

News | Trends 2026 | Trends Security | IT-Security | Künstliche Intelligenz | Whitepaper

KI-Identitäten außer Kontrolle: Massive Governance-Lücken in deutschen Unternehmen

Künstliche Intelligenz ist längst kein Zukunftsthema mehr. Sie agiert in Arbeitsumgebungen bereits heute autonom. Das ist auf der einen Seite ein Riesenvorteil, auf der anderen Seite jedoch schwierig überwachbar. Eine neue internationale Umfrage, beauftragt von Saviynt und in Deutschland, Großbritannien und den USA durchgeführt, zeigt: KI-Identitäten greifen bereits tief in kritische Systeme ein [1].…

News | IT-Security | Kommentar | Strategien | Tipps

Datenschutz: Eine Frage der Identität

Der Europäische Datenschutztag sollte nicht nur ein Tag der Datenschutzreflexe sein. Verantwortliche sollten überprüfen, wie sie einen zentralen Vektor der Angreifer beim unerlaubten Zugriff auf Informationen schützen und sichern: digitale und menschliche Identitäten. Sie zu schützen und wiederherzustellen, ist eine entscheidende Aufgabe. Denn beide sind ein Haupttool für Angreifer, um Zugriff auf Daten zu erhalten.…

News | IT-Security | Services | Strategien

Deep Observability: Transparenz schaffen und gestresste Sicherheitsteams entlasten

IT-Sicherheit hat immer auch eine menschliche Dimension: Überlastete Teams und gestresste Mitarbeiter können dazu führen, dass Unternehmen nicht rechtzeitig auf Bedrohungen reagieren. Ein besonders kritischer Stressfaktor ist dabei die in letzter Zeit wachsende Komplexität durch revolutionäre Technologien wie KI, neue Infrastrukturen etwa Hybrid Cloud und immer mehr Tools. Unternehmen müssen jetzt dafür sorgen, dass ihre…

News | Trends 2026 | Trends Security | IT-Security | Tipps

Das planen Cyberkriminelle für 2026

Auch in diesem Jahr müssen Unternehmen sprichwörtlich früh aufstehen, um Cyberkriminellen einen Schritt voraus zu sein. Experten für Managed Extended Detection and Response (MXDR) helfen ihnen dabei und nennen vier Entwicklungen, auf die sie 2026 gefasst sein müssen. Das Cyberthreat-Research-Team von Ontinue sammelt das ganze Jahr über wertvolle Informationen rund um das Thema Cybersicherheit.…

News | IT-Security | Künstliche Intelligenz | Services | Tipps

Sicherer Umgang mit persönlichen KI‑Agenten

Gefahren, Risiken und konkrete Schutzmaßnahmen von persönlichen KI-Assistenten Persönliche KI‑Agenten entwickeln sich rasant – schneller als Vertrauen, Regulierung und Nutzerbewusstsein. Behörden, Sicherheitsforscher und IT‑Experten warnen deshalb vor realen Risiken, die über klassische IT‑Sicherheitsprobleme hinausgehen. Zentrale Gefahren Datenmissbrauch & Privatsphäre KI‑Agenten verarbeiten oft hochsensible Informationen (E‑Mails, Kalender, Dokumente, Passwörter). Cloud‑basierte Agenten können Daten weiterverarbeiten, speichern oder…

News | Favoriten der Redaktion | IT-Security | Kommentar | Künstliche Intelligenz

Agentische KI skaliert schneller als Vertrauen, Verantwortung und Verbraucherbewusstsein

Da autonome KI-Agenten in den Handel eintreten, warnt ein Cybersicherheitsexperte die Verbraucher. Laut Miguel Fornes, Information Security Manager bei Surfshark, tritt die beispiellose Beschleunigung der agentischen KI nun in eine neue und potenziell riskante Phase ein: den agentischen Handel, oft als »agentisches Shopping› vermarktet. »Wir erleben den größten technologischen Krieg, den die Menschheit je gesehen…

News | Trends 2026 | Trends Security | Effizienz | IT-Security

2026 Schalter umlegen: Von der Reaktion zur Prävention

Neue Technologien, neues Tempo: Die Kompetenzen der Cyberkriminellen entwickeln sich schneller denn je. 2026 werden Unternehmen deshalb einen grundlegenden Wandel vollziehen: weg von einer reaktiven Defensive hin zu proaktiver und präventiver Gefahrenabwehr. Zwingender Auslöser dieses Umschaltens sind Cyberkriminelle, die zunehmend Schwachstellen in Edge-Netzwerken ausnutzen sowie Living-off-the-Land-Techniken (LOTL) verwenden. Letztere zielen darauf ab, eine herkömmliche Abwehr…

News | Business | Favoriten der Redaktion | IT-Security | Kommunikation | Tipps

Bedrohungen und Risiken für Unternehmen durch Desinformation

Unternehmen sehen sich heute mit einer Vielzahl von Gefahren konfrontiert, wenn manipulierte Inhalte wie Fake-News, Deepfakes oder gefälschte Zitate im Umlauf sind. Diese können das Vertrauen von Kunden, Partnern und Mitarbeitenden erheblich untergraben, Shitstorms auslösen und langfristig das Markenbild negativ beeinflussen. Oft sind die Folgen solcher viral verbreiteten Schäden nur schwer vollständig zu beheben.…

News | Trends 2026 | Trends Security | IT-Security

EvilGPT, Quantenrisiken, Fehlinformationen und Cloud-Abhängigkeit: Diese Cybergefahren drohen 2026

Cyberangriffe werden 2026 noch gezielter, automatisierter und schwerer vorhersehbar. Während Verbraucherinnen und Verbraucher im Alltag immer stärker auf smarte Geräte, Online-Dienste und digitale Kommunikation setzen, wachsen die Online-Bedrohungen sowohl in ihrem Umfang als auch in ihrer Komplexität. Umso wichtiger ist es, die Entwicklungen im Blick zu behalten, um zu verstehen, welche Dynamiken die Bedrohungslandschaft von…

News | Business | Business Process Management | Geschäftsprozesse | Strategien | Ausgabe 11-12-2025

Vom Dokument zum Datenfluss – Informationsmanagement neu denken

Viele Unternehmen wissen gar nicht, was ihre Dokumentenprozesse kosten. Wo analoge und digitale Abläufe nebeneinander existieren, verlieren sich Verantwortlichkeiten, Standards und Kennzahlen. Wie groß die Lücke zwischen technischer Digitalisierung und strategischem Informationsmanagement ist, zeigt eine Umfrage von MSM Research und SPS. Sie untersucht, wo Unternehmen in Deutschland und der Schweiz heute stehen – und welche Weichen sie stellen müssen, um brachliegende Potenziale für Effizienzsteigerung, »Speed« und Kundenzufriedenheit zu nutzen.

News | Trends 2026 | Trends Security | Effizienz | IT-Security | Künstliche Intelligenz

Cybersicherheit 2026: KI und Regulierungen verändern das Spiel

Zum Ende des Jahres 2025 analysieren Experten die wachsende Bedeutung von künstlicher Intelligenz (KI) für die Cybersicherheit und im Kontext der Cyberbedrohungen. Während Unternehmen in einer zunehmend komplexen Landschaft zahlreicher und ausgeklügelter Cyberbedrohungen agieren, erweist sich KI als ein mächtiges Instrument für die Verteidigung. Gleichzeitig ist sie aber auch zu einer Waffe für Cyberkriminelle geworden,…