Mit digitaler Echtzeitvisualisierung Potenziale ausschöpfen und wachsendem Margen-, Effektivitäts- und Transparenzdruck gerecht werden.

Unternehmen aller Branchen stehen unter großem Druck, ihre innerbetrieblichen Waren- und Materialflüsse zu optimieren. Der anhaltende Trend zur Individualisierung von Aufträgen führt zu stetig schrumpfenden Losgrößen. Gleichzeitig wachsen die Ansprüche der Kunden nach schnellerer Auslieferung bei maximaler Termin- und Liefertreue. Und dieser Druck wird steigen: Big-Data- und Blockchain-Entwicklungen werden Anforderungen an die Effizienz, vor allem aber an die Transparenz von Logistik- und Produktionsprozessen weiter massiv erhöhen.

Ein entscheidender Aspekt, dieser Herausforderung gerecht zu werden, ist die Fähigkeit, mit Blick auf seine Arbeitsumgebung ständig folgende Fragen beantworten zu können: Wo steht unser Ist-Wert relativ zu unserem Soll-Wert? Und an welcher Stelle besteht welches Problem, das uns davon abhält, unsere Zielvorgaben zu erreichen?

Unternehmen, die diese Fragen beantworten können, verfügen über einen gewichtigen Wettbewerbsvorteil. Denn nur sie können ihre Effektivitätspotenziale wirklich ausschöpfen und den wachsenden Transparenzansprüchen gerecht werden.

Der entscheidende Faktor hierfür sind hochwertige Echtzeitdaten. Hochwertig bedeutet, dass die Daten erstens jederzeit verfügbar sind und zweitens individuell maßgeschneidert für die unterschiedlichen Unternehmensbereiche aufbereitet werden. Denn nur so kann jeder einzelne Mitarbeiter Probleme im Ablauf frühzeitig erkennen und adäquat auf sie reagieren.

Die Informationsbasis ist vorhanden. Dank SAP und Business-Intelligence-Analysesystemen sind die dafür notwendigen Prozessinformationen häufig bereits vorhanden. Das Problem liegt jedoch in der Zugänglichkeit und Aufbereitung dieser Informationen.

Üblicherweise werden Daten von einem BI-System aus den Vorsystemen »eingesammelt« und in einem Data Warehouse (DWH) abgelegt. Oftmals durchlaufen sie unterschiedliche Schichten der Aufbereitung, zum Beispiel, um die Datenintegrität und -qualität zu prüfen oder sie inhaltlich so aufzubereiten, dass sie mit den Daten anderer Quellsysteme verknüpft werden können. Das Ergebnis sind Rohdaten, die interpretiert und zusammengeführt werden müssten. Eine Aufgabe, die in der Regel nur sogenannten Informationsspezialisten, typischerweise also Ein- und Verkäufern, Abteilungsleitern und Managern, vorbehalten ist.

Dabei wäre der Zugang zu diesen Informationen gerade auch für Nicht-IT-Fachleute beispielsweise direkt im Lager oder an ihrem unmittelbaren Arbeitsplatz besonders hilfreich. Denn sie sind es, die auf Live-Informationen direkt reagieren können und müssen. Zahlen vom Vortag sind für das reaktive Steuern und Optimieren von Prozessen dagegen völlig nutzlos.

Doch in der Regel und nach aktuellem Stand der Technik wird der Bereitstellungszyklus von Rohdaten nur einmal pro Tag durchlaufen – auf den Screens der Informationsspezialisten. Dies geschieht im einfachsten Fall mit Visualisierungstools wie Excel oder Software von Herstellern wie Tableau, QlikView oder ähnlichen Anbietern. Die Antworten auf die dringenden Fragen nach dem aktuellen Ist- und Soll-Zustand können also oft erst am Ende eines längeren Auswertungszyklus von wenigen Einzelpersonen beantwortet werden.

Diese Defizite verdeutlichen, dass Lösungen gefragt sind, die die digitale Verarbeitung von Rohdaten und deren Visualisierung auf einen neuen Stand bringen. Gelingt dies, steigen nicht nur Effizienz und Prozesssicherheit insgesamt. Ganz konkret werden zum Beispiel Schichtleiter entlastet und ihre Mitarbeiter durch eine neue Eigenverantwortung gefördert und motiviert.

Durch die einfache und effiziente Visualisierung von komplexen Daten und Prozessen in Echtzeit – auf Displays in Produktion, Logistik, Verwaltung und am Point of Sale – wird jeder Industriearbeitsplatz mit einer eigenen Intelligenz und Logik ausgestattet.

Anforderungen an ein leistungsfähiges Tool. Wer sich dafür entscheidet, Echtzeitvisualisierung von Prozessdaten im eigenen Betrieb voran zu treiben, muss einige grundsätzliche Kriterien hinsichtlich Darstellung, Leistungsfähigkeit und Anpassungsfähigkeit einer Lösung bedenken, die ein zukunftsfähiges Tool erfüllen sollte:

1. Datenanbindung

Es ist unentbehrlich, dass eine Datenanbindung an möglichst alle Vorsysteme und Datenquellen möglich ist – von Lieferanten über Maschinen bis hin zu Kundendaten. Gleichzeitig muss die Anwendung fehlertolerant sein, sodass die Visualisierungsleistung auch dann gegeben ist, wenn ein einzelner Systemabschnitt ausfällt. Es ist deshalb sinnvoll, dass der Datenaustausch dezentral, also direkt zwischen dem System stattfindet, das die Daten erzeugt (zum Beispiel SAP) und dem Tool, das diese Daten visualisiert. Das bedeutet eine Abkehr von klassischen BI-Strukturen hin zu einer eigenständigen Informationsbeschaffung durch jede einzelne Visualisierungsschnittstelle.

2. Schnelligkeit

Datenverarbeitung und Visualisierung müssen in Echtzeit stattfinden. Auch hierfür spielt dezentraler Datenaustausch eine wichtige Rolle. Denn während klassische BI-Strukturen in der Regel einen großen Zeitversatz erzeugen, ist mit einem dezentralen Ansatz tatsächlich eine Echtzeitvisualisierung möglich.

3. Aufbereitung der Daten

Um Mitarbeiter konkret zu besseren und effizienteren Arbeitsschritten zu befähigen, muss die Darstellung der Daten einer Informationslogik folgen, die keiner Interpretation bedarf. Einem Lagerarbeiter sollte nicht zugemutet werden, Rohdaten zu beurteilen, die den Gesamtprozess abbilden.

4. Prozessanweisungen

Bei komplexen Prozessinformationen reicht es häufig nicht aus, lediglich Daten zu liefern. Es muss gegebenenfalls definiert werden, wie mit welchen Daten umgegangen wird – jeder Information sollte also auch eine Prozessanweisung folgen können.

5. Flexibilität

Für jeden einzelnen Arbeitsplatz sind individuelle Prozessinformationen und -anweisungen relevant. Ein Visualisierungstool muss also eine Selektionsleistung erbringen, die flexibel und individuell gestaltbar ist.

6. Agilität

Ein Informationssystem muss für jede Veränderung und Erweiterung im Betrieb anpassbar sein. Ein starr programmiertes Board wird im schlimmsten Fall die Tür für weitere Verbesserungen schließen. Entsprechend muss frühzeitig die Option mitgedacht werden, das bestehende Informationssystem sukzessive auf- und auszubauen. Digitalisierung kann so in kleinen Schritten in Eigenregie umgesetzt werden, ohne dass dafür hohe Kosten für Beratungen, Systemumstrukturierungen oder ständig neu zu konsultierende IT-Expertise nötig wären.

Fazit. Durch die einfache und effiziente Visualisierung von komplexen Daten und Prozessen in Echtzeit – auf Displays in Produktion, Logistik, Verwaltung und am Point of Sale – wird jeder Industriearbeitsplatz mit einer eigenen Intelligenz und Logik ausgestattet. Datenquellen werden vernetzt und visualisiert, Prozesse können ad-hoc gesteuert werden. Die Kommunikation zwischen Mensch und Maschine ist eng auf die jeweiligen Aufgaben abgestimmt und schafft Effizienz und Übersichtlichkeit, standardisiert Prozesse und verringert die Fehlerquote.

Patrick Theobald ist CTO und

Patrick Theobald ist CTO und

Gründer von Peakboard.

https://peakboard.com/

Bilder: © Peakboard

NEWS | BUSINESS INTELLIGENCE | DIGITALISIERUNG | TRENDS SERVICES | TRENDS 2016 | MARKETING | SERVICES | STRATEGIEN

Business Intelligence: Trendthema Nummer eins bleibt Data Discovery/Datenvisualisierung

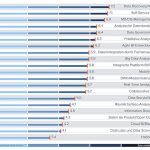

Der BI Trend Monitor 2017 [1] gibt detailliert Auskunft darüber, welche Business Intelligence (BI) Trends [2] den Markt derzeit am stärksten beeinflussen, auf welche Themen Best-in-Class-Unternehmen setzen und wo regionale, unternehmens- und branchenspezifische Unterschiede liegen. Für die Studie hat das Business Application Research Center (BARC) weltweit rund 2.800 Anwender, Berater und Softwarehersteller zu 21 BI- und Datenmanagementtrends befragt. Data Discovery/Datenvisualisierung,…

BUSINESS | AUSGABE 9-10-2016

Einheitliche Visualisierung für Finanzreports – Informieren statt dekorieren

NEWS | BUSINESS | BUSINESS INTELLIGENCE | EFFIZIENZ | GESCHÄFTSPROZESSE | KOMMUNIKATION

Visualisierung sorgt für mehr Agilität im Unternehmen

Vom Tagesgeschäft bis zur strategischen Unternehmenssteuerung: Grafische Darstellungen können wichtige Informationen auf einen Blick vermitteln und Unternehmen damit an vielen Stellen zu mehr Agilität verhelfen. In Zeiten sich ständig wandelnder Märkte müssen die Verantwortlichen im Unternehmen in der Lage sein, richtige Entscheidungen schnell zu treffen. Dazu benötigen die Entscheidungsträger von der Fertigungshalle bis zur Chefetage…

NEWS | BUSINESS INTELLIGENCE | TRENDS SERVICES | GESCHÄFTSPROZESSE | SERVICES

Big Data Vendor Benchmarks in der Kategorie »Big Data Visualisierung/Dashboards«

Als einer der ersten Quadranten aus dem aktuellen »Experton Big Data Vendor Benchmark« wurde die Marktkategorie »Visualisierung und Reporting« erstellt. Was nützt die beste Analyse, wenn das Ergebnis den beteiligten Mitarbeitern nicht veranschaulicht werden kann? Deswegen haben einige Anbieter einen enormen Aufwand in die Entwicklung von Dashboard- und anderen Visualisierungs-Tools gesteckt. Teilweise steht hinter dieser…

NEWS | BUSINESS INTELLIGENCE | LÖSUNGEN

IT als Teil der Business-Strategie – Wie IT einen zentralen Beitrag zur Verbesserung der Geschäftsprozesse leistet

In der IT-Abteilung des Payment-Spezialisten Ingenico geht es vorausschauend zu. Längst haben die Verantwortlichen die Business-Relevanz der IT erkannt und den Wandel vom eher defensiven Service-Dienstleister zum engagierten Business-Partner vollzogen. Auf Basis der Advanced-Analytics-Lösung CIO Cockpit schafft Ingenico komplette Transparenz in der IT-Umgebung und ermöglicht – aus der IT heraus – die Financial-Management-Sicht auf alle…

NEWS | BUSINESS INTELLIGENCE | BUSINESS PROCESS MANAGEMENT | DIGITALE TRANSFORMATION

Neue Kultur durch Business Intelligence & Advanced Analytics

Im Zuge des rasant fortschreitenden technischen Wandels stehen Unternehmen heute neue Analysemethoden zur Verfügung. Im Gegensatz zur vergangenheitsorientierten klassischen Business Intelligence (BI) verfolgen diese modernen Analysewerkzeuge einen in die Zukunft gerichteten Verwendungszweck. Dadurch ist es nun möglich, nicht nur den operativen und strategischen Mehrwert von Daten erheblich zu steigern, sondern Informationen als entscheidenden Erfolgsfaktor zu…

NEWS | BUSINESS | BUSINESS INTELLIGENCE | LÖSUNGEN | ONLINE-ARTIKEL | SERVICES

Der Mittelstand profitiert eindeutig von Predictive Analytics

Predictive Analytics ist mehr als nur ein Big-Data-Trend. Beispiele zeigen, dass gerade der Mittelstand ohne großen finanziellen Aufwand Daten nutzen kann, um zukünftige Ereignisse vorherzusagen. Der Wunsch ist vielerorts groß, Vorhersagen auf Basis von historischen Daten zu treffen. Aber wie stellen sich Mittelständler mit ihren vergleichsweise kleinen IT-Abteilungen wirkungsvoll auf? Wie können die innovativen Vorstellungen…

NEWS | BUSINESS | DIGITALISIERUNG | DIGITALE TRANSFORMATION | FAVORITEN DER REDAKTION | INFOGRAFIKEN

Wie steht es um die Digitalisierung in deutschen KMU?

Die Digitalisierung hat als wesentlicher Bestandteil unseres täglichen Lebens auch eine digitale Transformation der Geschäftswelt hervorgerufen: Prozesse werden automatisiert, der Datenaustausch und das Datenmanagement erheblich erleichtert und Unternehmen profitieren von Zeiteinsparungen und Rentabilitätssteigerungen. Insbesondere für Kundenbeziehungen ist die Digitalisierung von entscheidender Bedeutung. Das Nutzen verschiedener digitaler Kanäle führt zu einer erhöhten Sichtbarkeit und verbesserten…

NEWS | BUSINESS | BUSINESS INTELLIGENCE | KÜNSTLICHE INTELLIGENZ | ONLINE-ARTIKEL

Auf jede Frage eine Antwort: Sichere Entscheidungsfindung dank künstlicher Intelligenz

Unternehmen benötigen riesige Datenmengen, um angemessen über die geschäftliche Ausrichtung zu urteilen. Im Zeitalter von Big Data nimmt der Pool relevanter Informationen dabei immer weiter zu. Wertvolle Unterstützung erhalten Führungskräfte durch künstliche Intelligenz (KI), die dabei hilft, Antworten auf komplexe Fragestellungen zu geben. Zuverlässige Methoden der Datenorganisation und -auswertung bilden die Kernaspekte einer erfolgreichen…

NEWS | ONLINE-ARTIKEL

Die Entwicklung von modernen Technologien in der Spielebranche

Die Spielebranche ist eine der am schnellsten wachsenden Felder im Online-Bereich und entwickelt sich zeitgleich immer weiter fort. Die technologischen Errungenschaften der letzten Jahre in der Branche sind atemberaubend. Die Spieler fordern mehr von den Anbietern und diese müssen liefern. Dies hat dazu geführt, dass jede Menge junge Unternehmen den Markt revolutioniert haben. Einer…

NEWS | BUSINESS INTELLIGENCE | BUSINESS PROCESS MANAGEMENT | DIGITALISIERUNG | STRATEGIEN| AUSGABE 3-4-2019

Advanced, predictive, preventive: Data Analytics – Trend oder Zukunft?

Die Themen Digitalisierung und Big Data stehen bereits seit Jahren auf der »To-do-Liste« der Unternehmen und sind auch in den Fachmedien mehr als präsent. Allerdings steckt die Umsetzung in der Realität bei vielen Unternehmen noch in den Kinderschuhen. Das Potenzial, das Daten bieten, ist häufig nicht auf den ersten Blick ersichtlich. Erst durch eine detaillierte Analyse der Daten lassen sich diese optimal nutzen. Mittlerweile eröffnen sich hier mit Data Analytics ganz neue Möglichkeiten.

NEWS | DIGITALISIERUNG | FAVORITEN DER REDAKTION | LÖSUNGEN | ONLINE-ARTIKEL

Wie Automatisierung des Data Warehouse den Wert der Unternehmensdaten erhöhen kann

Volume, Velocity, Variety, Veracity. Im englischen IT-Sprachgebrauch haben sich die vier Vs der Datenspeicherung längst etabliert. Volumen, Geschwindigkeit, Vielfalt und Wahrhaftigkeit gilt es in Einklang zu bringen, um die Daten eines Unternehmens erfolgreich verwalten zu können. Herkömmliche Data-Warehouse-Infrastrukturen sind häufig nicht mehr in der Lage, die enormen Datenmengen, die Vielfalt der Datentypen, die Geschwindigkeit mit…

NEWS | BUSINESS | GESCHÄFTSPROZESSE | LÖSUNGEN | SERVICES | AUSGABE 7-8-2017

Management by Excel – ein Relikt der Vergangenheit?

NEWS | BUSINESS | BUSINESS INTELLIGENCE | DIGITALE TRANSFORMATION | TRENDS GESCHÄFTSPROZESSE | TRENDS SERVICES | TRENDS 2017

Digital Labs: Wie aus Daten erfolgreiche Geschäftsmodelle entstehen

Eine aktuelle Studie untersucht, wie digitale Produkte und datenbasierte Business-Modelle zum Unternehmenserfolg beitragen. Welchen Beitrag leisten Digital Labs zur digitalen Transformation von Unternehmen? Und wie gehen Entwickler, Data Scientists, Design-Denker und Ingenieure in den Digital Labs mit Firmendaten und externen Datenquellen um? Antworten auf diese Fragen liefert der Report »Data is the Product –…

NEWS | BUSINESS INTELLIGENCE | CLOUD COMPUTING | DIGITALISIERUNG | INTERNET DER DINGE | LÖSUNGEN | RECHENZENTRUM | SERVICES | STRATEGIEN

Big Data – Schluss mit lustig – Big Data wird ernst!

Seit 2011 beobachten wir bei Experton den Markt und die Lösungen für das Trendthema »Big Data«. Inzwischen haben viele Anbieter Produkte, Lösungen und Services für die neuen Datendimensionen in den Anwenderunternehmen auf den Markt gebracht. Bislang sind das jedoch vor allem Lösungen, die zunächst einmal rein technisch mit den Datenmengen umgehen können, schnelle Visualisierungsmöglichkeiten bieten,…