Illustration Absmeier foto freepik ki

KI-Systeme wie ChatGPT können Perspektiven verzerren – ein Risiko, das bislang nur teilweise erfasst wird.

Große Sprachmodelle beeinflussen zunehmend, wie Menschen Informationen wahrnehmen und bewerten. Die Studie »Communication Bias in Large Language Models: A Regulatory Perspective«, erschienen im Journal »Communications of the ACM«, zeigt nun, dass diese Systeme gesellschaftliche und politische Perspektiven verzerren können und analysiert zugleich, warum die europäische KI-Regulierung dieses Risiko bislang nur teilweise erfasst [1].

Die systematische Bevorzugung, Verstärkung oder Ausblendung bestimmter sozialer, kultureller oder politischer Perspektiven in KI-generierten Antworten bezeichnen die Forscher als Kommunikationsbias. »Sprachmodelle liefern nicht nur Informationen. Sie strukturieren auch, welche Argumente sichtbar werden und welche Deutungen plausibel erscheinen. Diese oft subtilen Effekte sind für Nutzerinnen und Nutzer kaum sichtbar und können öffentliche Debatten und demokratische Meinungsbildung beeinflussen«, sagt Stefan Schmid, Leiter des Fachgebiets »Internet Architecture and Management« an der TU Berlin und Projektleiter am Weizenbaum-Institut, der die Studie mit Adrian Kuenzler, Professor an der Rechtswissenschaftlichen Fakultät der University of Hong Kong, durchgeführt hat. Zusammen haben sie untersucht, wie solche Verzerrungen in großen Sprachmodellen entstehen und welche Herausforderungen sich daraus für Regulierung und Steuerung ergeben.

Wie Kommunikationsbias entsteht

Die Autoren identifizierten mehrere Ursachen für kommunikative Verzerrungen in großen Sprachmodellen. Eine wichtige Rolle spielen Trainingsdaten, in denen bestimmte Perspektiven stärker vertreten sind als andere. Auch Entscheidungen beim Training und Feintuning der Modelle beeinflussen, welche Argumentationsmuster bevorzugt werden.

Hinzu kommt eine weitere Eigenschaft vieler Sprachmodelle: Sie neigen dazu, sich an Erwartungen oder Positionen von Nutzern anzupassen – ein Effekt, der in der Forschung als Sycophancy bezeichnet wird. Da diese Einflüsse häufig kontextabhängig und schwer messbar sind, lassen sich solche Verzerrungen bislang nur begrenzt systematisch erfassen.

Interdisziplinäre Analyse von Technik, Recht und Markt

Für ihre Studie verbinden Schmid und Kuenzler technische, rechtliche und ordnungspolitische Perspektiven. Sie ordnen bestehende Forschung zu politischen Verzerrungen, Polarisierung und Sycophancy in Sprachmodellen ein und analysieren zentrale europäische Regelwerke: den AI Act, den Digital Services Act (DSA) und den Digital Markets Act (DMA).

Ihr Befund: Kommunikationsbias ist kein Randphänomen, sondern ein strukturelles Thema an der Schnittstelle von Technikdesign, Marktstruktur und Regulierung.

Warum die Regulierung bislang nur begrenzt greift

Nach Einschätzung der Autoren setzen die bestehenden europäischen Regelwerke zwar wichtige Standards für Transparenz, Sicherheit und Rechenschaft. Die kommunikative Wirkung großer Sprachmodelle wird jedoch bislang meist nur indirekt adressiert. Sie betonen zudem, dass große Sprachmodelle zunehmend als eigenständige Untergruppe von KI-Systemen zu betrachten seien. Gerade weil sie für viele Nutzer*innen die unmittelbare Schnittstelle zur KI bildeten, könnten sie nicht nur öffentliche Debatten, sondern auch persönliche Entscheidungen in Bereichen wie Gesundheit, Finanzen und Politik beeinflussen. Nach Auffassung der Forscher erfassen die bestehenden Regelwerke dieses Risiko bislang nur unzureichend, insbesondere soweit es um den Einfluss auf grundlegende Weltbilder, soziale Perspektiven und politische Entscheidungsprozesse geht.

Der AI Act konzentriert sich vor allem auf Pflichten entlang der Entwicklungs- und Bereitstellungskette von KI-Systemen. Der Digital Services Act greift insbesondere dort, wo bereits konkrete systemische Risiken oder problematische Inhalte sichtbar werden. Kommunikationsbias erscheint damit eher als Nebenfolge anderer Regulierungsmechanismen als eigenständiges Problem öffentlicher Kommunikation.

Gefahr der Marktkonzentration

Hinzu kommt die zunehmende Marktkonzentration im Bereich großer Sprachmodelle. Wenn wenige Unternehmen zentrale Modelle, Schnittstellen und Datenzugänge kontrollieren, können sich bestimmte kommunikative Muster besonders stark durchsetzen. Aus Sicht der Autoren muss deshalb neben der Inhalts- und Sicherheitsregulierung auch die Wettbewerbsordnung stärker in die Steuerung von KI einbezogen werden.

»Wer Risiken durch Sprachmodelle wirksam begrenzen will, darf nicht nur auf Verbote oder Einzelfallmoderation setzen«, sagt Adrian Kuenzler. »Es braucht ein Informationsökosystem, in dem Vielfalt, Nachvollziehbarkeit und Wettbewerb technisch, regulatorisch und institutionell mitgedacht werden.«

Ein umfassender Steuerungsansatz

Die Studie plädiert für einen breiteren Regulierungsansatz. Dazu gehören Vorgaben entlang der gesamten Entwicklungs- und Nutzungskette, überprüfbare Aufsichts- und Moderationsmechanismen, mehr Wettbewerb im Markt für KI-Systeme sowie eine technische Gestaltung, die Vielfalt und Transparenz gezielt stärkt.

Die Autoren verweisen unter anderem auf regelmäßige Audits, geeignete Benchmarks zur Untersuchung kommunikativer Verzerrungen, größere Transparenz über Trainingsdaten und Modellverhalten sowie wirksame Korrekturmöglichkeiten nach der Markteinführung. Ziel sei ein digitales Kommunikationsumfeld, das Verzerrungen begrenzt und eine vielfältige öffentliche Debatte unterstützt.

[1] Über die Studie

Adrian Kuenzler, Stefan Schmid: Communication Bias in Large Language Models: A Regulatory Perspective.

Communications of the ACM. DOI: 10.1145/3769689

https://dl.acm.org/doi/10.1145/3769689

534 Artikel zu „KI Bias“

News | Business | Digitalisierung | IT-Security | Künstliche Intelligenz

Bias in der KI erkennen und reduzieren: IDnow bringt Forschungserkenntnisse in die Praxis

Im Rahmen des EU-geförderten Projekts MAMMOth zeigt IDnow, wie sich Verzerrungen in KI-Systemen erkennen und reduzieren lassen – ein wichtiger Schritt hin zu vertrauenswürdiger digitaler Identitätsprüfung. Das EU-geförderte Projekt MAMMOth (Multi-Attribute, Multimodal Bias Mitigation in AI Systems) hat nach drei Jahren intensiver Arbeit zentrale Ergebnisse zur Verringerung von Verzerrungen in KI-Systemen veröffentlicht [1]. Gefördert…

News | Favoriten der Redaktion | Künstliche Intelligenz | Strategien | Tipps

Fakten statt Fiktion: Was tun gegen KI-Halluzinationen und KI-Bias?

Generative KI ist unglaublich gut darin, Informationen zu recherchieren und aufzubereiten. Unfehlbar ist sie allerdings nicht – sie kann durchaus falsch liegen oder vorurteilsbehaftete Ergebnisse liefern. Doch es gibt Maßnahmen, mit denen Unternehmen das Risiko von Halluzinationen und Bias minimieren können. Immer mehr Unternehmen setzen generative KI (GenAI) ein, um beispielsweise Mitarbeitern den Zugang zu…

News | Künstliche Intelligenz | Trends 2023

Generative KI: Mehrheit fürchtet Bias, Datenschutzverletzungen und Urheberrechtsprobleme

Applause befragt über 3.000 Fachleute weltweit zu ihrer Nutzung und ihren Bedenken von Nutzung generativer KI am Arbeitsplatz. 90 Prozent der Teilnehmer weltweit befürchten, dass KI-Voreingenommenheit die Genauigkeit der Antworten beeinträchtigen könnte. 67 Prozent glauben, dass generative KI-Dienste den Datenschutz verletzen. Applause, ein Anbieter für Software-Testing und digitale Qualitätssicherung, hat die Ergebnisse seiner ersten…

News | Business | Business Process Management | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | Strategien | Tipps

Das Wikipedia‑Verbot für KI‑Texte ist ein Weckruf für Unternehmen

Datenökologie, Governance und strategische Risiken im Zeitalter generativer KI Das Wikipedia‑Verbot für KI‑Texte ist weniger ein KI‑Problem als vielmehr ein Signal für die Bedeutung stabiler unternehmensinterner Datenökosysteme. Model Collapse und »Habsburg AI« sind reale Risiken, entstehen jedoch nicht automatisch, sondern vor allem durch fehlende Daten‑Governance und unkontrollierten Einsatz synthetischer Inhalte. Die zentrale Botschaft…

News | Trends 2026 | Business Process Management | Trends Security | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | Services

90 % der Unternehmen setzen Security-Teams unter Druck, Identitätskontrollen für KI zu lockern

Neue Studie zeigt fehlende Transparenz bei KI-Identitäten, wachsende Risiken durch Non-Human Identities (NHI) und ein Vertrauensparadox in der KI-Sicherheit Delinea, ein Anbieter von Lösungen zur Sicherung menschlicher und maschineller Identitäten durch zentralisierte Autorisierung, hat seine neue Studie veröffentlicht, die zeigt, wie die schnelle Einführung von KI die Risiken für Identitätssicherheit in Unternehmen verändert [1].…

News | Trends 2026 | Business | Künstliche Intelligenz | New Work | Services | Tipps | Whitepaper

Die Technologie-Branche steht vor tiefgreifender Transformation und neuen Skill-Bedarfen

Die Technologie-Branche befindet sich in einer Phase erheblicher Umbrüche. KI-gestützte Systeme, Automatisierung und Cloud-Infrastrukturen optimieren Prozesse und verändern Kompetenzprofile in einem rasanten Tempo. Das belegt auch der Skills Economy Report 2026 von Cornerstone, der auf mehr als 28 Terabyte Echtzeit-Arbeitsmarktdaten aus über 200 Ländern basiert [1]. Der Report zeigt deutlich, dass KI, Code-Automation sowie smarte…

News | Trends 2026 | Business Process Management | Digitalisierung | Trends Security | Favoriten der Redaktion | IT-Security | Künstliche Intelligenz | Whitepaper

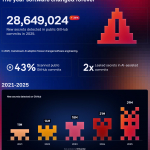

KI beschleunigt die unkontrollierte Verbreitung von Zugangsdaten um ein Vielfaches

Im Jahr 2025 weisen Entwickler-Commits mit Claude Code* eine Leak-Rate von 3,2 Prozent bei Zugangsdaten auf, gegenüber einem Basiswert von 1,5 Prozent. Der menschliche Faktor bleibt entscheidend. GitGuardian, der Sicherheitsanbieter hinter der meistinstallierten Anwendung auf GitHub, veröffentlicht die fünfte Ausgabe seines Berichts »State of Secrets Sprawl« (Lagebericht zur Ausbreitung von Zugangsdaten) [1]. Der Lagebericht…

Ausgabe 1-2-2026 | News | Business | Künstliche Intelligenz | Services

Personalwesen 4.0 – Wie KI den Unternehmenswert steigert

Das Personalwesen steht vor einem tiefgreifenden Wandel: Weg von der reinen Verwaltungsfunktion, hin zum strategischen Treiber für den Unternehmenserfolg. Fachkräftemangel, hybride Arbeitsmodelle und gestiegene regulatorische Anforderungen werden oft als Belastungen empfunden. Doch die Integration von KI bietet die Chance, diese Herausforderungen in Wettbewerbsvorteile zu verwandeln. Anstatt unter Druck zu geraten, kann die Personalabteilung ihre Rolle neu definieren und einen messbaren Mehrwert für das Unternehmen schaffen.

News | Trends 2026 | Business | Trends 2028 | Favoriten der Redaktion | Geschäftsprozesse | Infrastruktur | IT-Security | Künstliche Intelligenz | Services

Bis 2028 wird fehlkonfigurierte KI die kritische Infrastruktur eines G20-Staates lahmlegen

Ein sicherer Übersteuerungsmechanismus in KI-Systemen, die nationale kritische Infrastrukturen unterstützen, ist unerlässlich, um die letztendliche Kontrolle durch den Menschen sicherzustellen. Gartner, Inc., ein Unternehmen für Geschäfts- und Technologieanalysen, prognostiziert, dass bis 2028 eine fehlkonfigurierte KI in cyber-physischen Systemen (CPS) die kritische Infrastruktur eines G20-Landes zum Erliegen bringen wird. Gartner definiert cyber-physische Systeme (CPS)…

News | Business | Industrie 4.0 | Künstliche Intelligenz | Strategien

KI in der Fertigungsindustrie: KI muss endlich produktiv werden

Für die Fertigungsindustrie markiert 2026 einen Wendepunkt: Nach Jahren technologischer Experimente rücken belastbare Ergebnisse, wirtschaftlicher Nutzen und operative Resilienz in den Mittelpunkt. Denn der Produktionsalltag ist weiterhin geprägt von steigender Komplexität und regulatorischen Anforderungen sowie volatilen Lieferketten. Das zwingt Unternehmen jetzt dazu, den tatsächlichen Mehrwert von Technologie neu zu bewerten – vor allem dort, wo…

News | Business | Geschäftsprozesse | Kommunikation | Künstliche Intelligenz | New Work | Services | Tipps

KI menschenzentriert einsetzen – auch für Frontline-Beschäftigte

Frontline-Beschäftigte tragen den Betrieb – und sind oft unbeachtet. Unternehmen müssen reagieren, sagt Benedikt Lell, VP Solutions Consulting EMEA bei UKG. Ob im Handel, in der Pflege, in der Logistik oder in der Produktion: Frontline-Beschäftigte halten vielerorts den Betrieb am Laufen. Sie stehen im direkten Kontakt mit Kunden, Patienten oder Maschinen, sichern Wertschöpfung und…

News | Trends 2026 | Business | Trends 2030 | Digitale Transformation | Trends Wirtschaft | Geschäftsprozesse | Künstliche Intelligenz

KI und digitale Souveränität: KI entscheidet über Wettbewerbsfähigkeit bis 2030

Keine Zukunft ohne künstliche Intelligenz (KI)? Eine neue Studie der Digitalberatung valantic in Kooperation mit dem Handelsblatt Research Institut (HRI) gibt hierauf eine klare Antwort: Unternehmen, die nicht konsequent auf KI-Technologien setzen, werden bis 2030 ihre Wettbewerbsfähigkeit verlieren. Vier von fünf Entscheider (79 Prozent) stimmten dieser Aussage im Rahmen der neuen C-Level-Befragung »Digital Excellence Outlook…

News | Produktmeldung | Rechenzentrum | Services

KI-gestützter vorausschauender Wartungsservice für moderne Rechenzentren und KI-Fabriken

Vertiv Next Predict ist ein neuer KI-gestützter Managed Service, der Fachwissen aus der Praxis mit fortschrittlichen Algorithmen für maschinelles Lernen kombiniert, um Probleme zu antizipieren, bevor sie auftreten. Vertiv, ein weltweit führender Anbieter für kritische digitale Infrastrukturen, stellt mit Vertiv Next Predict einen KI-gestützten Managed Service vor, der die Wartung von Rechenzentren grundlegend verändert.…

News | Trends 2026 | Digitalisierung | Favoriten der Redaktion | Künstliche Intelligenz | New Work | Strategien

Vertrauen, Kontrolle und Menschlichkeit: Diese Werte sind 2026 wichtig, wenn es um KI geht

Wenn heute über künstliche Intelligenz gesprochen wird, dann meist im Takt der Technologiezyklen: neue Modelle, neue Benchmarks, neue Superlative. 2026 rückt jedoch ein Aspekt stärker in den Vordergrund, der sich nicht in FLOPS, GPU-Generationen oder Parameterzahlen messen lässt – nämlich die Verantwortung, die Unternehmen gegenüber Mitarbeitenden, Kunden, Partnern und letztlich der Gesellschaft tragen. Gregor von…

News | Infrastruktur | Künstliche Intelligenz | Rechenzentrum | Strategien

Regionale Datensouveränität im Zeitalter der KI

Wie das Spannungsfeld zwischen Freiheit und Regulierung maximalen Mehrwert für Unternehmen schafft. Als Apollo 13 infolge der Explosion eines Sauerstofftanks in über 200.000 Meilen Entfernung von der Erde in eine kritische Situation geriet, standen die Ingenieure der NASA vor der Aufgabe, unter extremen Beschränkungen handlungsfähig zu bleiben. Rasche Entscheidungen mussten innovative Lösungsansätze mit unverrückbaren…

News | Trends 2026 | Trends Security | IT-Security | Künstliche Intelligenz | Whitepaper

KI-Identitäten außer Kontrolle: Massive Governance-Lücken in deutschen Unternehmen

Künstliche Intelligenz ist längst kein Zukunftsthema mehr. Sie agiert in Arbeitsumgebungen bereits heute autonom. Das ist auf der einen Seite ein Riesenvorteil, auf der anderen Seite jedoch schwierig überwachbar. Eine neue internationale Umfrage, beauftragt von Saviynt und in Deutschland, Großbritannien und den USA durchgeführt, zeigt: KI-Identitäten greifen bereits tief in kritische Systeme ein [1].…

News | Business | Künstliche Intelligenz | New Work | Strategien | Tipps

Wie mit agilen Prinzipien eine menschenzentrierte und nachhaltige KI-Einführung gelingt

In vielen Unternehmen werden KI-Lösungen implementiert, für die Mitarbeitende nicht bereit sind und die dann nicht akzeptiert und genutzt werden. Agile Prinzipien können helfen, die Technologien sinnvoll, schnell und wirksam einzusetzen. Katja Koch und Judith Borgmann, beide Senior Manager People & Culture bei der Management- und IT-Beratung MHP, sprechen im Interview darüber, wie sich künstliche…

News | Trends 2026 | Business | Trends Security | Künstliche Intelligenz | Services

Unkontrollierter Einsatz von KI birgt versteckte Geschäftsrisiken

Unternehmen gehen beim Einsatz von Large Language Models (LLMs) ohne angemessene Regularien, Verifikation und Aufsicht erhebliche rechtliche, finanzielle und reputationsbezogene Risiken ein. Die Studie »Risks of Unmanaged AI Reliance: Evaluating Regional Biases, Geofencing, Data Sovereignty, and Censorship in LLM Models« von Trend Micro zeigt, dass KI-Systeme je nach geografischem Standort, Sprache, Modelldesign und integrierten…