- Uneinheitlicher Ansatz in Bezug auf Datenstrategie, Kultur, IT-Infrastruktur und Cloud-Migration kann Unternehmen schaden

- Mehr als 80 Prozent der befragten Unternehmen berichten über Performance-Probleme, wenn sich Daten in verschiedenen Umgebungen befinden

- Nur 32 Prozent der Daten-Teams können die Erkenntnisse gewinnen, die ihr Unternehmen für eine bessere Entscheidungsfindung braucht

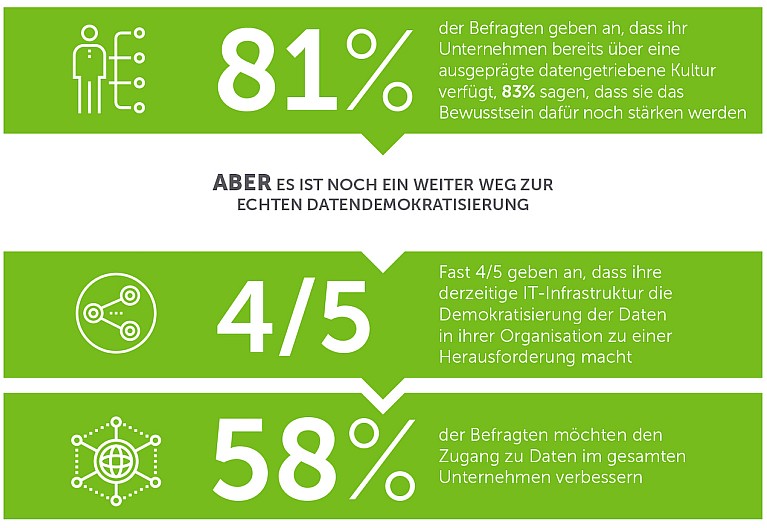

Die neue Studie der Exasol AG, Hersteller einer In-Memory-Analytics-Datenbank, zeigt, dass 68 Prozent aller Daten-Teams nicht in der Lage sind, die Erkenntnisse aus ihrem Datenbestand zu ziehen, die ihr Unternehmen für eine bessere Entscheidungsfindung braucht. Infolgedessen können Unternehmen nicht datengetrieben agieren – eine wichtige Voraussetzung im heutigen Wettbewerb. Darüber hinaus gaben 80 Prozent aller Datenverantwortlichen an, dass deren derzeitige IT-Infrastruktur die Datendemokratisierung erschwert. Dies jedoch schränkt die Fähigkeit, aus Erkenntnissen echten Nutzen zu ziehen, weiter ein. Die Studie Datenstrategie und Unternehmenskultur: Voraussetzungen auf dem Weg zur Cloud wurde durchgeführt von Sapio Research [1]. Das Marktforschungsunternehmen befragte im Auftrag der Exasol AG 2.000 Datenstrategie-Entscheider in den vier Kernmärkten Großbritannien, Deutschland, den USA und China.

Laut der Studie sind 96 Prozent der Befragten der Meinung, dass ein Cloud-Modell die Datendemokratisierung im Unternehmen erleichtert. 73 Prozent der Teilnehmer geben an, dass die Migration einiger oder aller Daten-Workloads in die Cloud einen positiven Einfluss darauf hatte, was sie mit ihren Daten machen können. Von diesen Befragten sagen 51 Prozent, dass die Cloud den Zugriff und die gemeinsame Nutzung von Daten verbessert hat, während 46 Prozent schnellere Antwortzeiten bei Abfragen angeben.

»Viele Unternehmen kratzen nur an der Oberfläche dessen, was mit ihren Daten möglich ist. Jede Organisation hat ein erhebliches Problem, wenn ihre IT-Infrastruktur den Datenzugriff für ihre Teams verlangsamt. Vier von fünf Entscheidungsträgern in unserer Studie berichten über Performance-Probleme. Das ist nicht akzeptabel«, sagt Mathias Golombek, CTO der Exasol AG. »Wenn die Teams nicht mit den Daten arbeiten können oder der Zugriff auf relevante Informationen zu lange dauert, bis sie das finden, was sie brauchen, kann man nicht von einem datengetriebenen Unternehmen sprechen.«

Die Studie zeigte ebenfalls, dass Entscheidungsträger das Verständnis der Geschäftsleitung für die Datenstrategie (40 Prozent) bemängeln und einen Widerstand (52 Prozent) gegen die Einführung datenbasierter Methoden wahrnehmen. Ein uneinheitlicher Ansatz in Bezug auf Datenstrategie, Kultur, IT-Infrastruktur und Cloud-Migration wird als potenzielle Ursache für dieses Problem angesehen.

»Das Aufsetzen einer Datenstrategie ist der wichtigste Schritt, um sicherzustellen, dass Unternehmen sich mit der von ihnen gewünschten Geschwindigkeit bewegen können – die Infrastruktur darf nicht zum Hindernis werden. Deshalb sollte die Wahl des Bereitstellungsmodells erst erfolgen, nachdem eine klare Datenstrategie festgelegt und eine effektive Datenkultur etabliert wurde«, sagte Golombek. »Wie die Mitarbeiter mit Daten arbeiten, ist ein großer Teil der Gleichung. Einschränkungen können zu Frustrationen führen und Teams daran hindern, wirklich datengetrieben zu arbeiten.«

[1] Die Umfrage wurde von Sapio Research unter mehr als 2.000 Entscheidungsträgern für Datenstrategien in den vier Kernmärkten Großbritannien, Deutschland, USA und China durchgeführt. Die Befragten arbeiten in einem breiten Spektrum von Geschäftsbereichen – von der C-Level-Ebene bis hin zu Marketing und Betrieb. Alle Befragten sind für das Sammeln oder das Anwenden der Erkenntnisse aus den Daten verantwortlich.

https://www.exasol.com/de/community/resources/resource/datenstrategie-und-unternehmenskultur-voraussetzungen-auf-dem-weg-zur-cloud/

Über die Exasol AG

Exasol bietet eine leistungsstarke und hoch performante In-Memory-Analytics-Datenbank, die Unternehmen darin unterstützt, die Art und Weise, wie sie mit Daten arbeiten, zu verändern. Dank ihrer Geschwindigkeit, Flexibilität und Skalierbarkeit ermöglicht sie die Umsetzung von langfristigen Datenstrategien im Unternehmen. Die In-Memory-Analytics-Datenbank ist On-Premises und in der Cloud verfügbar. Weitere Informationen zu Exasol unter www.exasol.com/de/

In-Memory-basierte Big-Data-Analyse – Verborgene Schätze

Big Data ist weit mehr als ein vielzitierter Hype, es ist pure Realität. Innerhalb von durchschnittlich nur 18 bis 24 Monaten verdoppeln sich produzierte Terabyte-Datenmengen in Unternehmen. Einem laut BITKOM (4/2014) bereits stolzen Big-Data-IT-Investitionsvolumen von 2,6 Milliarden Euro in 2014 steht laut Analysten jedoch die nüchterne Tatsache gegenüber, dass in diesem Jahr nicht einmal ein Fünftel der Fortune 500 Unternehmen in der Lage sein werden, Big Data tatsächlich für ihr Business zu nutzen. »manage it« sprach mit Aaron Auld, Chief Executive Officer bei der EXASOL AG, darüber, welches die heutigen strategischen Anforderungen hierzu sind und welche Rolle In-Memory-Computing bei der Datenanalyse zukommt.

Herr Auld, was hat sich bei den IT- und Datenbankszenarien von Unternehmen geändert?

Früher war eine Datenbank einfach eine schlichte Datenbank. Sie speicherte Daten und stellte diese Benutzern und Anwendungsprogrammen bereit. Stand heute hat sich die Welt der Daten im Zuge der zunehmenden Digitalisierung jedoch gravierend geändert. Sie ist deutlich komplexer, Datenmengen wachsen rasant an und der Erfolg von Unternehmen hängt zunehmend davon ab, ob und vor allem wie Daten genutzt werden. Immer wichtiger dabei ist der Business-Intelligence-Kontext (BI), sprich die Datenflut gezielt befragen zu können sowie automatisiert Zusammenhänge zu erkennen und darzustellen. Wer als Unternehmen Big Data sammelt, sie aber nicht analysiert und für den eigenen Geschäftserfolg nutzbar macht, wird auf lange Sicht nicht mit dem Wettbewerb mithalten können.

Welche Datenbankinfrastruktur treffen Sie in der täglichen Unternehmenspraxis am häufigsten an beziehungsweise setzen darauf auf?

Infrastrukturen werden immer heterogener. Ein wichtiger, immer mehr etablierter Infrastrukturbaustein ist Hadoop. Die Open-Source-Plattform skaliert und ist zugleich wirtschaftlich. Im hybriden Ökosystem werden in Zukunft immer mehr Applikationen auf Hadoop ablaufen. Die Integration von Business Intelligence in Hadoop ist allerdings nur bedingt sinnvoll, zumal bei zeitkritischen Anwendungen. Für hochwertige Analytics liefern In-Memory-Datenbanken die notwendige Geschwindigkeit und werden zunehmend als High-Performance-Schicht auf Hadoop aufgesetzt. Der Best-Practice-Ansatz, den viele datengetriebene Unternehmen verfolgen, erfordert leicht zu implementierende und maximal skalierbare Lösungen, die ein hohes Maß an Flexibilität ermöglichen und eigene, oft begrenzte IT-Ressourcen entlasten.

Stichwort »In-Memory«. Der Begriff ist gerade in aller Munde, was genau verbirgt sich dahinter?

Beim In-Memory Computing geht es darum – wie der Name schon sagt – Daten im Hauptspeicher und damit extrem schnell zu verarbeiten. Das ist grundsätzlich nichts Neues. Jeder Computer arbeitet genau nach diesem Prinzip. Früher waren die für den Hauptspeicher benötigten Chips allerdings sehr teuer, weshalb man so wenig Hauptspeicher wie möglich verwenden wollte. Herkömmliche Datenbanken sind aus diesem Grunde alle für Prozesse auf Festplatten optimiert, was im Vergleich zum Hauptspeicher sehr viel langsamer ist. Da der RAM-Preis im Verhältnis zum Festplattenspeicher seit Jahren im Sinkflug ist, können es sich Unternehmen jetzt ohne weiteres leisten, Hauptspeicher einzusetzen und dadurch von den riesigen Geschwindigkeitsvorteilen zu profitieren. Nur wenige Datenbankhersteller haben aber bis jetzt eine gut funktionierende Lösung für die veränderten Umstände entwickelt. Bei EXASOL arbeiten wir seit 15 Jahren In-Memory.

5 Überlegungen zu In-Memory basierter Big-Data-Analyse

- Big Data sollte als fester Bestandteil in der Unternehmensstrategie

integriert sein.- Die durchgängige Lösung von einem einzigen Anbieter gibt es nicht. Erfahrungsgemäß wählt man einen Best-Practice-Ansatz und überlegt genau, welche Aufgaben wer/was erfüllen sollte. Die Abhängigkeit von nur einem Anbieter kann sehr kostspielig werden und den Erfolg ausbremsen.

- Datenvolumen und -anforderungen ändern sich ständig: Abteilungen müssen in die Lage versetzt werden, ihren Analyse- und Datenbedarf schnell und einfach realisieren zu können.

- Compliance-Vorgaben erfüllen: Mitarbeiter schulen, Transparenz und Vertrauen schaffen sowie gut überlegen, welche Daten und Prozesse sinnvoll im Haus bleiben sollen beziehungsweise welche in die Cloud gelegt werden.

- Data Scientists: Immer mehr Unternehmen sind ›data driven‹ – das heißt Mitarbeiter sind gefragt, die mit dem Thema Big Data und

Datenanalyse umgehen können.

Mit welchen Investitionen muss ein Unternehmen rechnen, wenn es seine Daten über eine intelligente In-Memory-Datenbank analysieren möchte?

Dies hängt generell vom Einzelfall und der bereits bestehenden Infrastruktur ab. Hier ist es zunächst wichtig zu wissen, dass das Durchführen von Big-Data-Analysen in der Regel keinen großen Austausch vorhandener Systeme erfordert. Oftmals geht es nur um gezielte Ergänzungen und Erweiterungen. Ausschlaggebende Kriterien für die Kosten der einzusetzenden Analysesysteme sind insbesondere die Menge der anfallenden Daten sowie die genutzte Datenbanktechnologie. Setzt ein Unternehmen auf eine analytische In-Memory-Datenbank, so reduzieren sich die Lizenzkosten auf den tatsächlich genutzten Arbeitsspeicher und nicht auf die gesamten Datenmengen. Hinzu kommen intelligente Kompressionsalgorithmen und vollautomatisierte Prozesse, die die Investitionskosten einer In-Memory-Datenbank im Vergleich zu konventionellen Datenbanken schnell mehr als halbieren können. Und auch selbst bei einem stark beschränkten Budget lassen sich mithilfe von flexibel skalierbaren Software-as-a-Service- oder Cloud-Lösungen Big-Data-Projekte erfolgreich und kostengünstig umsetzen.

Können Sie anhand konkreter Beispiele verdeutlichen, welche Vorteile In-Memory-Analytics mit sich bringen?

Ein gutes Beispiel ist der Onlineversandhändler Zalando. Das Sortiment des Webshops erweitert sich stetig – mit aktuell über 150.000 Produkten. Seit Mitte 2010 ist das Data Warehouse von Zalando um mehr als den Faktor fünf gewachsen. Da die bisherig eingesetzte Lösung die hohen Ansprüche nicht mehr erfüllen konnte, ergänzte Zalando sein Data Warehouse um unsere analytische In-Memory Datenbank als skalierbares und flexibles Data Mart. Das Ergebnis: Das neue Datenbanksystem war innerhalb von nur acht Wochen produktiv einsetzbar und verkürzte etwa die nächtliche Vorberechnung von gut 13 Stunden auf ganze 30 Minuten. Zalando kann nun viel schneller auf die Wünsche seiner Kunden reagieren und dementsprechend zeitnah das Sortiment anpassen sowie Umsatzpotenziale und Marketing-Maßnahmen besser steuern.

5 Benefits zu In-Memory basierter Big-Data-Analyse

- Schnellste Big-Data-Analyse-Technologie

- Beliebige Skalierbarkeit

- Branchenunabhängig

- Ideale Datenbankergänzung – nahtlos integrierbar

- Realtime Analytics großer Datenmengen bei geringem TCO

Ein weiteres Beispiel ist das Karlsruher Unternehmen econda, einer der führenden Anbieter von Webanalyse- und Personalisierungslösungen auf dem europäischen Markt. Für seine mehr als 1.000 Kunden aus dem E-Commerce-Bereich verarbeitet econda bereits über 13 Terabyte Rohdaten monatlich – Tendenz steigend. Geschwindigkeit und Analyseflexibilität des gesamten econda-Systems hängen dabei stark von der zugrundeliegenden Datenbank ab. Durch die Integration unserer analytischen In-Memory-Datenbank ist econda nun in der Lage, seine Daten bis zu 100-fach schneller als zuvor auszuwerten. Aber nicht nur die Schnelligkeit sondern auch die Qualität beziehungsweise die Tiefe der Analysen wurden optimiert.

Was wäre noch zu beachten, um einem drohenden Daten-Overload entgegenzuwirken?

Technik allein genügt nicht, um die verborgenen Big-Data-Schätze zu heben. Eine enge Verzahnung zwischen analytischer Expertise, dem Know-how der eigenen Fachbereiche und der IT sind der Schlüssel zum Erfolg. Hier fehlt es oftmals an Spezialisten mit tiefgründigem Wissen von Datenanalysen. Erfahrene Data Scientists spielen eine entscheidende Rolle, wenn es darum geht, die nötigen Analysegrundlagen für businesskritische Entscheidungen herauszufiltern – für den maximalen Nutzwert von Big Data.

Optional für »manage it«-Leser: Zusätzlich zur kostenfreien Test-version von EXASolution unter https://www.exasol.com/mit/testen haben Sie die Möglichkeit, an einem 30-minütigen Webseminar zu In-Memory Analytics teilzunehmen.

76 Artikel zu „In-Memory Daten“

NEWS | BUSINESS INTELLIGENCE | BUSINESS PROCESS MANAGEMENT | FAVORITEN DER REDAKTION | GESCHÄFTSPROZESSE

Fehlerhafte Datenbestände bereinigen: Die Relevanz von Daten steigern

»Gott vertrauen wir. Alle anderen müssen Zahlen vorlegen.« So lautet ein Zitat des amerikanischen Statistikers W. Edwards Deming. Es unterstreicht die Relevanz von Messungen und Analysen für die Überprüfbarkeit von Fakten. Da das Datenvolumen jedoch exponentiell wächst, wird dieser Anspruch immer schwerer umzusetzen. Wie Unternehmen die Relevanz ihrer Daten steigern, zeigt der folgende Beitrag. Grassierende…

NEWS | EFFIZIENZ | LÖSUNGEN | SERVICES | AUSGABE 11-12-2019

Data Quality: HELM AG modernisiert und zentralisiert Datenhaltung

Dezentral organisierte Unternehmen tun sich oft schwer, Informations- und Datenprozesse schlank, einheitlich und transparent zu organisieren. Die Digitalisierung verstärkt den Erneuerungsdruck. Die global tätige HELM AG hat es mit Hilfe einer Data-Quality-Lösung geschafft, ihre vertrieblichen und kaufmännischen Arbeitsabläufe zu optimieren. Die Software sorgt dafür, dass die neu erstellte zentrale Stammdatenbasis von Dubletten und Inkonsistenzen befreit wird und im Tagesgeschäft dauerhaft »sauber« bleibt.

NEWS | DIGITALE TRANSFORMATION | EFFIZIENZ | INFRASTRUKTUR | ONLINE-ARTIKEL | STRATEGIEN

NoSQL-Datenbanken massiv auf dem Vormarsch

In der Folge der digitalen Transformation ergeben sich in vielen Unternehmen und Organiationen vielfältige Herausforderungen, etwa in den Bereichen Data Management, Data-as-a-Service und Echtzeitanalytik. In der sich zeitgleich weiterentwickelnden Welt der Geschäftsanwendungen und Datenbanken setzen Unternehmen zunehmend auf NoSQL-Datenbanken. Drei Aspekte prägen nach Meinung von Roland Stritt, Director Channels EMEA bei Rubrik, den Markt und…

NEWS | BUSINESS PROCESS MANAGEMENT | CLOUD COMPUTING | FAVORITEN DER REDAKTION | INFRASTRUKTUR | RECHENZENTRUM | SERVICES | AUSGABE 7-8-2018

Nutzung von Unternehmensdaten – Schritt halten ist angesagt

Die Datenbestände in den Unternehmen wachsen weiterhin stetig an. Dabei handelt es sich sowohl um strukturierte Daten in Datenbanken als auch um unstrukturierte Daten wie Dateien oder Videos. Entscheidend ist, wie diese Daten zusammengeführt und korreliert werden, um daraus optimale Informationen zu gewinnen, die das Business unterstützen und neue Geschäftsfelder generieren.

NEWS | BUSINESS | EFFIZIENZ | INFRASTRUKTUR | ONLINE-ARTIKEL | RECHENZENTRUM | SERVICES | STRATEGIEN | TIPPS

Orientierung im Datenbank-Lizenzdschungel: 7 Kriterien, die Entscheider beachten sollten

Viele Unternehmen zahlen zu viel für Datenbanklizenzen – flexible Abrechnungsmodelle können helfen, die Kosten zu senken. Datenbanken und Datenbankmanagementsysteme (DBMS) gehören heute zu den Kernsystemen für fast jedes Unternehmen. Die Lizenz- und Supportkosten für diese Systeme sind jedoch nicht gerade Peanuts und verschärfen die ohnehin angespannte Budgetsituation in IT-Abteilungen zusätzlich. Auch die mit den Lizenzverträgen…

NEWS | BUSINESS INTELLIGENCE | BUSINESS PROCESS MANAGEMENT | DIGITALISIERUNG | ONLINE-ARTIKEL | SERVICES | STRATEGIEN

Verknüpfung von BI und Big Data hebt Datenanalysen auf neues Niveau

Business-Intelligence-Systeme sind in vielen Unternehmen produktiv im Einsatz. Zusätzliche Auswertungsmöglichkeiten bieten Big-Data-Anwendungen. Der kombinierte Einsatz in Unternehmen ist noch die Ausnahme, das ungenutzte Potenzial aber immens, meint der IT-Dienstleister Consol Software GmbH. Mit Business-Intelligence (BI)-Lösungen, die eine systematische Auswertung von Daten unterstützen, können Unternehmen wichtige Erkenntnisse für die Optimierung ihrer Geschäftsprozesse gewinnen. Die Datenanalysen helfen…

NEWS | BUSINESS INTELLIGENCE | TOP-THEMA | AUSGABE 9-10-2016

Business Intelligence – Aus Daten entscheidungsrelevante Informationen gewinnen

Für viele CEOs ist es eine überaus faszinierende Vorstellung, das gesamte Unternehmen zentral vom Schreibtisch aus monitoren und steuern zu können. Genau dies ist seit fünf Jahrzehnten eines der Versprechen der IT und der betrieblichen Datenverarbeitung. Business Intelligence und Machine Learning sind die heutigen Metaphern, dieses Versprechen einzulösen.

NEWS | TRENDS SECURITY | DIGITALISIERUNG | EFFIZIENZ | GESCHÄFTSPROZESSE | TRENDS 2016 | INFOGRAFIKEN | IT-SECURITY

Digitale Sammelwut: Daten-Messies sind überall

Fast drei Viertel der deutschen IT-Führungskräfte und gut die Hälfte der Büroarbeiter würden sich selbst als Daten-Messies bezeichnen, also als Menschen, die ohne Sinn und Verstand Daten horten. Das birgt hohe finanzielle Risiken die Sicherheit und das Datenmanagement des Unternehmens. Veritas Technologies hat die Ergebnisse seiner weltweiten Datahoarder-Studie präsentiert, die das Verhalten von IT-Führungskräften und…

BUSINESS | BUSINESS INTELLIGENCE | AUSGABE 5-6-2016

Business Intelligence – Mit Hilfe von Datenvisualierung überzeugen

NEWS | BUSINESS INTELLIGENCE | DIGITALISIERUNG | ONLINE-ARTIKEL

Einmal Datensee und zurück: relationale Datenbank und polystrukturierte Daten

Laut einer aktuellen Studie des Gartner Instituts investieren bereits über 75 % der befragten Unternehmen in Big-Data-Lösungen oder planen Investitionen bis 2017. Auch im Mittelstand ist das Thema angekommen. Der zum Sommer mit Spannung erwartete SQL Server 2016 bietet auch kleineren Unternehmen die Chance, Big-Data-Technologien ohne großen Aufwand zu installieren und zu nutzen –…

NEWS | BUSINESS INTELLIGENCE | TRENDS INFRASTRUKTUR | DIGITALISIERUNG | DIGITALE TRANSFORMATION | INDUSTRIE 4.0 | TRENDS 2016 | INTERNET DER DINGE | RECHENZENTRUM

Jede Millisekunde zählt! Der Markt der »In-Memory-Systeme«

In-Memory-Systeme ermöglichen die ultraschnelle Datenverarbeitung in Echtzeit, indem sie den Arbeitsspeicher intelligent als Datenspeicher nutzen. Das spart wertvolle Stunden, Minuten und Sekunden – zum Beispiel in der digitalen Fabrik der Industrie 4.0, wo immense Mengen an Sensordaten ausgewertet werden. Auch bei mobilen Anwendungen werden Antwortzeiten im Millisekundenbereich vorausgesetzt – Nutzer erwarten, dass Apps unmittelbar reagieren.…

STRATEGIEN | AUSGABE 11-12-2015

Big Data Analytics erfordert eine verlässliche Datenbasis

Der Begriff Big Data Analytics bezeichnet ein umfangreiches Spektrum von Methoden und Verfahren, beispielsweise Datenintegration, Datenmanagement, Business Intelligence und Predictive Analytics. Sie alle verfolgen das Ziel, eine breite Datenbasis möglichst effizient zur Optimierung von Entscheidungsprozessen im Unternehmen einzusetzen. Eine wichtige Rolle dabei spielt eine kontinuierlich hohe Datenqualität, ohne die keine echten Fortschritte erreichbar sind und im schlimmsten Fall das Risiko besteht, falsche Schlüsse zu ziehen.

NEWS | BUSINESS INTELLIGENCE | BUSINESS PROCESS MANAGEMENT | TRENDS CLOUD COMPUTING | CLOUD COMPUTING | TRENDS SERVICES | LÖSUNGEN

In-Memory fasst im industriellen Mittelstand Fuß

Fertigungsindustrie ist In-Memory-Vorreiter. Wettbewerbsvorteil durch Echtzeit-Analysen. SAP HANA ist Grundstein für Smart Factory. Im Verlauf des letzten Jahres hat sich das Interesse der mittelständischen Fertigungsindustrie an In-Memory-Computing signifikant verstärkt: Seit 2014 stieg die Zahl derjenigen Unternehmen, die In-Memory-Lösungen wie SAP HANA einsetzen oder ihren Einsatz für sinnvoll halten, von 51 auf 59 Prozent. Zu diesem…

BUSINESS INTELLIGENCE | AUSGABE 9-10-2015

Master Data Management in Zeiten von Big Data – Von Rohdaten zu Business Insights

»Der Erfolg jeder Analytics-Initiative hängt maßgeblich davon ab, welchen Einfluss sie auf das Geschäft hat. Es geht nicht nur um das Sammeln von Rohdaten, sondern darum, wie man sie in Erkenntnisse umwandelt, auf deren Basis man Geschäftsentscheidungen treffen kann. Dies wiederum führt zu mehr Gewinn, Effizienz und Kosteneinsparungen. Denn Daten sind das neue Öl – und Öl muss raffiniert werden, bevor man es nutzen kann.«

BUSINESS | AUSGABE 7-8-2015

Digitale Transformation – Datenanalyse in Echtzeit auch im Mittelstand

Big Data macht den Unternehmen zu schaffen: Die bestehenden Rechner- und Speichersysteme stoßen an ihre Grenzen, Datenanalysen verlangsamen sich und die Flexibilität leidet. Vor allem der Mittelstand könnte den Anschluss verpassen. Unternehmen müssen Daten als Informationen effizient nutzen, um Trends frühzeitig zu erkennen und schnelle Entscheidungen zu fällen. Individualisierte Lösungen, bestehend aus der In-Memory-Plattform SAP Hana, der ERP-Lösung Business One und skalierbaren Serverplattformen wie Bullion, unterstützen KMUs bei ihrer digitalen Transformation.

NEWS | BUSINESS INTELLIGENCE | BUSINESS PROCESS MANAGEMENT | TRENDS CLOUD COMPUTING | CLOUD COMPUTING | TRENDS GESCHÄFTSPROZESSE | RECHENZENTRUM

Wachsendes Datenvolumen ist Haupttreiber für den Einsatz analytischer Plattformen

Der Anstieg von Datenproduktion und Datenvolumen ist der wesentliche Treiber dafür, analytische Plattformen einzusetzen. Auch gewachsene Infrastrukturen, zunehmende Anforderungen an die Analysemöglichkeiten und die Möglichkeit des schnellen Datenzugriffs treiben diese Entwicklung. Das sind Ergebnisse der kürzlich durchgeführten Studie »In-Memory-Analytics«, die hundert IT-Entscheider aus Unternehmen ab 500 Mitarbeitern zu den Treibern analytischer Plattformen befragt hat [1].…

NEWS | BUSINESS INTELLIGENCE | PRODUKTMELDUNG

Völlig neue Einblicke in Daten

SAP hat die neuesten Innovationen rund um ihre Softwarelösungen SAP Lumira und SAP Predictive Analytics vorgestellt. Mit ihnen können Kunden ihre Daten noch besser auswerten und gewonnene Erkenntnisse gezielter nutzen. Zusätzlich präsentierte David McCandless, Autor des Buches Knowledge is Beautiful, eine interaktive Visualisierung für das Internet der Dinge. Eine Version dieser Visualisierung soll in SAP…